El Test de coincidencia de rectas de regresión contrasta la hipótesis nula de igualdad de rectas. El procedimiento es el siguiente:

Archivo del Autor: estadisticallopis

Test de paralelismo entre rectas de regresión

Tema 21: ANÁLISIS DE SUPERVIVENCIA

1. El Análisis de supervivencia es una técnica inferencial que tiene como objetivo esencial modelizar el tiempo que se tarda en que ocurra un determinado suceso. Por el nombre de la técnica parecería que se analizara el tiempo hasta la muerte (Análisis de supervivencia) pero, en realidad, puede analizarse cualquier otro suceso.

2. En Análisis de supervivencia la muestra consiste en el seguimiento de una serie de individuos desde el inicio del estudio hasta su final y, ante una situación de este tipo, es frecuente que se produzca la desaparición de alguno de esos individuos que entran en el estudio. También es posible que al entrar un individuo en el estudio, éste termine antes de que en ese individuo se produzca el suceso que se pretende detectar. Aunque son dos hechos distintos en realidad a efectos prácticos suponen lo mismo. A estos individuos, en el ámbito de la Estadística, se le denomina censurados.

3. Un dato censurado representa, pues, un individuo que desaparece, que lo hemos tenido pero que, antes de haberse producido el suceso que analizamos, ha desaparecido, sea porque lo perdemos del estudio o sea porque el estudio ha terminado y no se ha producido el suceso. Un dato censurado no es un dato que no nos dé información. De hecho, nos la da pero parcial, como veremos. Hay que saberlo aprovechar. Prescindir de él, sin más, sería desaprovechar información y eso, en Estadística, no es bueno.

4. Veamos en el siguiente gráfico el tipo de datos que nos podemos encontrar en un estudio de supervivencia:

5. Observemos que un estudio de supervivencia tiene un inicio y un final, desde ese inicio al final van introduciéndose en el estudio una serie de individuos (Entrada en el estudio), se va realizando un seguimiento y puede, durante ese seguimiento, que se produzca el suceso estudiado (muerte, recidiva, etc), pero también puede ser que el individuo desaparezca del estudio por algún motivo que no sea el estudiado. También puede que acabe nuestro estudio y que a algún individuo tampoco le haya sucedido el suceso estudiado. A efectos prácticos es algo similar a los casos de desaparición.

6. Se define y se dibuja la denominada función de supervivencia de la siguiente forma:

7. Hay en Análisis de supervivencia un enfoque paramétrico. Consiste en aceptar que un determinado tipo de función de distribución paramétrico nos sirve como modelo de esta evolución. Las funciones de distribución más habituales son la Exponencial y la Weibull:

8. Una vez aceptado el modelo se trata, para una muestra determinada, de estimar el valor del parámetro único en la Exponencial o de los dos parámetros en la Weibull. Más en concreto, el modelo basado en la función de distribución exponencial, tiene las propiedades siguientes:

9. El Análisis de supervivencia paramétrico tiene la rigidez de tener que ajustarse los datos al modelo y esto con frecuencia no es así. Por eso, en la práctica, en Análisis de supervivencia, no es la opción más usada.

10. En Análisis de supervivencia han triunfado sin precedentes las técnicas no paramétricas. Posiblemente porque estamos ante un tipo de técnicas y de problemas que aparecen muchas más recientemente que otras técnicas clásicas en Estadística y esto ha provocado que ya se hayan desarrollado y utilizado mayoritariamente los procedimientos no paramétricos que tienen validez mucho más general.

11. De las técnicas de Análisis de supervivencia no paramétricas la más usada y popular es, sin lugar a dudas, el Estimador de Kaplan-Meier de la función de supervivencia.

12. El Estimador de Kaplan-Meier tiene la siguiente formulación:

13. Los gráficos que aparecen tras calcular su fórmula a una muestra tienen el aspecto siguiente:

14. En el artículo Estimador de Kaplan-Meier puede verse cómo, a partir de una muestra, se puede construir una curva de supervivencia como ésta.

15. En Análisis de supervivencia uno de los problemas estadísticos más frecuentes e interesantes es la comparación de curvas de supervivencia. El problema surge cuando tenemos dos o más grupos, cada uno con su muestra, y queremos ver si tenemos igualdad de curvas de supervivencia. El problema, pues, es comprobar si el Estimador de Kaplan-Meier aplicado a cada una de esas muestras nos permite deducir que las diferencias que vemos entre ellas son estadísticamente significativas o, por el contrario, pueden ser atribuibles al azar.

16. La Hipótesis nula será, en este caso, igualdad de curvas. En Estadística siempre se presupone la igualdad. También de curvas de supervivencia, que es lo que ahora nos ocupa. La Hipótesis alternativa será que hay diferencia entre esas curvas y que, por lo tanto, el suceso analizado se produce con ritmo distinto a lo largo del tiempo en los diferentes grupos analizados.

17. La técnica más usual para realizar esta comparación de curvas de supervivencia es el Test Log-Rank (Ver Herbario de técnicas). Es, de hecho, una técnica ji-cuadrado, donde se realiza una comparación entre un observado (las curvas de supervivencia muestrales) y un esperado (reuniendo todos los valores en una única muestra).

18. Vamos a ver una aplicación concreta de Análisis de supervivencia y de comparación de curvas de supervivencia. Supongamos un caso donde, pacientes con una misma patología, un grupo de ellos son tratados con placebo y otro grupo con un determinado tratamiento que se quiere evaluar. Y obtenemos los siguientes tiempos (en las unidades temporales que se sean, aquí es lo de menos):

19. Si calculamos el Estimador de Kaplan-Meier a estos dos grupos tenemos los siguientes valores:

20. Y estos valores se materializan en las siguientes curvas de supervivencia:

21. Si ahora aplicamos el Test Log-Rank para comprobar si estas diferencias muestrales son diferencias significativas obtenemos el resultado siguiente:

22. Este test nos indica que las diferencias entre ambas curvas no son debidas al azar, son significativas. El p-valor del test es 0.0144 y como es menor que 0.05 rechazamos la Hipótesis nula de igualdad de curvas. Lo que indica que la supervivencia se alarga como consecuencia del tratamiento.

23. En el contexto del Análisis de supervivencia es muy usual trabajar con la función de riesgo (Hazard function). La definición de esta función es la siguiente:

24. Observemos que la función de riesgo h(t) es una medida de la probabilidad de que se produzca el suceso estudiado entre los que quedan sin haber sufrido todavía tal suceso. Es realmente una función que evalúa, puntualmente, en un período de tiempo determinado, la probabilidad de que un individuo de los que todavía no han sufrido tal suceso lo sufra precisamente en ese período de tiempo. Es, por lo tanto, realmente, una función que mide el riesgo en un período de tiempo concreto.

25. Supongamos que estamos evaluando, como sucede muchas veces, el tiempo de vida de una serie de personas que están bajo ciertas condiciones. En estas circunstancias, la función de riesgo cuantifica puntualmente la probabilidad de muerte entre los que quedan en vida. Si se analiza con un poco de detenimiento su formulación esto es lo que realmente mide la función de riesgo h(t).

26. La forma de la función de riesgo puede ser muy distinta según los datos que estemos analizando. Nos podemos encontrar con funciones de riesgo tan distintas como las siguientes:

27. La función de riesgo puede ser creciente, decreciente, constante, y cualquier combinación de estas últimas a trozos dentro del dominio t.

28. Por ejemplo, la función exponencial, como modelo paramétrico, cuya función ya hemos visto antes, nos aporta un modelo con función de riesgo constante. Veamos por qué:

29. Observemos las tres curvas de supervivencia asociadas a las tres distintas funciones exponenciales. El hecho de que la función de riesgo sea constante indica que la altura de la curva respecto al área que queda a la derecha del punto temporal en el que estemos es siempre el mismo valor: lambda, que es el parámetro de esta función de distribución.

30. Muchas veces además de la función de riesgo se usa también la función acumulada del riesgo, que es la siguiente función:

31. Otro concepto importante en Análisis de supervivencia es el de Hazard ratio que es una razón de riesgos. El Hazard ratio no es más que el cociente entre dos funciones de riesgo.

32. El Hazard ratio es una función que toma valores que van de cero a infinito, como la Odds ratio. Cuando toma valores por encima de 1 significa que una de las funciones de riesgo va por encima y si es menor que 1 que las posiciones de las curvas es la contraria. Si toma el valor de 1 las dos curvas están a la misma altura. Se construyen, evidentemente, intervalos de confianza de estos Hazard ratios, para ver si se solapan o no. Se realizan, también, por supuesto, contrastes de hipótesis, donde la Hipótesis nula es que el Hazard ratio es 1.

33. El Hazard ratio, como decimos, es, en realidad, una función, porque la posición relativa de ambas funciones de riesgo puede cambiar a lo largo del tiempo. Sin embargo, en muchos ocasiones, se supone una función constante y, por esto, en muchas ocasiones, el Hazard ratio, se maneja como un número, pero, esencialmente, es una función: la función cociente de las dos funciones de riesgo.

34. El siguiente gráfico aclarará posiblemente la noción de Hazard ratio (HR):

34. Como puede apreciarse el HR es una función del tiempo. Es una relación temporal entre funciones de riesgo. Puede ser constante, pero en general no lo será.

35. Observemos, pues, que en Análisis de supervivencia la finalidad básica es estimar la función de supervivencia, función que en ocasiones se expresa en forma de función de riesgo. Y una vez dibujada esta estimación de la función de supervivencia uno de los objetivos más frecuentes es compararla con otra y valorar si la diferencia muestral que vemos es una diferencia estadísticamente significativa.

Estimador de Kaplan-Meier

El Estimador de Kaplan-Meier es un estimador no paramétrico de la función de supervivencia. Se basa en la fórmula siguiente:

Veamos un ejemplo, basado en la siguiente muestra de valores de supervivencia expresados en unidades de tiempo:

(4, 6, 7c, 8, 10, 10, 10, 15c, 20, 25)

donde la c añadida a un valor indica que el valor es censurado, que significa que o bien ha salido del estudio o que el estudio ha terminado y todavía este individuo no le había sufrido el suceso estudiado.

Veamos a continuación cómo se calcularía con estos valores la información necesaria para construir la función de Kaplan-Meier:

Cuando un valor es censurado se salta, lo que significa que su información se asocia a valores próximos. Por lo tanto, es una información que se utiliza. Lo mismo sucede con valores repetidos, se calculan valores sólo del último. Pero, evidentemente, los demás quedan asociados a este último valor.

A partir de estos valores la curva de supervivencia es la siguiente:

Cuando un valor es censurado se señala en el momento que ha salido del estudio. Si estuviera al final del estudio se marcaría también.

Otro ejemplo. Supongamos ahora la muestra de las siguientes unidades de tiempo:

(2, 3, 5c, 7, 8, 15, 18c, 18c, 18c, 18c)

Obsérvese que en este caso el valor 18, que podría representar 18 meses de seguimiento, podríamos considerar el final del seguimiento. Por lo tanto, tenemos 4 individuos en los que no ha sucedido el acontecimiento estudiado en las 18 unidades temporales del seguimiento.

El cálculo del Estimador de Kaplan-Meier es el siguiente:

La curva de supervivencia de Kaplan-Meier es, pues, la siguiente:

Test Log-Rank de comparación de curvas de supervivencia

El Test Log-Rank es un contraste de hipótesis que comparar curvas de supervivencia. Se pueden comparar dos o más de dos.

Para comparar dos curvas de supervivencia el Test es el siguiente:

Veámoslo en un ejemplo. Supongamos estos dos grupos, cada uno con su curva de supervivencia que es evidentemente distinta muestralmente. El problema es ver si esta diferencia es estadísticamente significativa. Apliquemos el Test:

Como puede verse, a pesar de que las diferencias muestrales son sustanciales esa diferencia no es significativa. Veamos el siguiente cambio. He creados dos grupos que repiten cada uno de los cinco valores anteriores. Por lo tanto, las diferencias entre curvas se mantienen pero ahora con un tamaño muestral mayor. Recordemos que el tamaño muestral es determinante a la hora de detectar diferencias estadísticamente significativas. Veamos cómo van a cambiar las cosas. Calculemos el Test para estos nuevos datos:

Como puede verse ahora sí tenemos un resultado significativo. Ahora las diferencias son estadísticamente significativas. Ahora sí que ya podemos afirmar que las dos curvas de supervivencia poblacionales son distintas.

Por lo tanto, antes el tamaño muestral jugaba en contra de la significación estadística. Ahora el tamaño muestral es lo suficientemente grande como para que podamos decir que las diferencias que antes veíamos no pueden ser atribuibles al azar del muestreo.

Tema 20: ANÁLISIS DISCRIMINANTE

1. El Análisis discriminante es una técnica inferencial. Es una técnica típicamente multivariante porque suele usarse en contextos donde tenemos varias variables, pero evidentemente puede aplicarse con pocas variables, incluso con una sola variable, pero no es lo habitual.

2. Una característica esencial de esta técnica es que tenemos previamente definidas dos o más poblaciones; o sea, tenemos dos o más muestras de esas poblaciones con una serie de individuos de cada una de ellas de los que tenemos medidas una serie de variables.

3. Su finalidad básica es preparar esa información, seleccionarla, trabajarla, con una finalidad clasificadora. Futuros individuos, a los que les podremos medir esas variables, deberemos clasificarlos como miembros de alguna de esas poblaciones.

4. Evidentemente partimos del supuesto de que esos nuevos individuos a clasificar pertenecen a una de esas poblaciones.

5. El Análisis discriminante tiene un nombre muy apropiado para lo que es su procedimiento. Porque lo que hace es iniciar, a partir de toda la información de que se dispone sobre las poblaciones y las variables, un proceso de discriminación, un proceso de separación lo mayor posible de esas poblaciones.

6. Por lo tanto, a partir de un conjunto de individuos que sabemos ciertamente a qué población pertenecen cada uno de ellos y a partir de los valores de todas las variables que disponemos mediante el Análisis discriminante tratamos de buscar qué combinaciones de esas variables nos permitirán discriminar lo más posible entre los grupos que tenemos.

7. Pongamos un ejemplo previo sencillo que puede ayudarnos a clarificar el camino de la explicación de esta técnica: Supongamos que queremos encontrar variables que nos permitan clasificar a una persona entre hombre o mujer teniendo únicamente la información de la medida de esa variable.

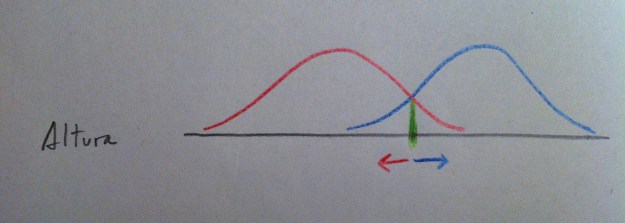

8. La variable edad no discrimina entre hombres y mujeres, no separa bien esos dos grupos. La variable altura ya discrimina más. La variable pie que calza discrimina más aún. Veámoslo en unos datos posibles: En rojo tendríamos una muestra de mujeres y en azul una de hombres:

9. Elegir la edad para pronosticar el sexo nos llevaría a mucho error. La mitad de las veces nos equivocaríamos. Elegiendo la altura ya cometeríamos menos errores porque las poblaciones están más discriminadas, más separadas, respecto a esta variable. Eligiendo el pie que calza cometeríamos menos errores aún porque de las tres variable es la que discrimina mejor, es la que separa mejor a los dos grupos, como puede apreciarse en este gráfico. Esto es así en la realidad: en mujeres y hombres con la misma altura los hombres tienen el pie más grande que las mujeres.

10. Si se entiende bien esta idea simple se entenderá perfectamente lo que persigue el Análisis discriminante. Porque esto es lo que hace la técnica: entre las variables de que disponemos y con las muestras que tenemos de las poblaciones en estudio debemos buscar qué variables y qué combinación de ellas es la que consigue separar más, discriminar más, esos grupos. La finalidad es usarlo como mecanismo para clasificar a un individuo futuro del que tendremos los valores que tiene de esas variables pero del que no sabremos a qué población pertenece.

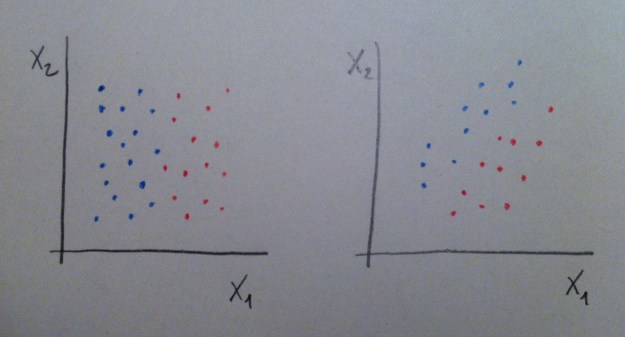

11. A veces si tenemos más de una variable con una de esas variables nos bastará para conseguir una buena discriminación, pero a veces ninguna de ellas individualmente nos irá bien y sí, en cambio, una combinación de ellas. Miremos el siguiente gráfico:

12. Puede observarse que en el caso de la izquierda la variable X1 es muy buena discriminadora de las dos poblaciones: la roja y la azul. Desde X1 las dos poblaciones se visualizan bien separadas. Tener el valor de X1 de un individuo que no sabemos si pertenece a la población roja o a la azul nos permitiría, con cierta tranquilidad, clasificarlo de una u otra población y parece que la probabilidad de error sería bajo. En cambio la X2 no discrimina, no nos separa las dos poblaciones. Esa variable es, pues, un mal referente para clasificar entre esas dos poblaciones.

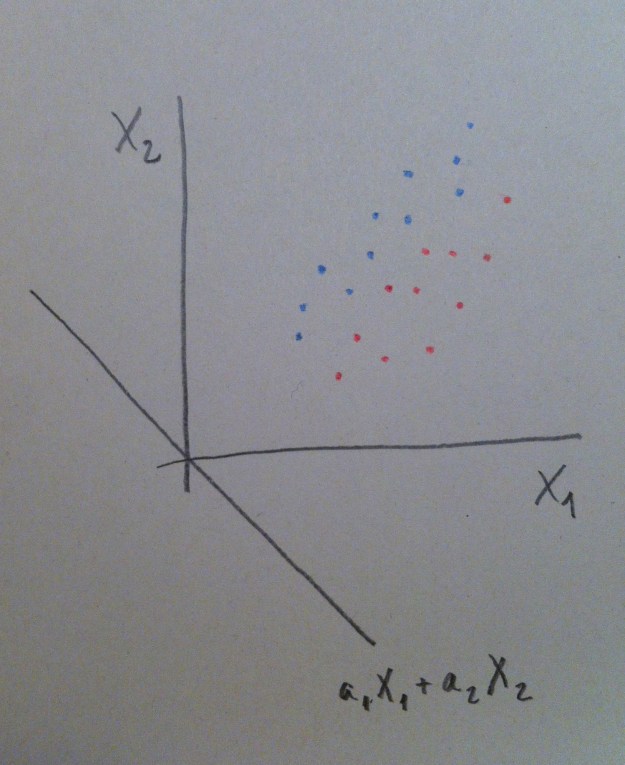

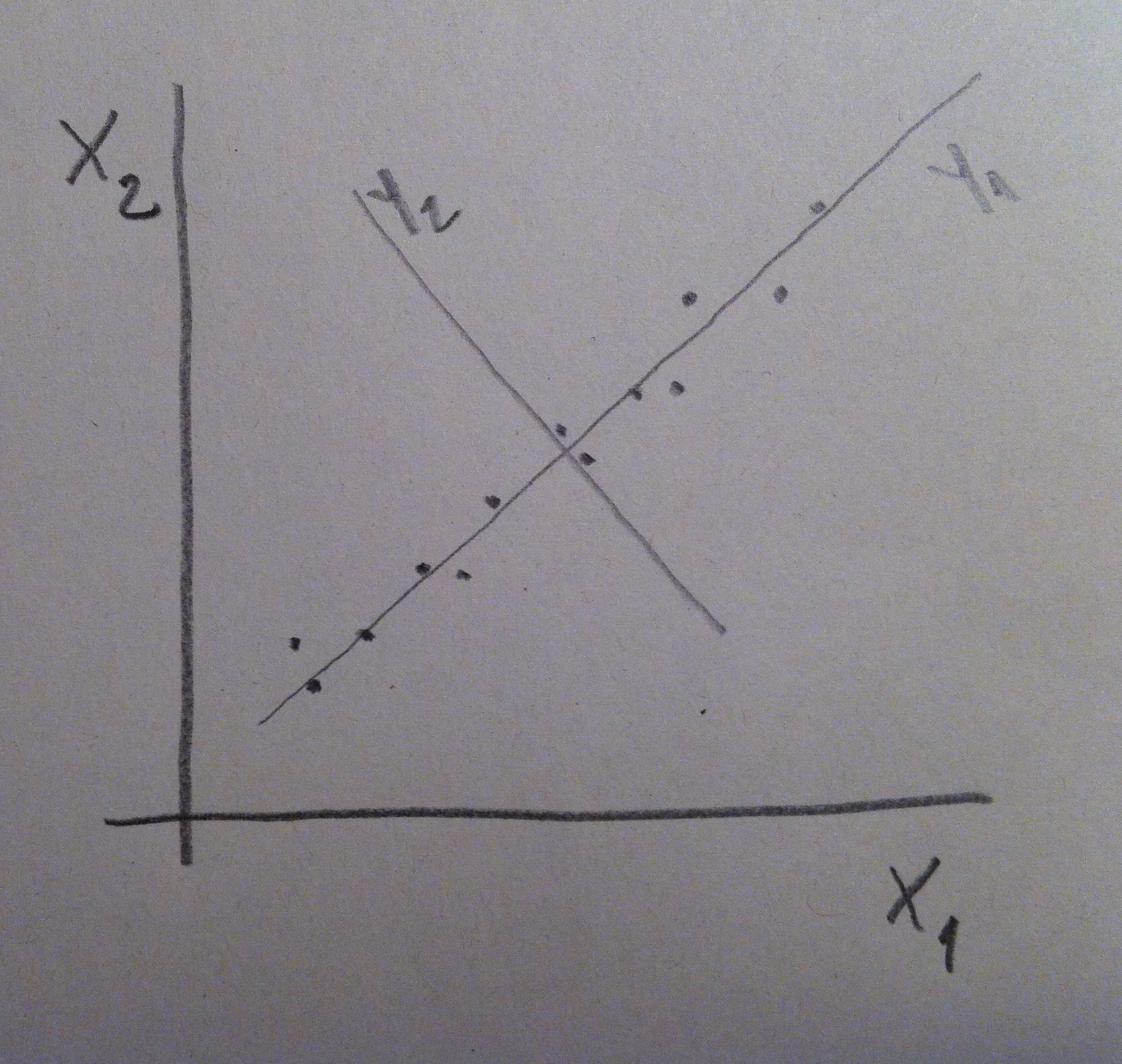

13. En el caso de la derecha del gráfico anterior la situación nos permite decir que ni X1 ni X2 son buenos discriminadores por separado. Si miramos la nube de puntos tanto desde X1 como desde X2 las dos poblaciones se ven mezcladas, no están discriminadas. Pero si hacemos un giro de los ejes, si hacemos una combinación de esas dos variables, podremos discriminar bien. Miremos el giro que hacemos en el gráfico siguiente:

14. Ahora la variable a1X1+a2X2 sí que discrimina bien. Ver la nube de puntos desde este nuevo eje nos permite visualizar las dos poblaciones bien separadas. Por lo tanto, el valor que tengamos de un nuevo individuo de esta combinación de las dos variables originales nos permitirá establecer un criterio de clasificación con pocas probabilidades de error. Y no olvidemos que hacer este giro va asociado de una fórmula como ésta, una fórmula que combina de una forma peculiar y lineal esos dos ejes originales.

15. De hecho, lo que acabamos de hacer no nos debe extrañar, lo hemos hecho ya en el Análisis de componentes principales y en el Análisis factorial. Hemos hecho combinaciones de las variables originales, hemos hecho giros de los ejes, hemos creado componentes, factores. Ahora, en el contexto del Análisis discriminante estas combinaciones de las variables originales las llamamos funciones discriminantes. Pero, en abstracto, es como una componente o un factor: una combinación lineal de las variables originales.

16. Y sea el tipo que sea de Análisis discriminante el que realicemos, de entre los que veremos a continuación, el procedimiento siempre es el mismo: se trata de crear un mecanismo de decisión a través del cuál al nuevo individuo se lo clasifica según el peso que tenga respecto a las densidades de las diferentes poblaciones. Lo veremos mejor con un ejemplo: Supongamos uno de los casos vistos antes: la altura como variable que discrimine entre hombres y mujeres. Lo que haremos es crear una función de densidad a partir de la muestra de hombres, otra a partir de la muestra de mujeres y entonces al nuevo individuo clasificarlo de la población que le tocaría más densidad; o sea, en el gráfico establecemos una frontera (en color verde) justo donde cambia la zona de mayor influencia de una u otra población. Si cae el nuevo valor a la derecha de esa frontera lo clasificamos de azul, si cae a la izquierda lo clasificamos de rojo:

17. Hay diferentes técnicas de Análisis discriminante. Hay el Análisis discriminante lineal, el Análisis discriminante cuadrático y hay, también, todo un repertorio de técnicas que se suelen encajar bajo la denominación de Análisis discriminante no paramétrico.

18. La creación de funciones discriminantes, combinaciones de las variables originales desde donde establecer buenos mecanismos de discriminación, tal como lo hemos planteado antes, es una idea ligada al Análisis discriminante lineal, pero es cierto que aunque los mecanismos usados por los diferentes tipos de Análisis discriminante son distintos, todos comparten la atmósfera general que he intentado transmitir hasta ahora.

19. El Análisis discriminante lineal y el cuadrático parten de una serie de suposiciones que no siempre se cumplen, por eso se han desarrollado una serie de técnicas que son válidas sin el cumplimiento de las suposiciones rígidas que exigen las técnicas paramétricas. La discriminación lineal y la cuadrática requieren que cada una de las poblaciones siga la distribución Normal multivariante. Además, la discriminación lineal requiere que la matriz de varianzas-covarianzas sea la misma en todas las poblaciones. La discriminación cuadrática, de hecho, está diseñada para no tener que soportar esta suposición.

20. Las técnicas no paramétricas en Análisis discriminante tratan, mediante métodos diferentes y muy imaginativos, establecer procedimientos de clasificación de los nuevos individuos dentro del conjunto de poblaciones candidatas.

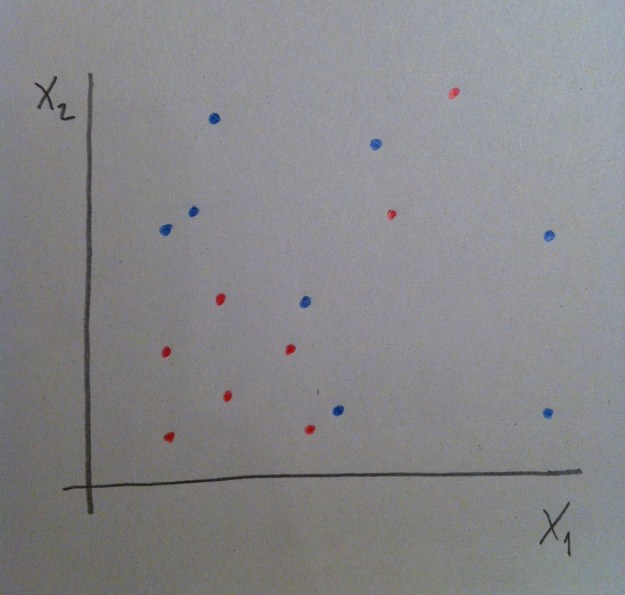

21. Uno de esos métodos no paramétricos de Análisis discriminante es el basado en la Estimación no paramétrica de funciones de densidad. Veamos un poco la operatividad de este método porque es conceptualmente muy sencillo e interesante. Supongamos los siguientes datos:

22. Tenemos dos muestras de dos poblaciones distintas: la roja y la azul. El método construye, entonces, para cada muestra, una función de densidad mediante el método Kernel y clasifica al nuevo individuo simplemente asignándolo a la población donde haya más valor de densidad, que querrá decir que por allí hay más influencia de esa población, hay más valores muestrales y, por lo tanto, parece lógico arriesgarse a clasificarlo de la población que tenga más representantes por la zona. Es la misma idea que la mostrada antes con la variable Altura pero en lugar de mediante una campana de Gauss, mediante una función de densidad estimada a partir de la propia muestra.

23. Como hemos dicho al principio del tema, y se ha podido comprobar a lo largo de su explicación, el Análisis discriminante es una técnica inferencial, una técnica que hace inferencias, que va más allá de lo que tenemos, que usa la muestra como medio para decir cosas que no sabemos. En este caso, para clasificar a individuos dentro de dos o más poblaciones.

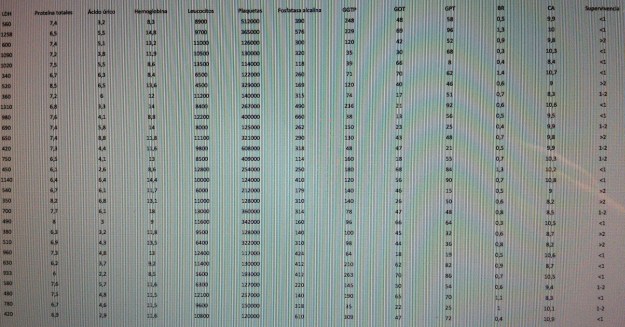

24. Veamos un ejemplo de Análisis discriminante lineal. Vamos a trabajar unos datos de años de supervivencia después del diagnóstico de cáncer de pulmón de células pequeñas. Los datos son los siguientes:

25. No vamos a entrar en detalles sobre cada una de las variables. Sólo decir que son típicas variables bioquímica y citológicas en una analítica sanguínea. La última columna es la Supervivencia, catalogada con tres valores: <1, 1-2 y >2, que representan: menos de un años, entre 1 y 2 años y más de 2 años. Esta es la columna que nos distingue las poblaciones. Son datos de enfermos que al diagnóstico tenían esta analítica y que acabaron sobreviviendo este tiempo especificado en la última columna.

26. El objetivo es, pues, aplicar el Análisis discriminante para establecer un mecanismo de clasificación, de pronóstico en este caso. Tenemos tres poblaciones definidas: Supervivencia de <1, de 1-2 y de >2 años. Tenemos tres muestras y 12 variables. Se trata de discriminar esas tres poblaciones, mediante esas 12 variables, con la finalidad de que a un nuevo paciente diagnosticado de esa enfermedad le podamos hacer un pronóstico con bastantes posibilidades de acertar.

27. En primer lugar deberíamos comprobar la normalidad de los datos y la igualdad de la matriz de varianzas-covarianzas. La normalidad multivariante es de compleja comprobación. Aunque la normalidad de cada variable individual no representa normalidad multivariante los software estadísticos acostumbran a comprobar esta normalidad univariante con cualquiera de las técnicas de bondad de ajuste a la normal, como el Test de Kolmogorov o el de la ji-cuadrado. Respecto a la homogeneidad de las matrices de varianzas-covarianzas una prueba habitual es el Test M de Box, que es una generalización del Test de Barlett univariante.

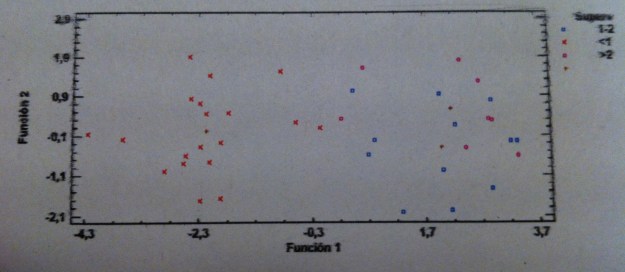

28. Una vez comprobadas estas suposiciones pasamos a la realización de un Análisis discriminante lineal. Dibujamos los datos mediante un gráfico en tres dimensiones con las dos funciones discriminantes que nos calcula el programa:

29. Las tres cruces que tienen forma de suma corresponden a los valores promedios de cada una de las tres poblaciones, de cada uno de los tres grupos de supervivencia.

30. De entrada, ya sólo viendo este gráfico y recordando lo que hemos dicho antes, parece claro que la Función discriminante 1 parece discriminar bien pero la Función discriminante 2 no parece que nos discrimine nada.

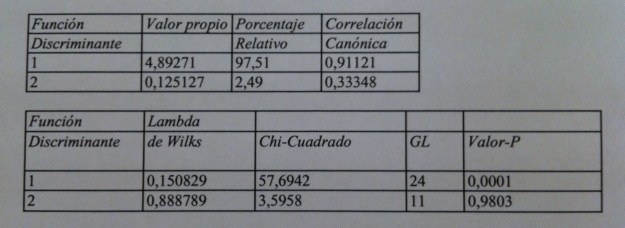

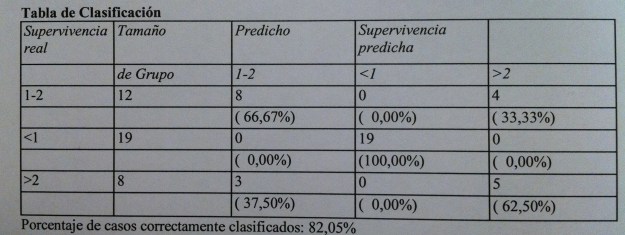

31. Veamos la siguiente tabla:

32.Los dos valores propios muestran que la primera función discriminante está mucho más relacionada que la segunda con los grupos de supervivencia. La correlación canónica así lo muestra también. Pero, además, gracias a la Lambda de Wilks podemos comprobar que, además, la primera función discriminante separa significativamente grupos, discrimina. Sin embargo, la segunda función discriminante no consigue una separación significativa. El Test de la Lambda de Wilks es básico en muchos ámbitos inferenciales multivariantes. Es un test que básicamente trata de establecer una relación entre la dispersión dentro de los grupos respecto a la dispersión total, sin tener en cuenta los grupos. Si

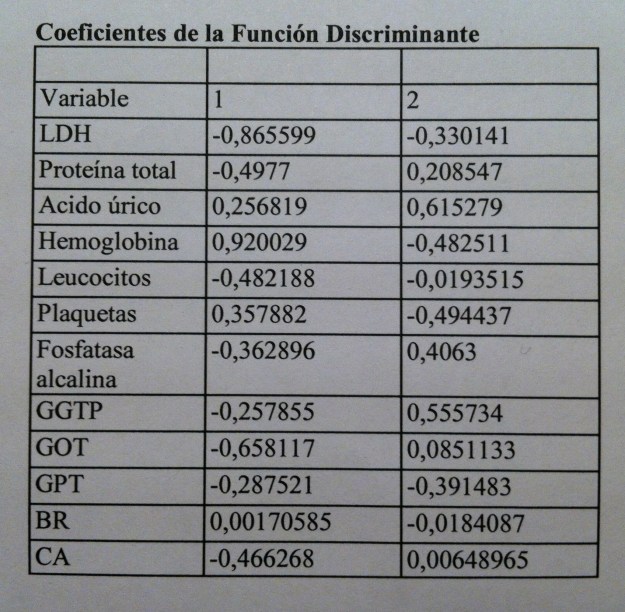

33. Veamos cuáles son esas funciones discriminantes:

34. Tenemos las dos pero en realidad sólo debemos mirar la primera porque la segunda no nos discrimina. Como puede verse se trata de macrovariables, como las componentes o los factores. Pero ahora, debido al contexto donde las hemos creado las llamamos funciones discriminantes. El programa estadístico nos da dos pero sólo una es significativa.

35. En Análisis discriminante no suele haber una preocupación por la interpretación de esas macrovariables, de las funciones discriminantes. De hecho, el análisis está canalizado a la creación de un método que funciones, que sea útil, no suele haber un interés en ponerle nombre a esas funciones como sí ocurre, por el contrario, en Análisis de componentes principales o en Análisis factorial.

36. Para clasificar a un nuevo individuo diagnosticado de cáncer de pulmón de células pequeñas después de hacerle una analítica con todos estos parámetros deberíamos aplicar los valores de la siguiente tabla con las llamadas funciones de clasificación:

37. Estas funciones de clasificación de los nuevos individuos es creada a partir de las muestras que tenemos de los tres grupos de supervivencia. La operatividad es la siguiente: Se calculan los tres valores correspondientes para cada columna con los valores del individuo. El valor más alto es el valor más probable. Digamos que es una forma de calcular bajo qué distribución de las tres tiene más probabilidad.

38. Observemos que el procedimiento liga mucho con la idea del uso de Estimadores no paramédicos de la función de densidad con el método Kernel, comentado antes. Y, de hecho, liga con la idea nuclear que guía todo lo visto en este tema: hay que clasificar allá donde haya más influencia entre las muestras previamente establecidas.

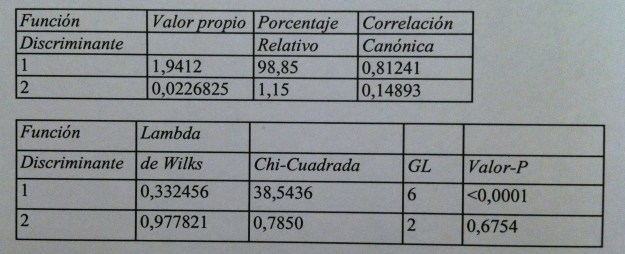

39. ¿Cómo podemos cuantificar la eficacia del método de discriminación? ¿Cuál será su eficacia? ¿Podemos predecirla? Miremos este interesante método para hacer esta previsión:

40. Se trata de un método ingenioso de estimación de la eficacia clasificatoria. Consiste en ir tomando uno a uno cada uno de los individuos de la muestra. Individuos de los que ya sabemos su supervivencia. Pues bien, aplicamos la tabla de clasificación establecida a partir de estos datos que hemos visto antes y miramos dónde quedaría clasificado este individuo si no supiéramos su supervivencia. Y esto lo hacemos con todos los individuos de la muestra. De esta forma tenemos de cada uno de los individuos dos valores de supervivencia: el real y el pronosticado. Construimos, entonces, esta tabla de clasificación donde vemos es las filas la supervivencia real (porque es nuestra muestra y la sabemos) y la supervivencia prevista aplicando nuestro método de clasificación. Así vemos si acertamos o no. Lo bueno es que los valores estén en la diagonal principal que es la que hace coincidir grupo real con grupo predicho. De esta forma se acaba calculando un porcentaje de casos correctamente clasificados, que, en nuestro caso, es del 82.05%. Que no es malo debido a la complejidad de los que estamos hablando.

41. Observemos que hemos trabajado con todas las variables del estudio. Pero aquí, en Análisis discriminante lineal también podemos hacer una Selección de variables hacia adelante o hacia atrás, como en la Regresión múltiple. Si hiciésemos esto a estos datos obtendríamos, en primer lugar, la siguiente representación de los individuos según las dos funciones discriminantes:

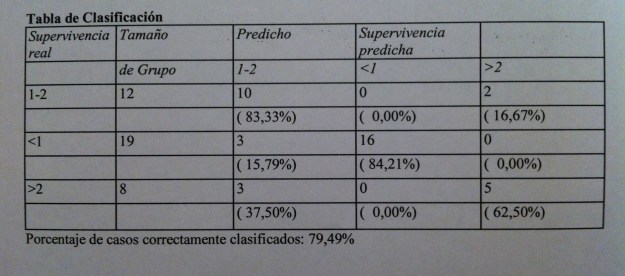

42. Los valores de significación siguen marcando la primera función discriminante como única función que discrimina realmente:

43. El proceso de selección del modelo encuentra que con tres variables basta. Con las variables LDH, Hemoglobina y GPT ya es suficiente. Las funciones discriminantes son:

44. La tabla de funciones de clasificación es ahora la siguiente:

45. Y la tabla de clasificación que nos mide la calidad de la clasificación con los valores muestrales es la siguiente:

46. Tenemos un 79.49% de aciertos, un poco menor que el 82.05% de antes, pero con muchas menos variables.

47. Un breve comentario para acabar: Es interesante establecer conexiones entre el Análisis discriminante y la Regresión logística. De hecho, tienen profundas similaridades. De hecho, se trata de dos formas de enfrentarse a lo mismo. Observemos que las poblaciones en las que queremos clasificar a un nuevo individuo se puede ver, en realidad, como una variable cualitativa. Y el procedimiento de discriminación es como la búsqueda del modelo de regresión.

48. Cuando la variable es dicotómica y se pretende modelizar la situación y establecer relaciones entre la variable dicotómica y un conjunto de variables predictoras mediante Odds ratio, entonces es más habitual usar la Regresión logística. Cuando hay más de dos poblaciones y además hay especialmente una voluntad práctica clasificatoria suele usarse el Análisis discriminante. También para el uso de una u otra técnica juegan cuestiones de tradición, culturales. Por ejemplo, en Medicina es más usual la Regresión logística por tradición y por el papel tan destacado que en ese campo juega la Odds ratio. Sin embargo, en ámbitos como la Biología, la Ecología, la Sociología y otros es más habitual el uso del Análisis discriminante.

Tema 19: ANÁLISIS CLÚSTER

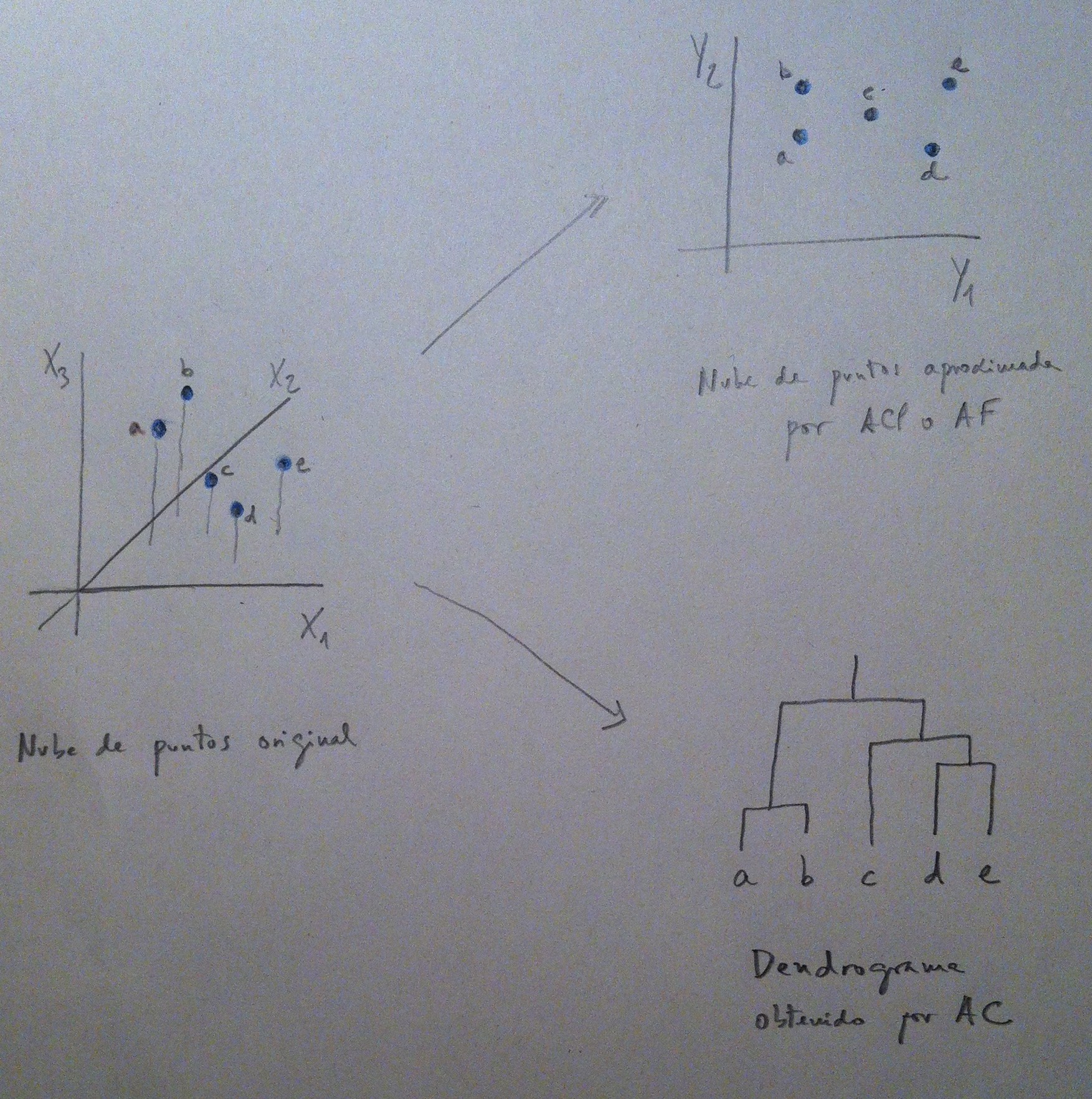

1. El Análsis clúster (AC), también llamado en ocasiones Análisis de conglomerados, se dice habitualmente que es una técnica estadística clasificadora, pero, en realidad, es una técnica que, como el Análisis de componentes principales (ACP) o como el Análisis factorial (AF), pretende representar una realidad que no conseguimos visualizar, una realidad cuya representación original es multidimensional y es imposible que la podamos ver en su estado puro.

2. En el fondo tanto ACP, como AF, como AC son técnicas que tratan de representan una nube de puntos original situada en un espacio de tantas dimensiones que es imposible visualizar. Y cada una de ellas, también, en el fondo, puede ser usada como método clasificatorio, como método para crear subpoblaciones, subgrupos.

3. La diferencia fundamental entre ellas es la forma de presentación que utilizan, la forma de resolver el problema de no visualización de la nube de puntos originales. El ACP y el AF lo hacen construyendo una nube de puntos de la misma naturaleza pero de menor número de dimensiones perdiendo una parte de la información original. Sin embargo, el AC lo que hace es crear una representación distinta a la de la nube de puntos. Crea otro tipo de representación. Cambia la forma: no lo hace mediante una nube de puntos, lo hace mediante un dendrograma.

4. Cada una de las opciones tiene sus ventajas y sus desventajas, como iremos viendo a continuación.

5. El ACP y el AF respetan el tipo de representación: una nube de puntos, pero al reducir dimensiones se pierde información y esto es un problema, especialmente si la pérdida es importante. El AC respeta la nube de puntos original, no reduce dimensiones y, por lo tanto, no se pierde información, pero, eso sí, se cambia el mecanismo de representación, se cambia el estilo de representación. Representamos la nube de puntos mediante un dendrograma. Digamos que en el ACP y el AF se hace una representación figurativa y en el AC se hace una representación abstracta. Veamos un gráfico que nos ilustra la comparación:

6. A la izquierda de este gráfico tenemos una supuesta nube de puntos original. En este caso con tres dimensiones para que lo visualicemos, pero normalmente esta nube de puntos no la veremos, será una nube de puntos de muchas más dimensiones. A la derecha vemos las dos estrategias gráficas: Arriba una representación mediante una nube de puntos también, aunque en dos dimensiones que pueden ser las diseñadas por dos componentes principales o por dos factores, según la técnica utilizada. Abajo una representación bien distinta: un dendrograma, que, como a continuación veremos, se construye a partir de la nube de puntos original mediante unos procedimientos que conviene explicar con detalle.

7. Visto así parecería que el AC tiene ventajas: cambiamos la forma de representación pero no perdemos información. Parece mejor opción, pero sólo lo parece. Porque ahora veremos que en el AC hay dos momentos de decisión en la técnica que nos lleva a procedimientos que nos pueden generar realmente representaciones muy diferentes.

8. Veamos el procedo seguido por el AC para construir un dendrograma a partir de una nube de puntos original constituida por una serie de individuos de los que tienes los valores de varias variables.

9. El primer momento en el AC es definir una noción de distancia entre puntos. Necesitamos elegir una distancia, una medida que nos cuantifique distancias entre los individuos dentro de la nube de puntos original. Y aquí aparece de repente el primer problema del AC: que hay muchas distancias propuestas.

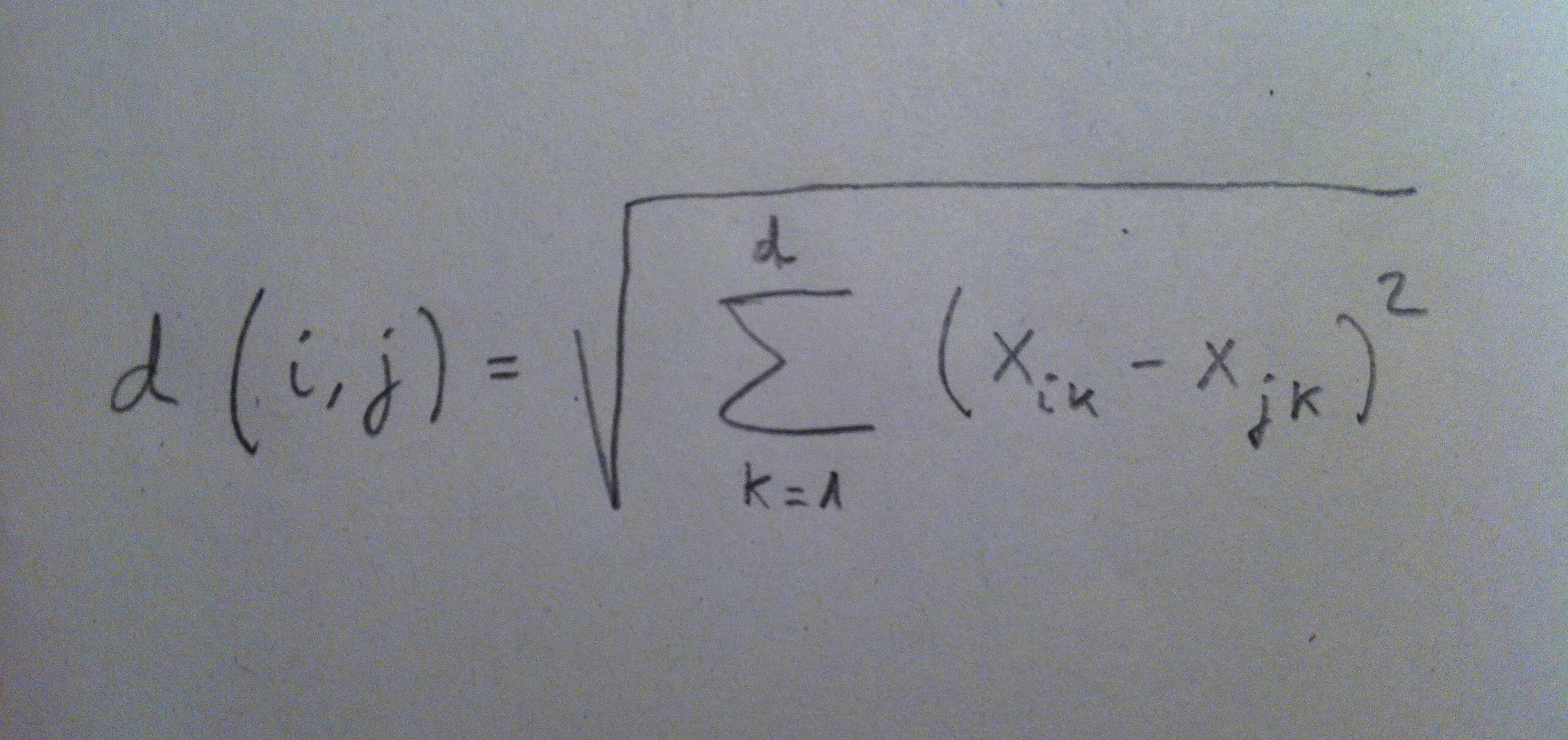

10. Ejemplos de distancias: La distancia euclídea es la más intuitiva y la más utilizada, de largo. Es la que calcula la distancia en línea recta entre los puntos en el espacio o en el hiperespacio de la nube de puntos original. Esta distancia en realidad es una aplicación del Teorema de Pitágoras:

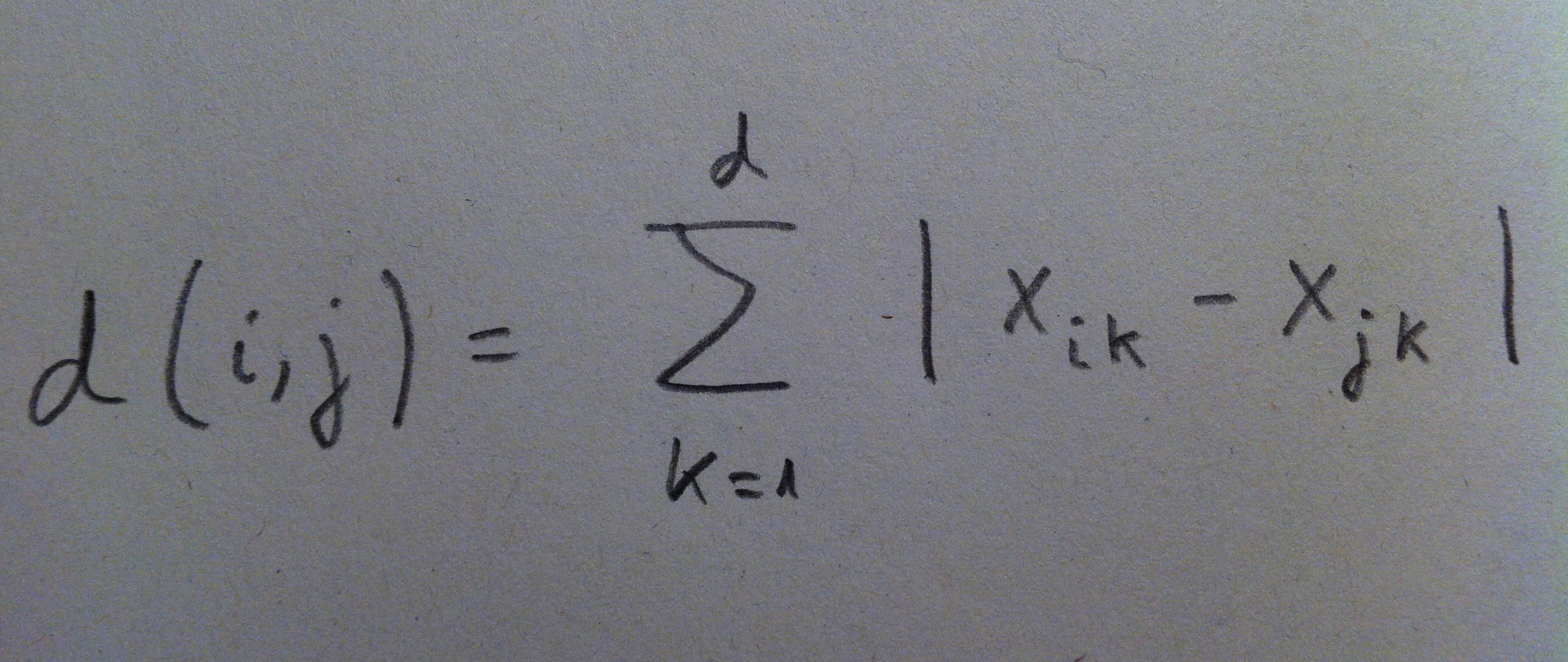

Otra distancia muy utilizada es la denominada distancia Ciudad, que también se la llama distancia Taxi:

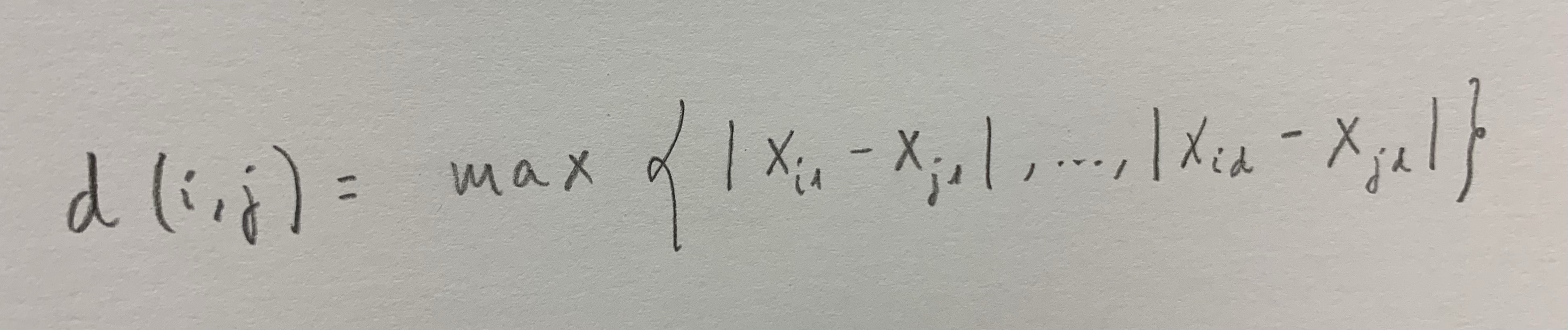

Otra distancia utilizada frecuentemente es la denominada distancia del máximo:

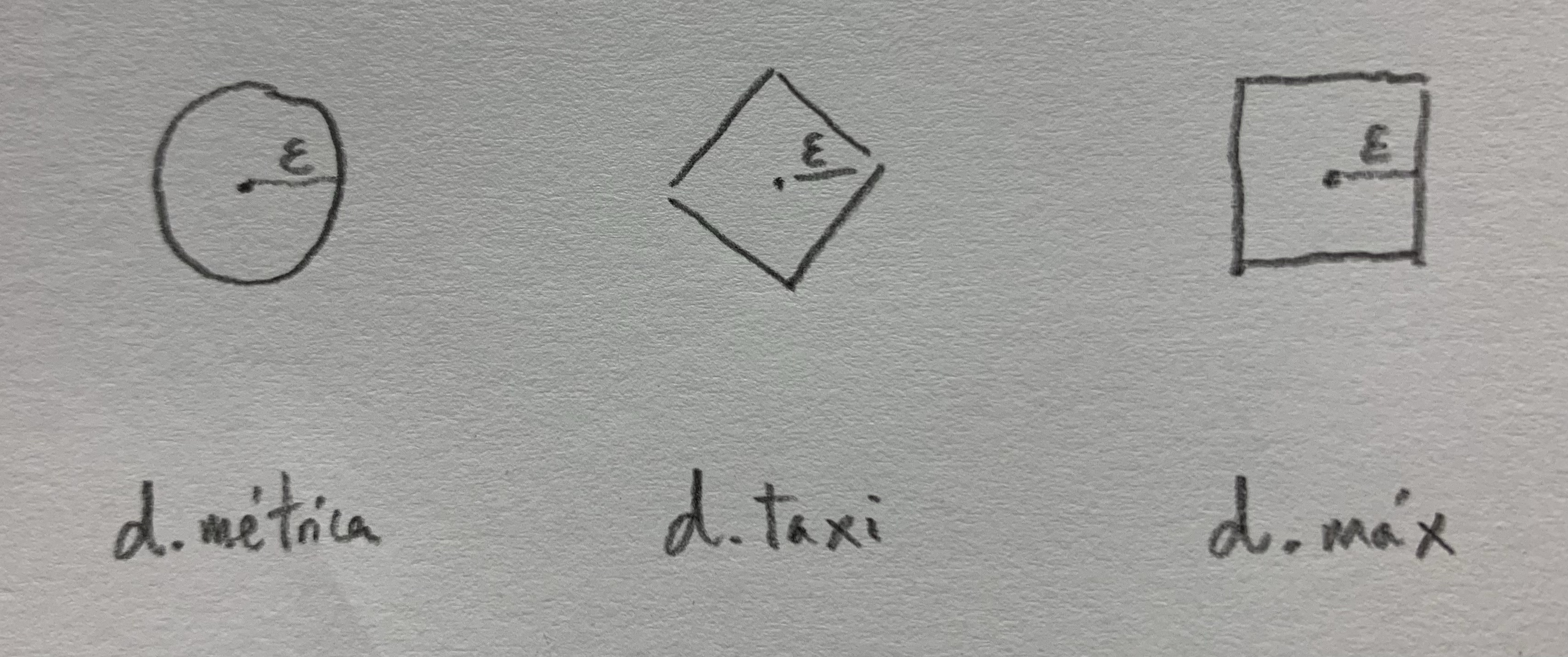

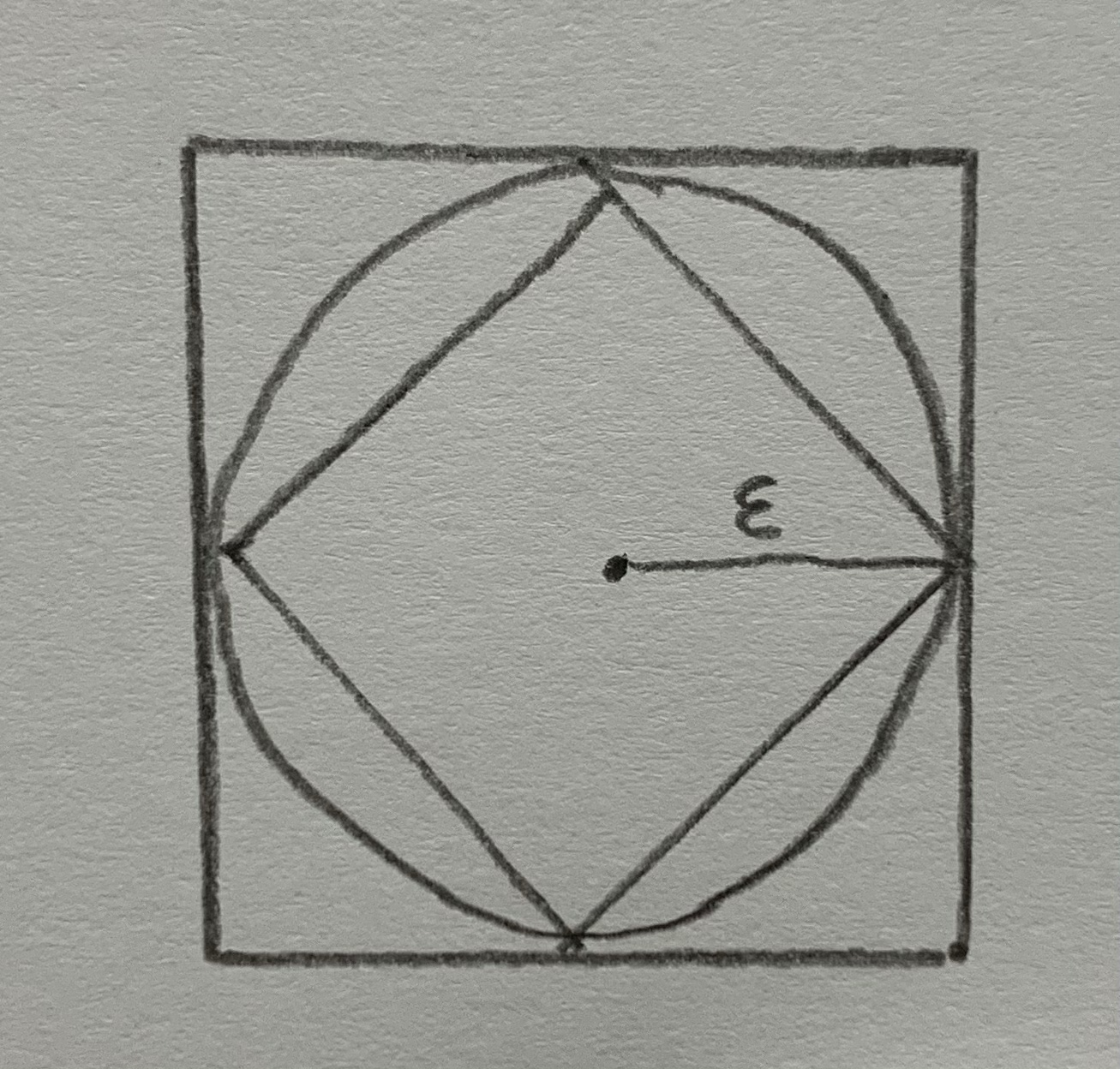

11. Veamos una comparación entre estas tres distancias:

El círculo en la métrica, el rombo en la distancia taxi y el cuadrado en la distancia del máximo delimitan puntos que están a una distanacia Épsilon del centro.

Se pueden superponer y ver cómo asignan valores diferentes de distancia a un mismo punto, o, por el contrario, asignan la misma distancia a puntos que no ocupan la misma posición; o sea, que no tienen las mismas coordenadas:

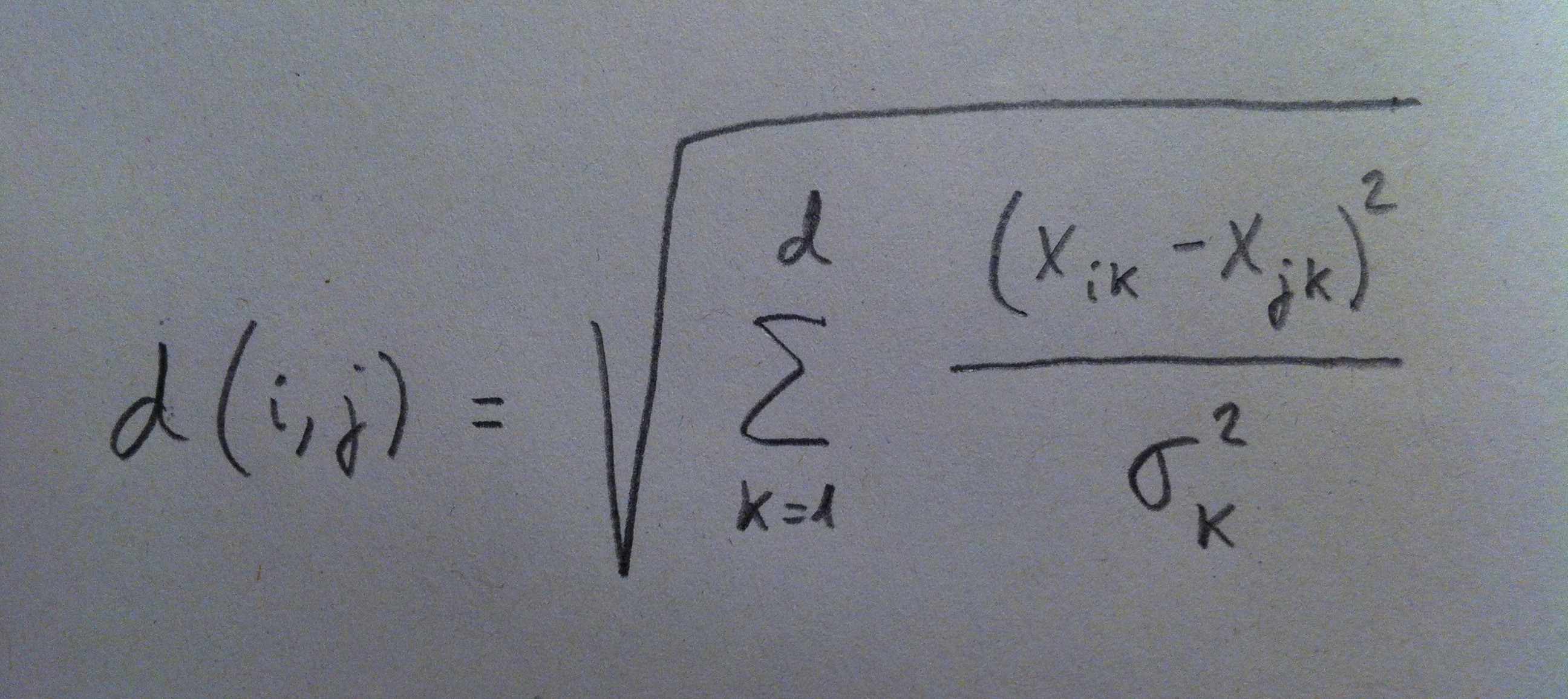

12. La distancia Mahalanobis es una distancia de mucho prestigio en Estadística Se trata de una distancia que tiene en cuenta no sólo las distancias que hay en cada una de las variables sino que cada una de estas distancias la relativiza respecto a la dispersión que tiene cada una de esas variables originales:

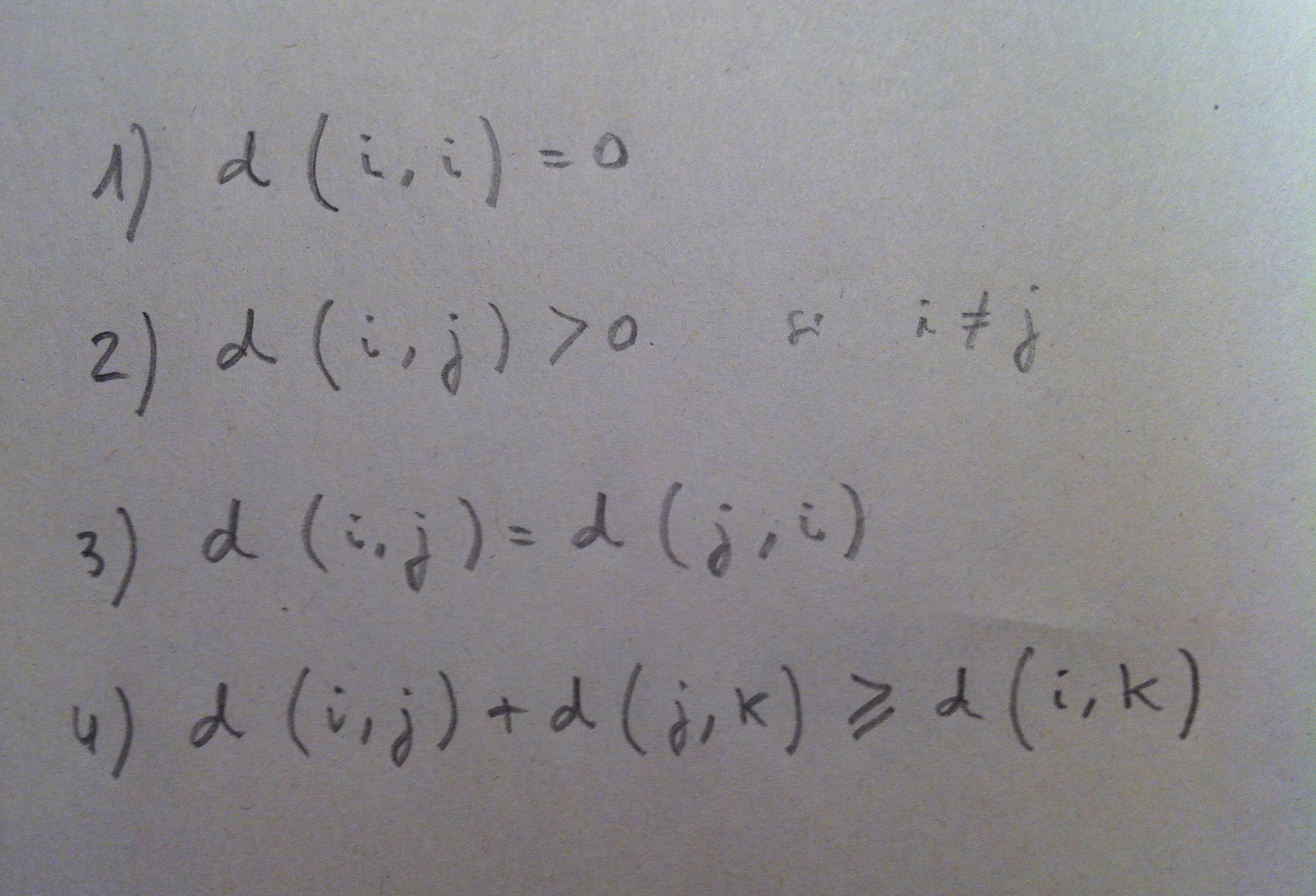

13. Hay muchas más distancias definidas y utilizadas. De hecho, para ser distancia una función debe cumplir las siguientes propiedades:

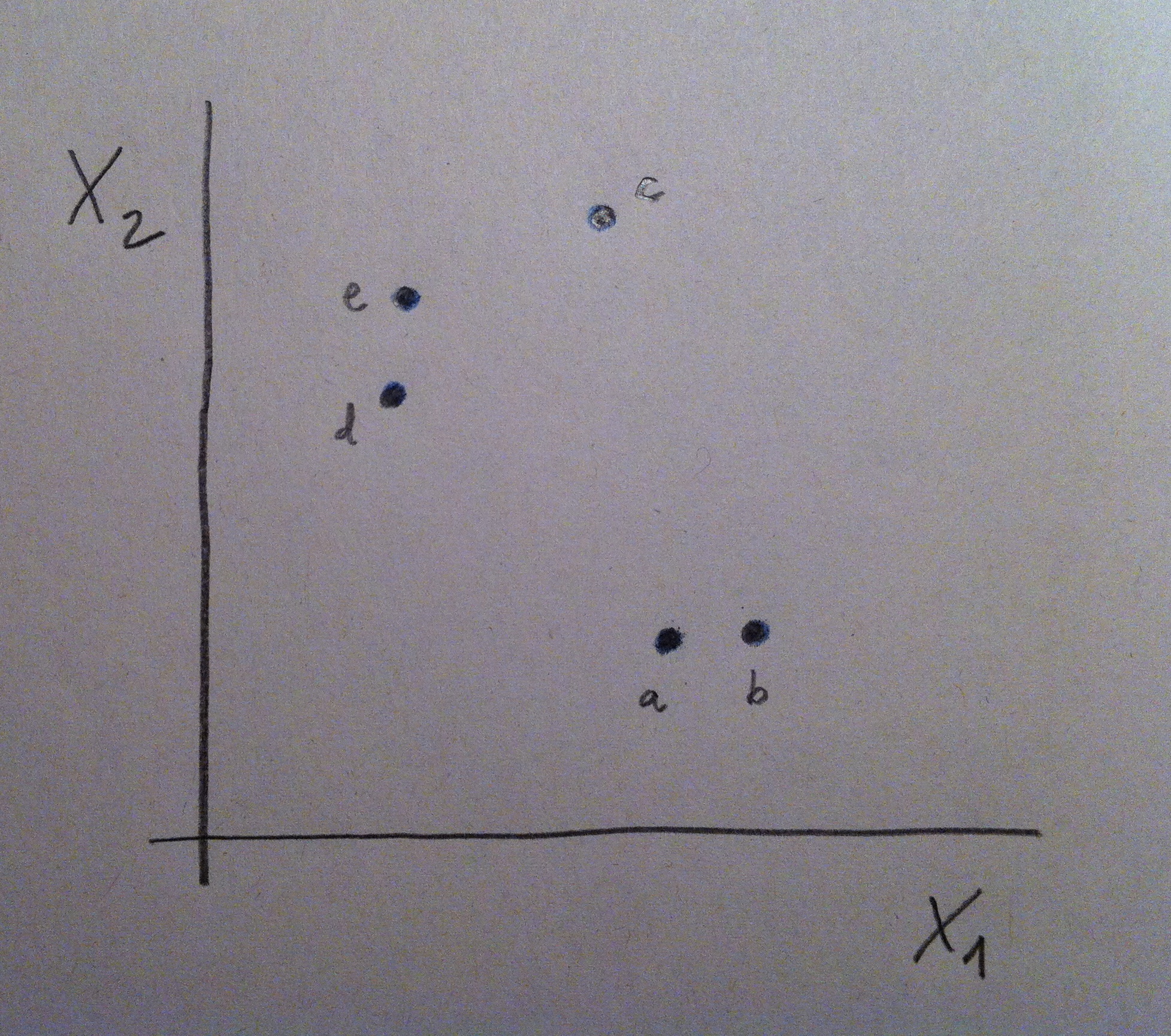

14. Veamos un ejemplo, en miniatura, para ver así qué pasos se siguen a la hora de hacer un AC. Vamos a ver un caso con sólo dos variables para visualizar con detalle microscópicamente todo lo que se hace, pero pensemos que lo que diga es perfectamente extrapolable al número de variables que sean. Supongamos los siguientes cinco individuos: a, b, c, d y e:

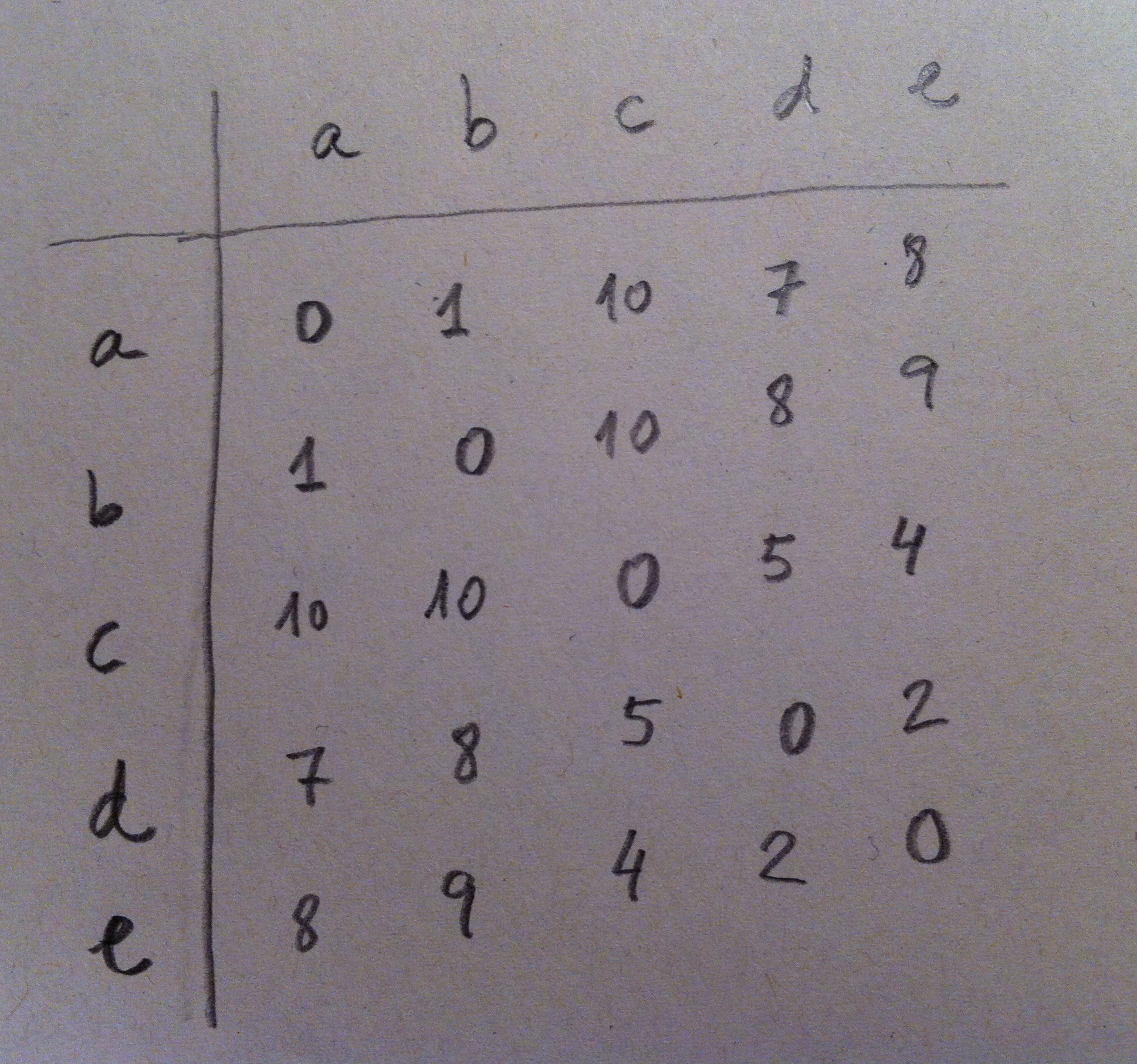

15. Vamos a construir, paso a paso, el dendrograma. Lo primero es elegir una distancia, como ya hemos dicho. Una vez elegida calcularíamos todas las distancias entre los puntos mediante esa distancia elegida. Obtendríamos, así, una matriz de distancias. Una matriz de distancias es una matriz cuadrada, simétrica y con la diagonal principal con ceros. Un ejemplo, en nuestro caso, sería la siguiente matriz:

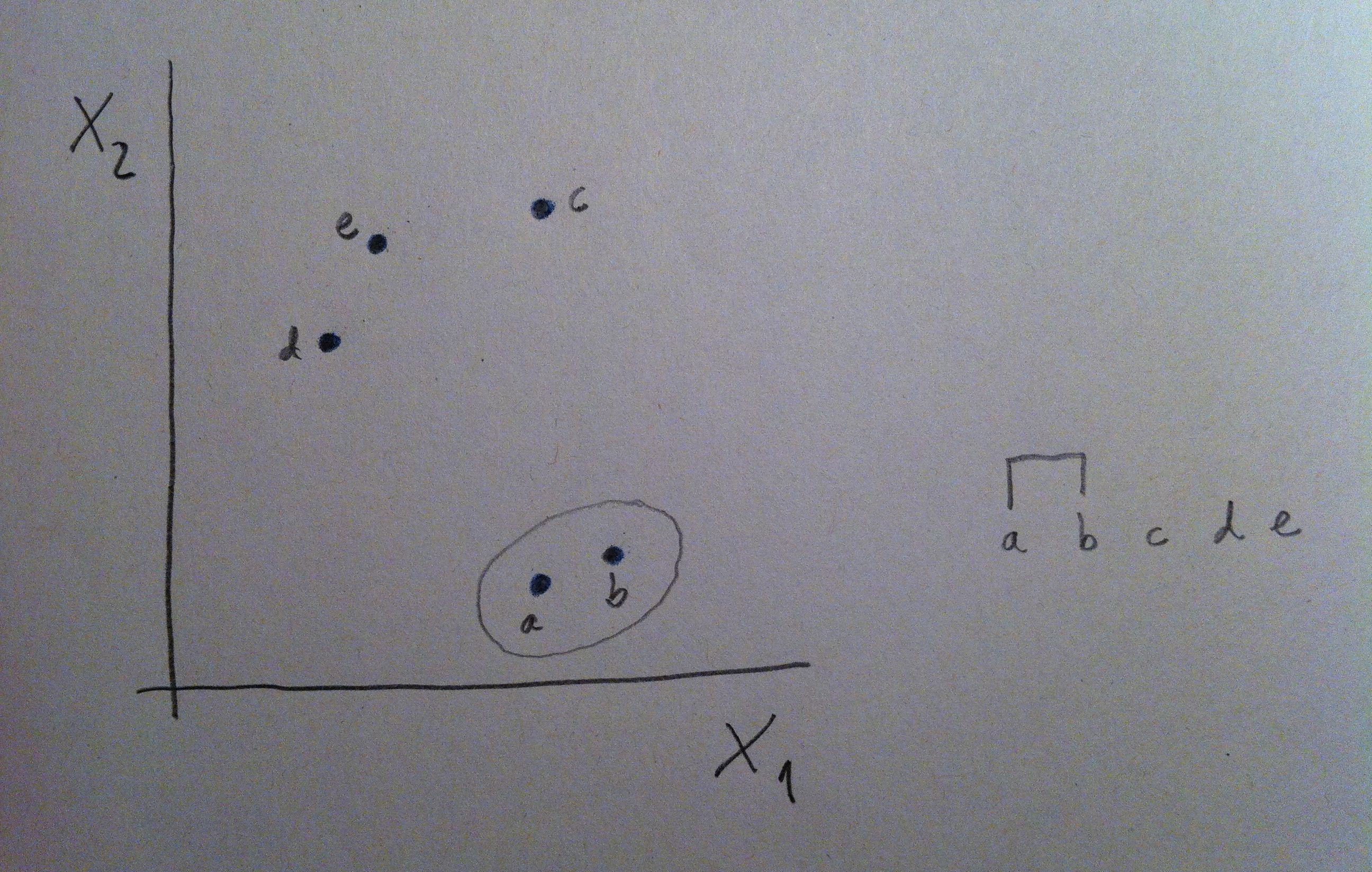

15. La primera agrupación de puntos se hace en base a la matriz de distancias. Se agrupan los dos puntos diferentes de distancia menor. En nuestro caso serían los puntos a y b:

17. Y, por lo tanto, realizamos la primera unión en el dendrograma, la unión entre a y b.

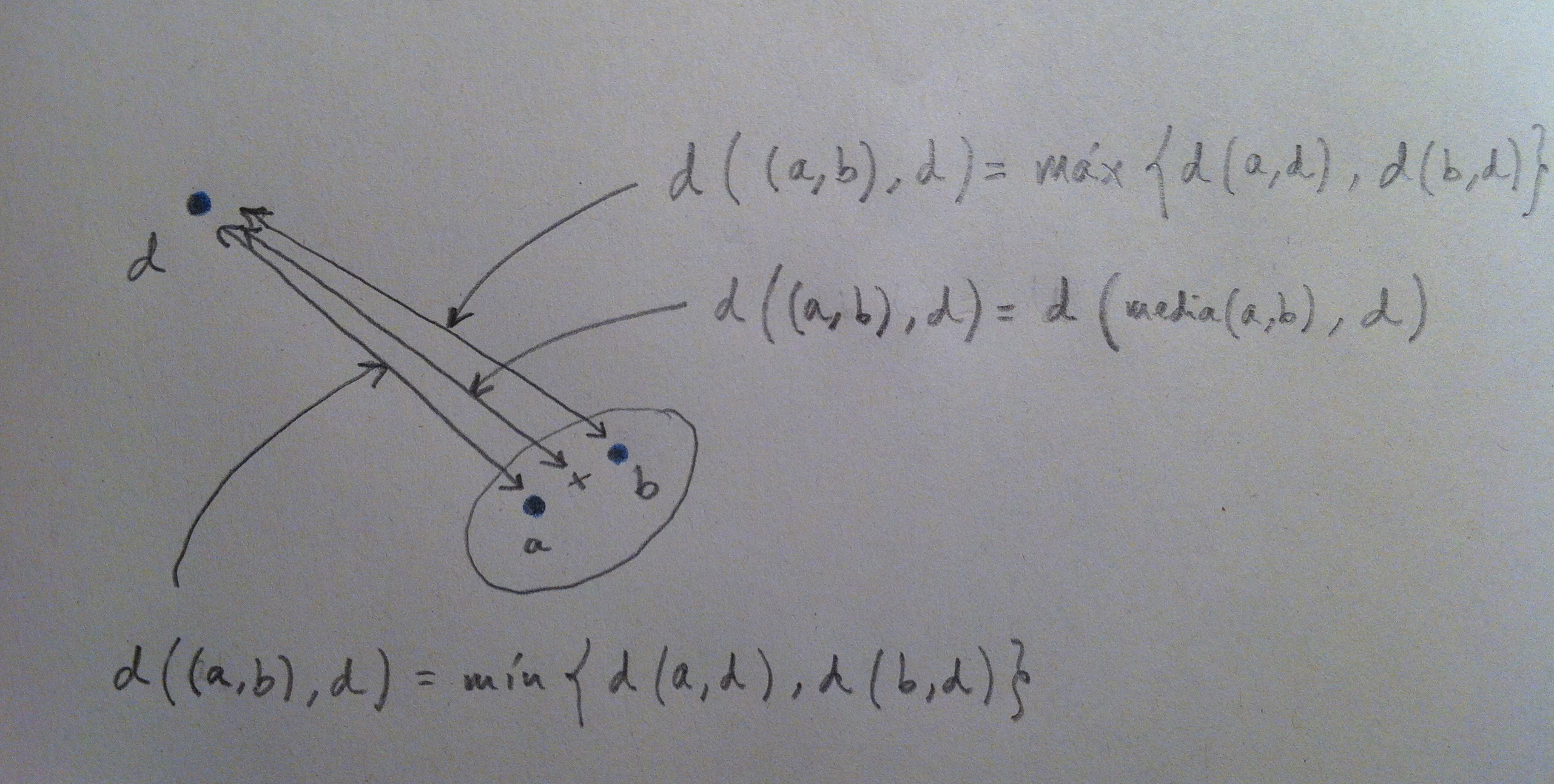

18. A continuación nos encontramos con un problema. Ahora tenemos, en realidad, cuatro entidades para medir distancias y continuar, pero el problema es que ahora tenemos que una de esas entidades, y así será ya continuamente, son un grupo de individuos. Por lo tanto, debemos definir cómo calcularemos la distancia entre un punto y un grupo de puntos que sea, también, un criterio que nos sirva para establecer la distancia entre dos grupos de puntos, porque esto también nos aparecerá a la que tengamos en un análisis un mínimo de dos grupos.

19. Se han establecido diferentes criterios para definir la distancia entre un punto y un grupo o la distancia entre dos grupos. Veamos tres ejemplos de esos criterios: 1) El criterio del mínimo. 2) El criterio del máximo. 3) El criterio de la media. Veamos un gráfico que ejemplifica en nuestro caso cómo calcularíamos estos tres criterios:

20. Según apliquemos un criterio u otro nos podemos a encontrar con agrupaciones diferentes. Si aplicamos uno de estos criterios, por ejemplo el de la media, nos encontraríamos que, en nuestro ejemplo, la distancia menor es la que hay entre los puntos d y e:

21. Y, si continuamos con el mismo procedimiento, ahora la distancia menor entre las tres entidades que nos quedan (el grupo (a, b), el grupo (d, e) y el punto c) será la que hay entre el grupo (d, e) y el punto c:

22. Y, finalmente ya, lo último es agrupar lo que queda:

23. Y tenemos, así, el dendrograma completo. Este es el procedimiento que sigue un software estadístico para construir el dendrograma, que es la forma de representación que persigue el Análisis clúster.

24. Pero observemos cómo hemos tenido que establecer dos decisiones claves que cambian el transcurso del proceso: La distancia con la que trabajar y el criterio de cálculo de distancia entre punto y grupo o entre grupo y grupo. Y según sea la elección el resultado puede cambiar, las agrupaciones pueden ser distintas. Es cierto que si las cosas son muy claras los resultados son prácticamente los mismos, sigamos el procedimiento que sigamos, pero no siempre sucede así.

25. Una opción que suele ser también interesante es hacer el Análisis clúster girando la matriz de datos; o sea, viendo las variables como individuos y los individuos como variables. Entonces agrupamos no individuos sino variables. Vemos la proximidad de unas respecto a otras, qué agrupaciones tendría sentido hacer, etc.

26. De hecho, si hacemos un AC, de una matriz de datos, primero con los individuos y luego con las variables, estamos cubriendo aquellas dos finalidades que persiguen tanto el ACP como el AF, que son: 1) Representar los puntos, visualizarlos. 2) Ver relaciones entre las variables, agrupaciones, conexiones entre ellas.

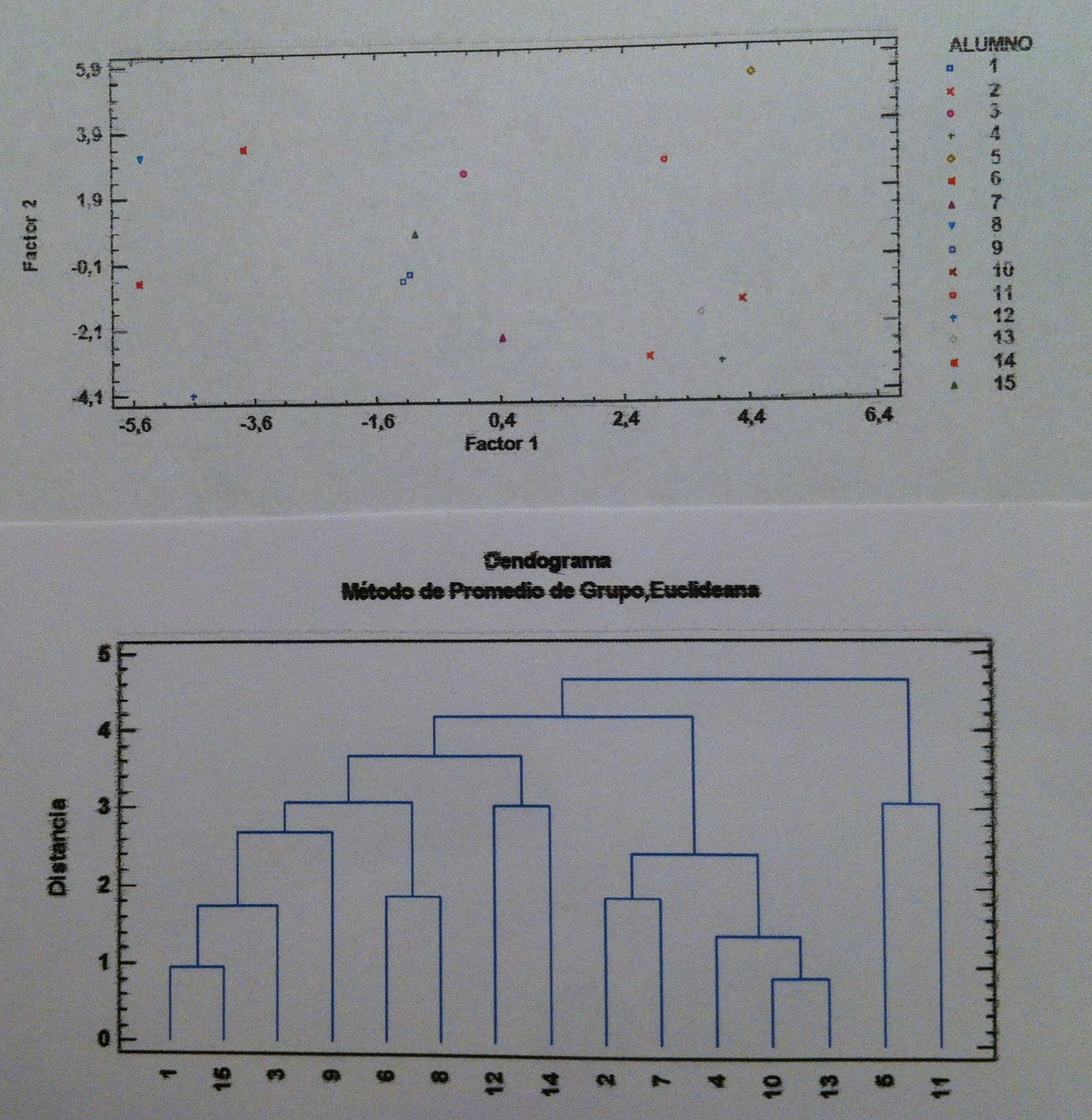

27. Veamos la aplicación del AC a los datos de los estudiantes que hemos visto en los temas dedicados al ACP y al AF. Al aplicar a los 15 alumnos para todas las variables; o sea, a la nube de puntos original, el AC con la distancia euclídea y el criterio de distancia entre punto y grupo o entre grupo y grupo el de la media del grupo, el dendrograma que se construye es el siguiente:

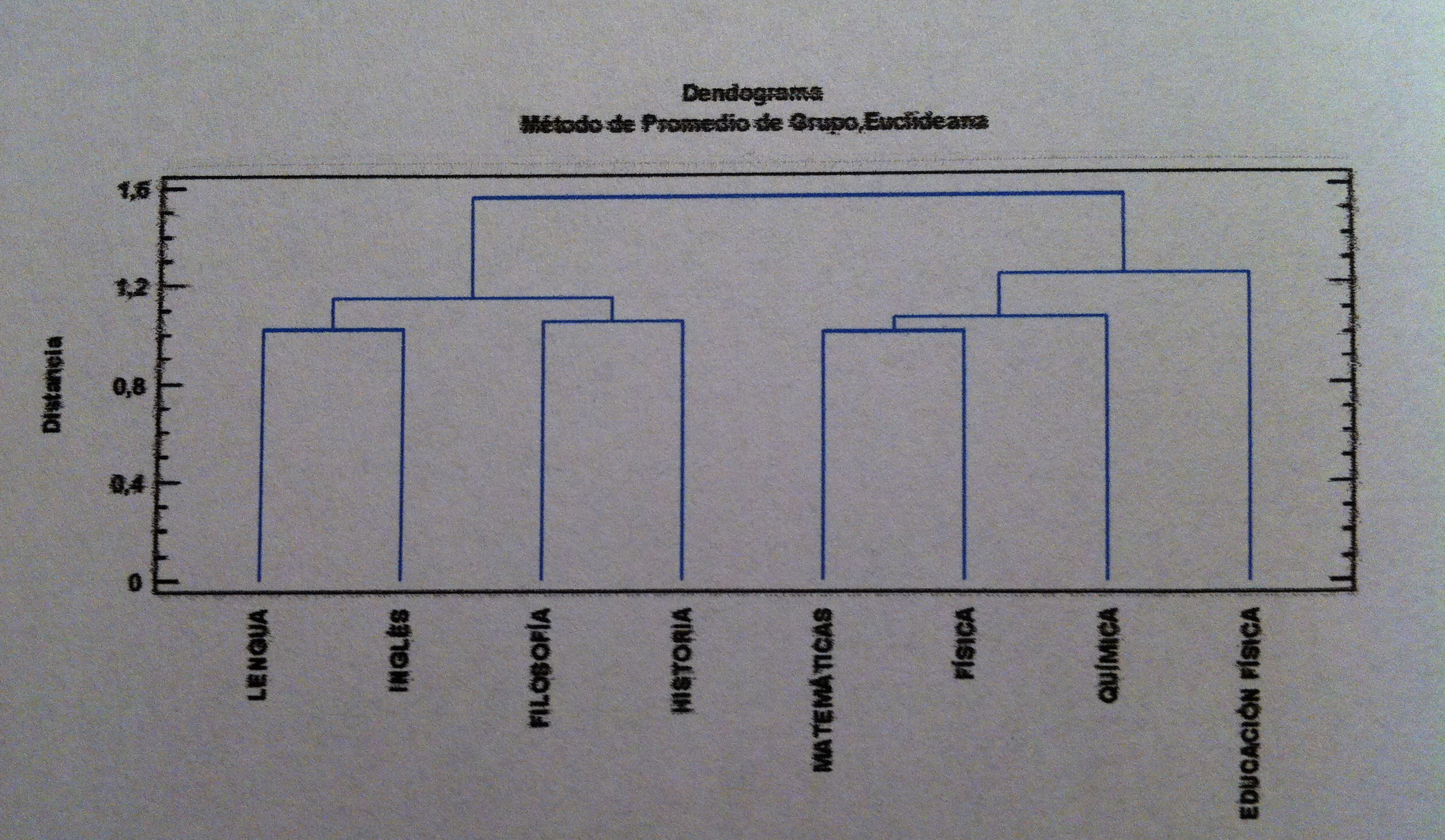

28. Si hacemos lo mismo pero ahora con las variables obtenemos el siguiente dendrograma:

29. Lo que muestra realmente lo que decíamos de la agrupación que se produce entre variables: Letras por un lado y Ciencias por otro. Aquí Educación acaba agrupándose primero con las ciencias que con las letras, pero es la última agrupación, si quisiéramos crear tres grupos de variables y cortáramos el dendrograma a nivel de obtención de tres grupos de variables tendríamos: Letras, Ciencias y Educación física.

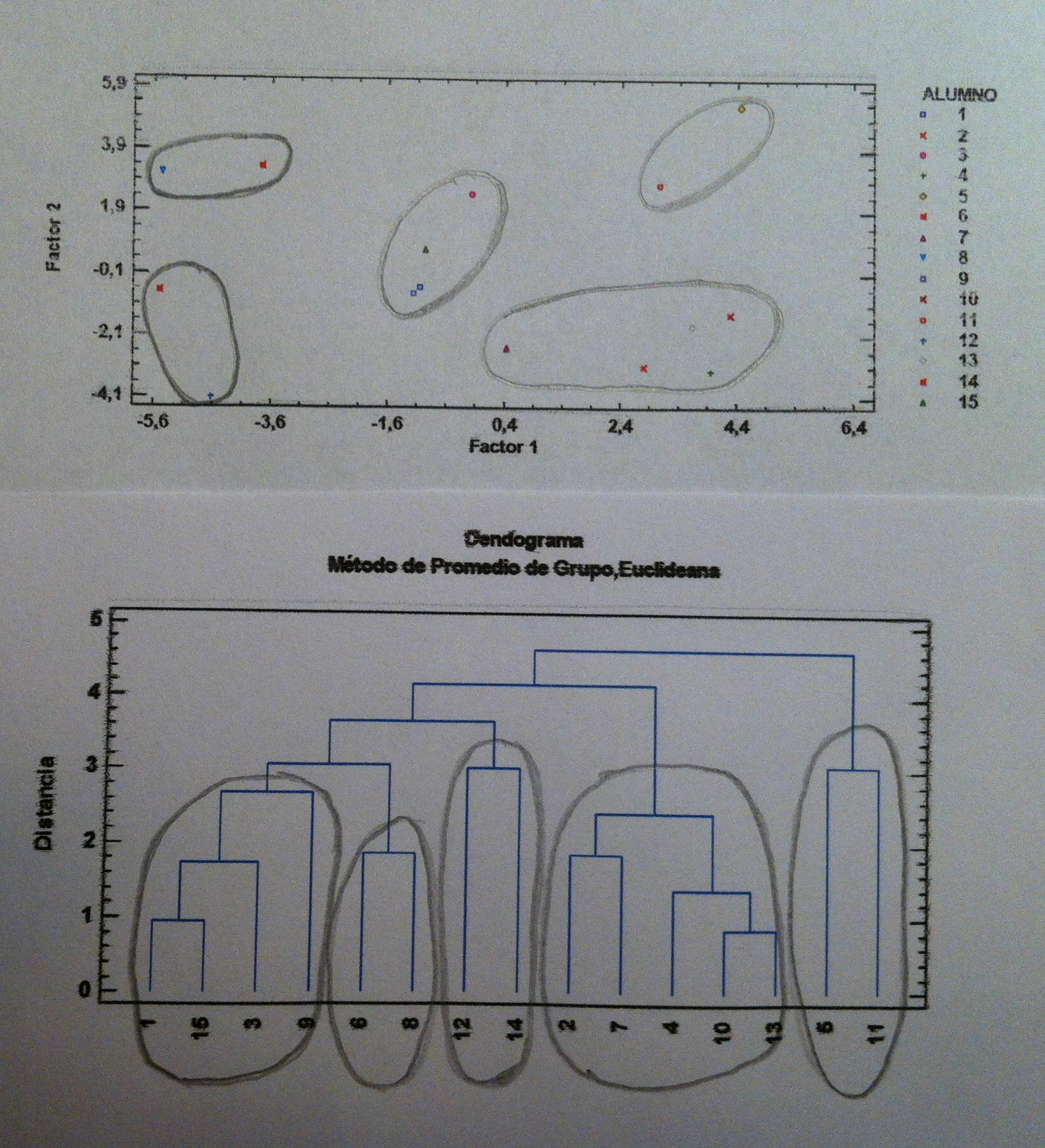

30. Es interesante comparar los resultados obtenidos, las representaciones dibujadas, con las tres técnicas: ACP, AF y AC a los mismos datos. Al final tenemos, como ya hemos dicho, dos formas muy distintas de hacer lo misma: la del ACP y AF, por un lado, y la del AC, por otro. Dos formas de representación muy distinta. Pero la finalidad fundamental de ambas es descriptiva: representar lo que no podemos visualizar en su estado original, hacer una representación aproximada, crear un modelo de aquella realidad que no tenemos. Y junto ahora las dos formas tan distintas de hacer lo mismo en un mismo gráfico. Pongo sólo el AF en representación de la opción generada por AF o por ACP:

31. Lo primero que vemos si comparamos ambos gráficos es que son dos representaciones muy distintas: como cuando vemos un cuadro de Picasso o de Velazquez. A lo mejor los dos intentan pintar lo mismo: las meninas, por ejemplo, pero lo hacen mediante técnicas pictóricas bien distintas. Una figurativa, la otra más abstracta. Pero con un poco de paciencia pueden irse estableciendo paralelismos entre ambos gráficos igual que con las merinas de Velazaquez y de Picasso.

32. El 5 y el 11 forman un grupo: son los alumnos que son buenos tanto en ciencias como en letras. El 2, 7, 4, 10 y 13 forman otro grupo: son los alumnos buenos en letras pero malos en ciencias. El 6 y 8 otro grupo: son los alumnos buenos en ciencias pero malos en letras. El 12 y 14: el grupo de los malos en ciencias y en letras. Finalmente, hay un grupo formado por el 1, 15, 3 y 9 que están en medio, que les va todo justo, están en la frontera entre el aprobado y el suspenso tanto en ciencias como en letras. Veámoslo en el siguiente gráfico que es el mismo de antes pero con estos grupos marcados tanto en una como en la otra representación:

32. Como puede verse estamos haciendo cosas similares aunque a través de procedimentos bien distintos.

Tema 18: ANÁLISIS FACTORIAL

1. El punto de partida del Análisis factorial (AF) es el mismo que el del Análisis de componentes principales (ACP). De hecho, como explicaré más adelante, en realidad, el ACP es un AF que, debido a su simplicidad y su aplicabilidad, se ha independizado y ha adquirido vida propia. Hemos visto primero el ACP porque es más sencillo en cuanto a maquinaria y, por razones, didácticas es mejor empezar por él.

2. La finalidades del AF son, pues, las mismas que teníamos en el ACP: 1) Conseguir una representación gráfica de una realidad que es imposible representar en toda su extensión, visualizar una visión aproximada de una nube de puntos original que es imposible visualizar por exceso de dimensiones. 2) Conseguir combinaciones de las variables originales que nos ayuden a discernir tipos de relaciones que se establecen entre las variables del estudio.

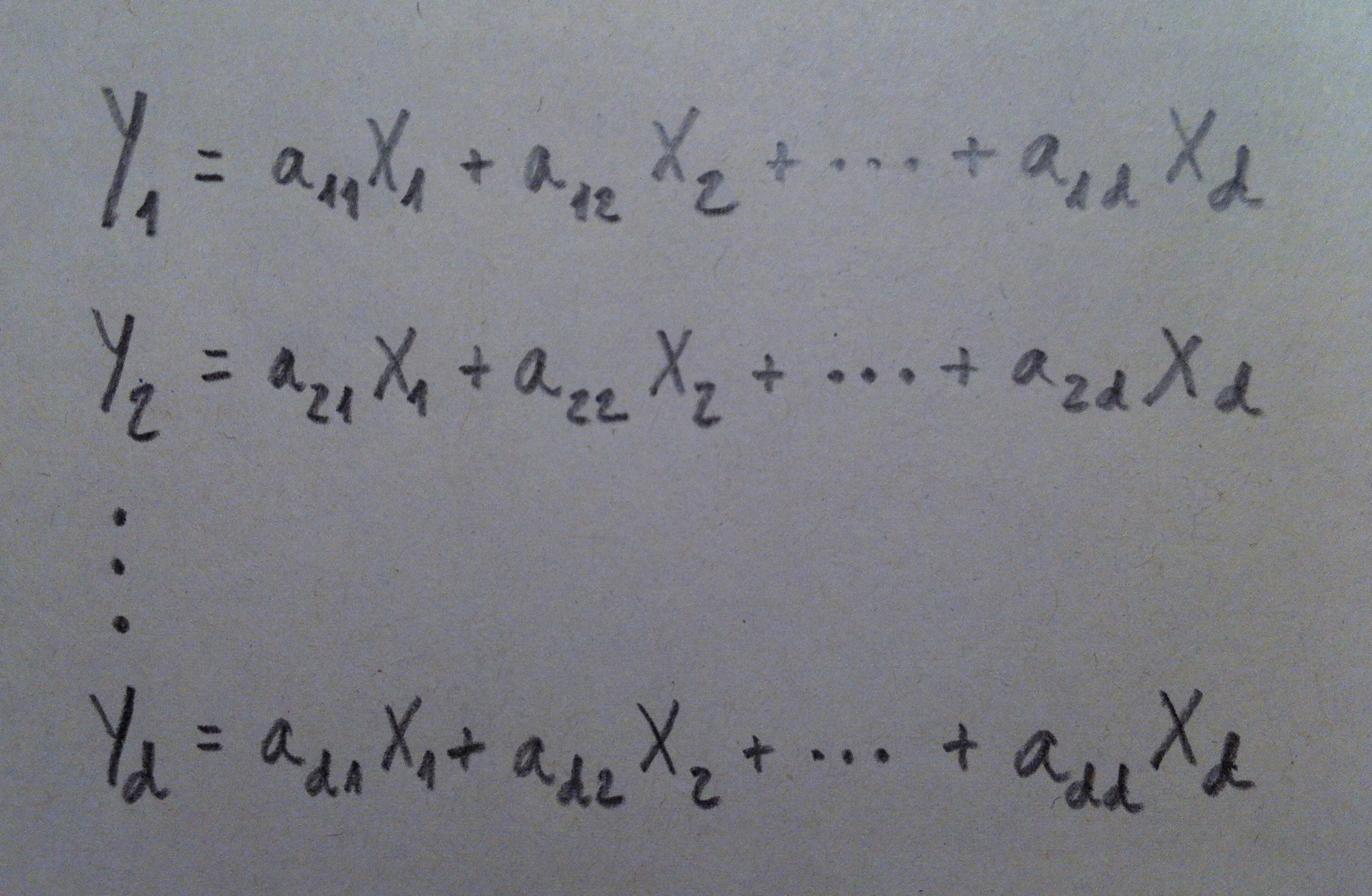

3. Recordemos, en primer lugar, en formato matemático, cuál era el procedimiento del ACP. Se trataba de crear unas nuevas variable (la componentes) que tuvieran una gran diferencia entre la variabilidad explicada y que, cada una de ellas fuera combinación lineal de las variables originales:

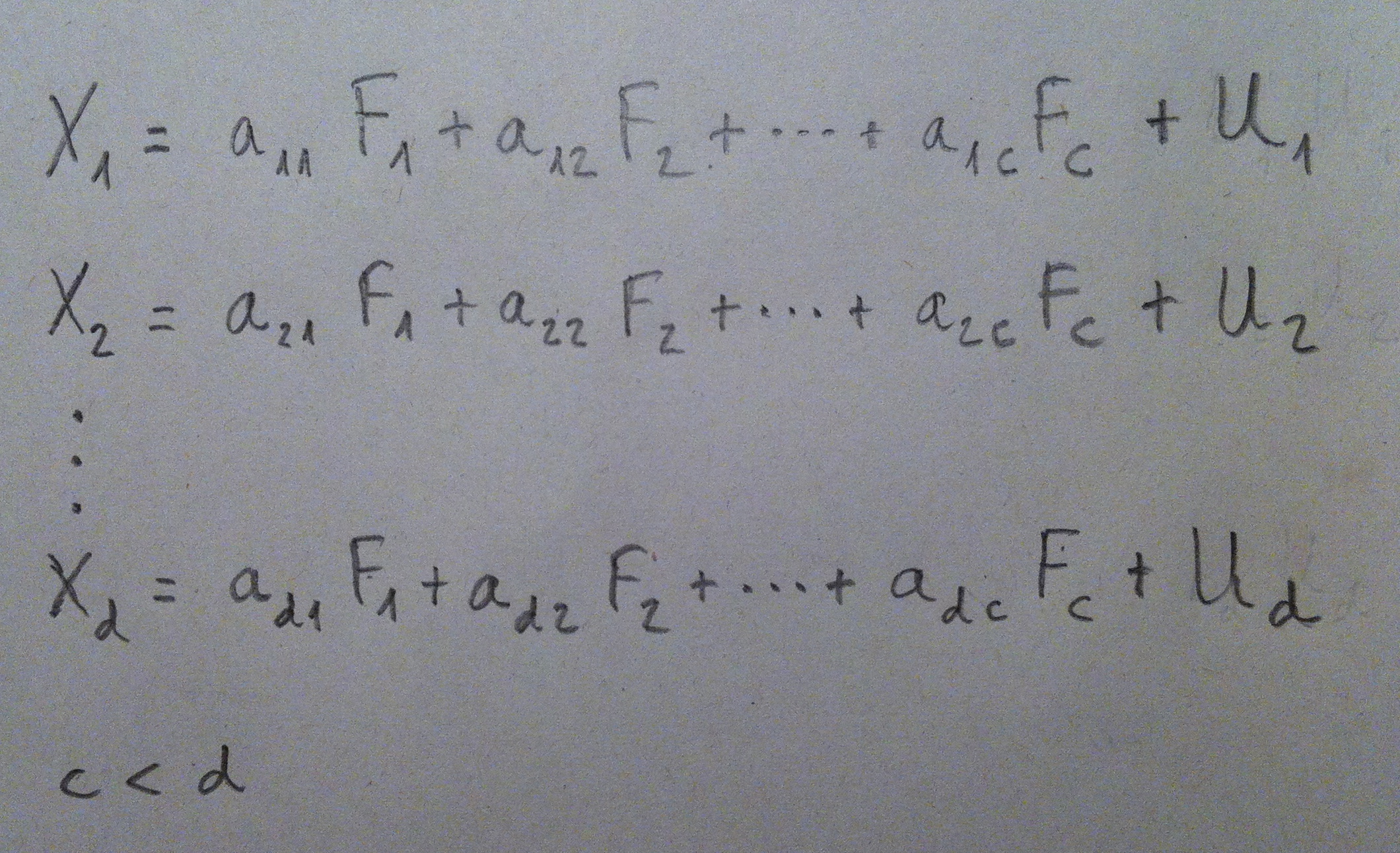

4. De d variables originales obtenemos d componentes, pero nos quedamos únicamente con las primeras, las principales, por almacenar en su interior mucha más información de la nube de puntos original. El formato matemático del AF es este otro:

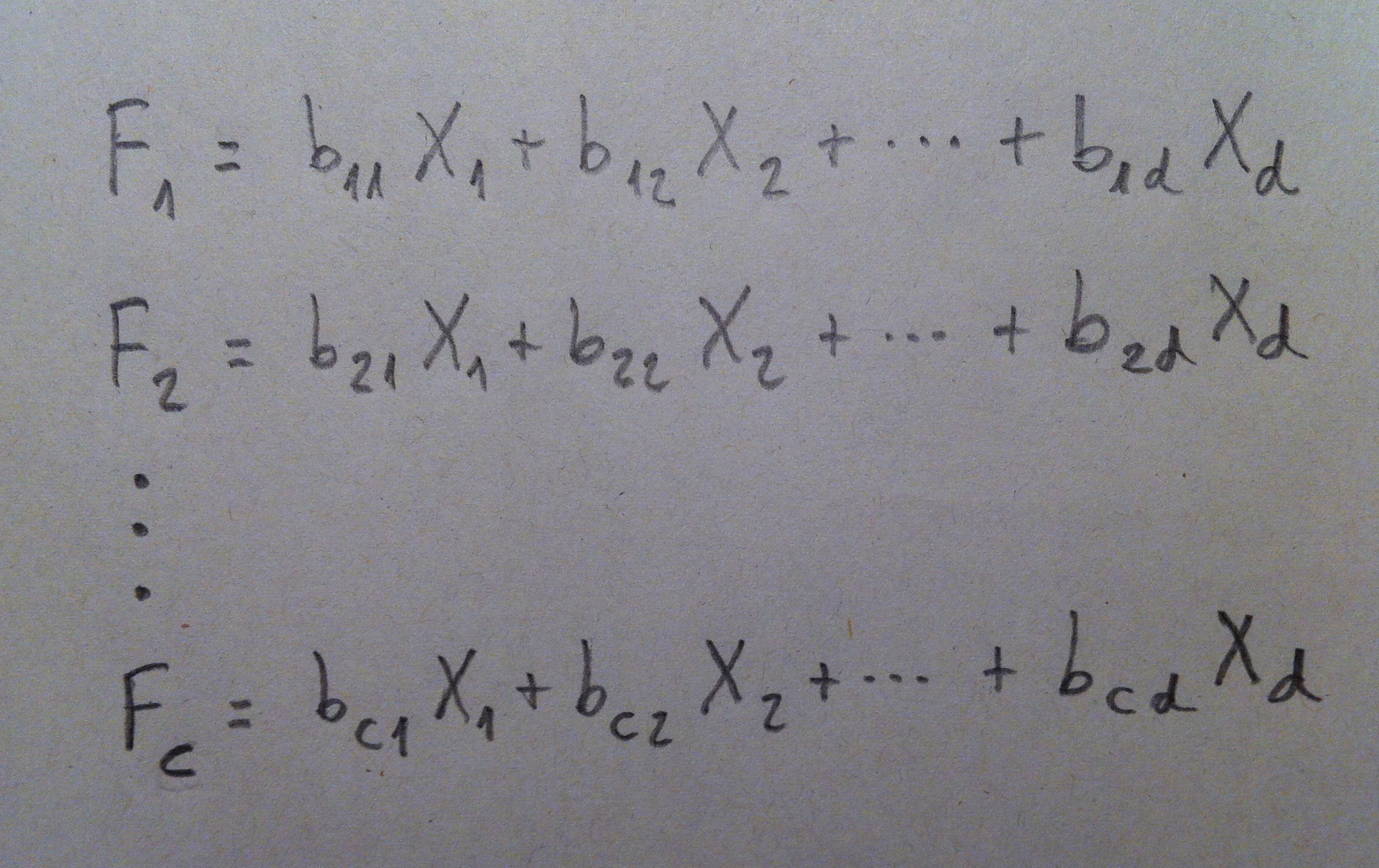

5. A las variables F1, F2, …, Fc, las llamamos factores. Importante que c sea menor que d. En realidad, interesa que sea mucho menor, que con dos o tres factores tengamos suficiente, como con la componentes principales: interesa que unas pocas acumulen mucha información, mucha varianza de la nube de puntos original. Cada uno de los factores es, también, como las componentes, una combinación lineal de todas las variables originales:

6. Como puede apreciarse estos factores son como las componentes. Los factores son independientes entre ellos, también, como las componentes. Pero no se crean d factores sino que se crean un número c que es siempre menor que d, como ya hemos dicho antes.

7. El conjunto de estos factores constituyen la llamada comunalidad. Esto es muy interesante. Observemos aquí la diferencia con el planteamiento del ACP. En el AF escribimos cada una de las variables originales como una combinación de esos factores comunes. Los factores son, por lo tanto, elementos que están en el interior de esas variables, como sus elementos indisociables. Los factores son como si fueran las piezas profundas de lo que está hecha la diversidad de las variables que vemos y cuantificamos. Los factores serían, pues, como los átomos que se combinan, en proporciones distintas, en las moléculas (que serían las variables del estudio).

8. Las variables U1, U2, …, Ud son las llamadas unicidades, porque cada una de ellas es única y distinta en cada una de las variables originales. La comunalidad capta lo común, las unicidades suman lo diverso.

9. Las unicidades son una especie de Residuo, un elemento individual de cada una de las d variables originales y que es lo que queda por explicar de cada una de ellas después de haber sumado una combinación peculiar y única de los factores en cada una de ellas, después de haber introducido en ellas lo que tienen de la comunalidad, de lo común, de lo que se explica por los factores comunes elegidos.

10. Es muy importante comparar el AF con el ACP, porque en esa comparación está el elemento diferencial entre esas dos técnicas y será precisamente esta comparación la que nos ayudará a encontrar la singularidad del Análisis que ahora nos ocupa.

11. Lo primero a distinguir es que en el ACP tiene solución única, lo que significa que, cuando se pone en marcha la maquinaria de la técnica frente a unos datos, hay una única solución, la que proporciona, como hemos visto, los valores propios y los vectores propios. La única opcionalidad que tenemos es, como ya hemos dicho en el tema dedicada al ACP, trabajar con la matriz de correlaciones o la de varianzas-covarianzas. Sin embargo, en el AF, no hay una única solución, hay distintas formas de extracción de los factores y cada una de ellas da lugar a un resultado distinto. Al separar una parte común (la comunalidad: los factores) y una parte única (las unicidades) de cada una de las variables originales, estamos creando las condiciones para generar formas distintas de llegar a esa situación y, por lo tanto, que haya soluciones distintas.

12. Al no haber una solución única, como sucede con el ACP, se han diseñado muchas formas de extracción de los factores. Posiblemente el sistema de extracción de los mínimos cuadrados sea el más usual, pero hay otros, por ejemplo: Método del centroide, Método de Jacobi, Método de la máxima verosimilitud. De hecho, el propio sistema de las componentes principales es también un método de extracción de factores: mediante ese método se seleccionan las dos o tres primeras componentes conviertiéndolas en los factores. Observemos que entonces las componentes Y las convertimos en factores F. Hay que decir que, aunque sean muchos los métodos de extracción, en realidad son pocos los que han sido implementados en los principales software estadísticos.

13. El sistema de los mínimos cuadrados, que es uno de los métodos más usado, se basa en la búsqueda de la recta, del plano o del hiperplano (dependiendo del número de factores elegidos) que minimice las unicidades, que actuarían aquí como el residuo de la Regresión. Es un planteamiento derivado, evidentemente, de la Regresión lineal.

14. Gráficamente esto que estoy diciendo se puede ilustrar de la siguiente forma: Dada una nube de puntos según el criterio que sigamos puede ser que el factor generado sea ligeramente diferentes. Por ejemplo, en el siguiente caso la recta roja podría seguir el criterio de las componentes (la búsqueda de la máxima variabilidad en el primer eje) y la recta verde podría seguir el criterio de los mínimos cuadrados:

15. La segunda diferencia entre el ACP y el AF está en la idea de rotaciones presente en el AF y que no lo está en el ACP. Una vez se han extraído los factores, cada uno de ellos es, como hemos visto, una determinada combinación de las variables originales, combinación caracterizada por una serie de coeficientes que multiplican a esas variables y que están asociados a cada factor. Pues bien, esos factores se pueden rotar según criterios distintos. Se trata de pequeños giros de los nuevos ejes de coordenadas con la finalidad de mejorar algún aspecto prefijado.

16. Rotar implica que cambien los coeficientes. Cualquier cambio de los ejes supone un cambio de los coeficientes. Si con ligeros cambios de los ejes, y, por lo tanto, de los coeficientes, se pierde poca capacidad de representación y se gana en algún criterio prefijado, entonces vale la pena la rotación.

17. El método de rotación más usual es el Varimax que minimiza el número de variables, en cada factor, con coeficientes elevados en valor absoluto.

18. Pensemos que el juego de muchos coeficientes actuando en un factor, en el AF, o en una componente principal, en el ACP, puede dificultar mucho su interpretación. Es difícil ponerle entonces nombre a esa macrovariable. La rotación Varimax realiza una rotación que simplifica, lo más posible, el repertorio de coeficientes. Se consigue que haya menos coeficientes con valores absolutos grandes pero que esos valores absolutos sean más grandes que sin la rotación. Esto aclara la interpretación, generalmente.

19. Existen otros criterios de rotación: Quartimax, Equamax, etc, pero son de largo mucho menos utilizados que el Varimax. Evidentemente la rotación es una opción, no una obligación. Puede hacerse un Análsis factorial sin rotación.

20. Por lo tanto, ante un AF debe decidirse el método de extracción y, luego, si se hace o no rotación. Si se hace rotación debe decidirse con qué criterio, con qué método de rotación.

21. Visto todo esto podemos situar ahora el ACP como un AF especial, tan especial que ha conseguido independizarse, como ya hemos dicho antes. El ACP es un AF al que se le aplica como método de extracción el de las componentes principales y al que no se le aplica ninguna rotación.

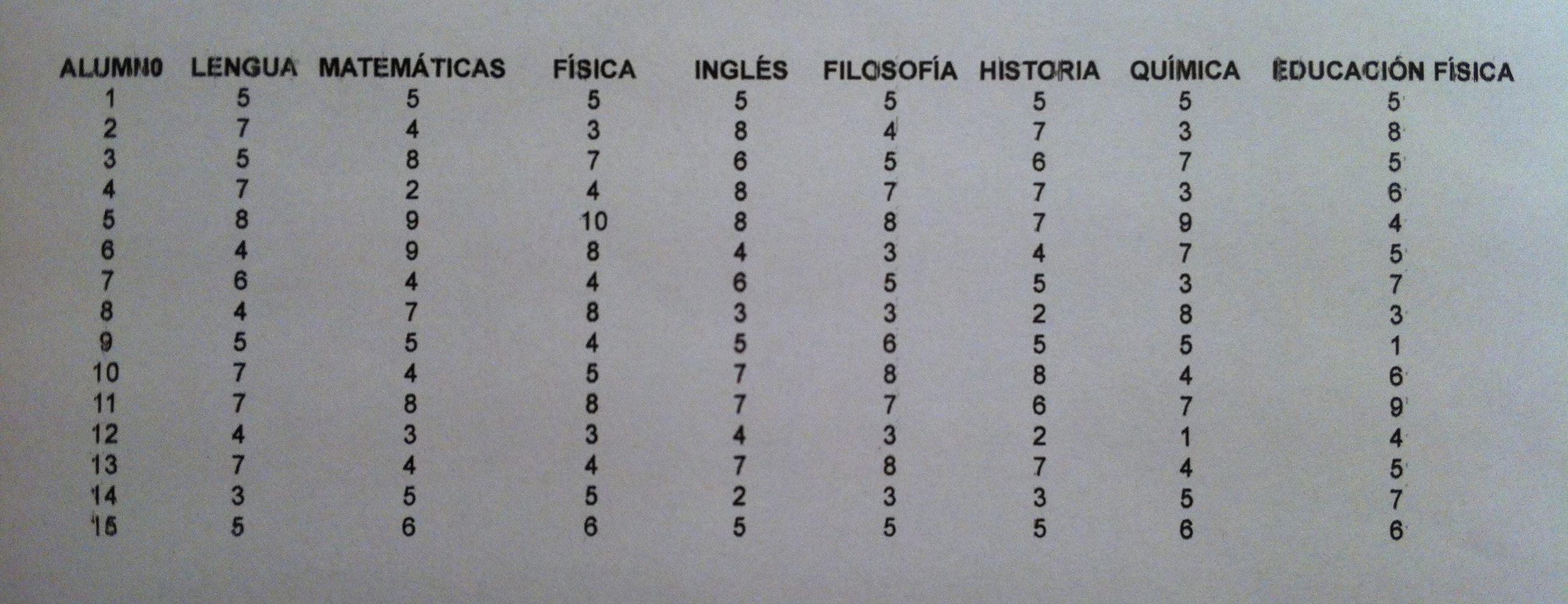

22. Vamos a aplicar el AF a los datos de las notas de 15 estudiantes en ocho materias diferentes que usamos para aplicar el ACP. Recordemos la matriz de datos:

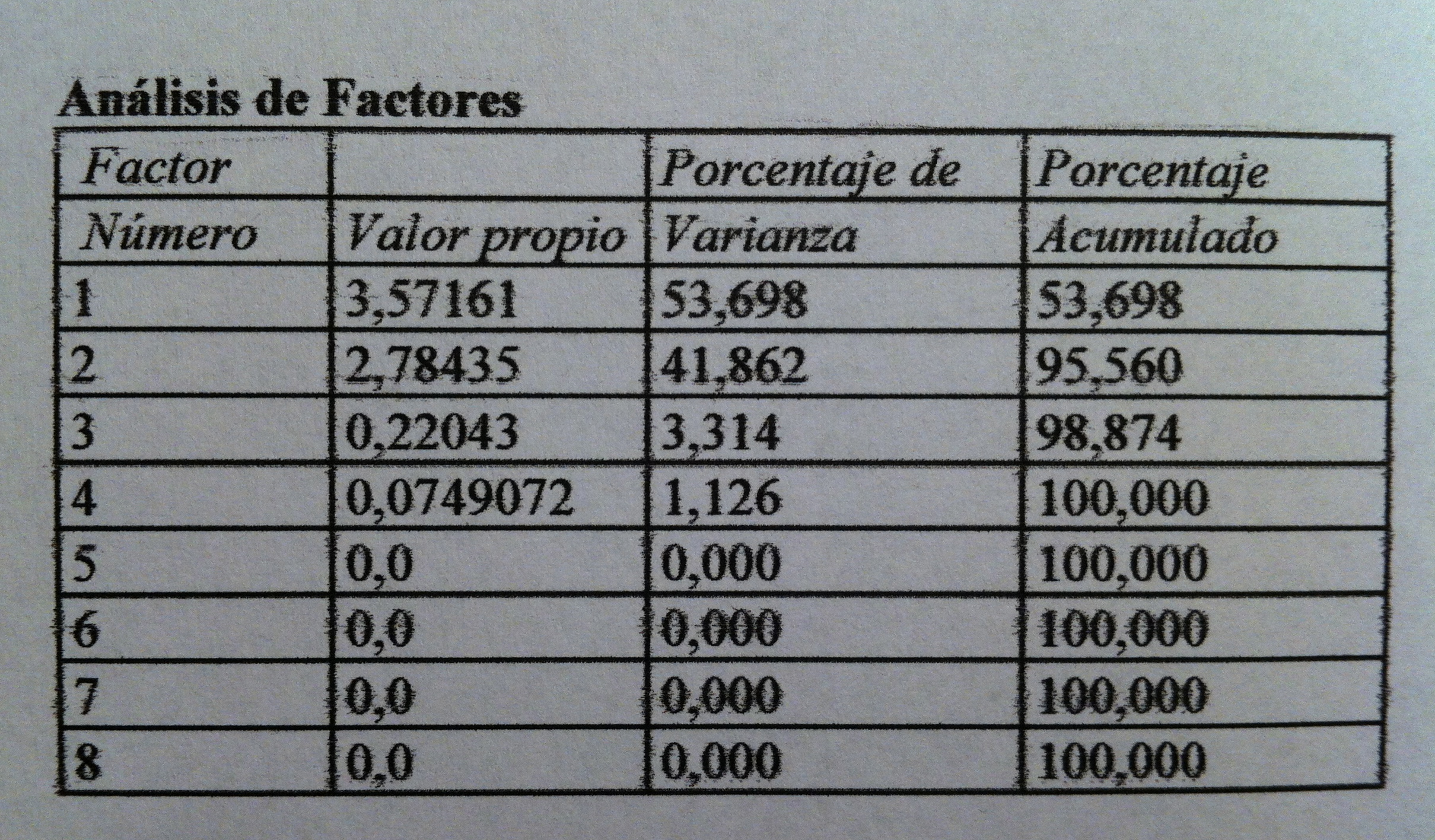

23. Si aplicamos el método de extracción de los mínimos cuadrados y la rotación varimax conseguimos los siguientes valores propios de la matriz de correlaciones:

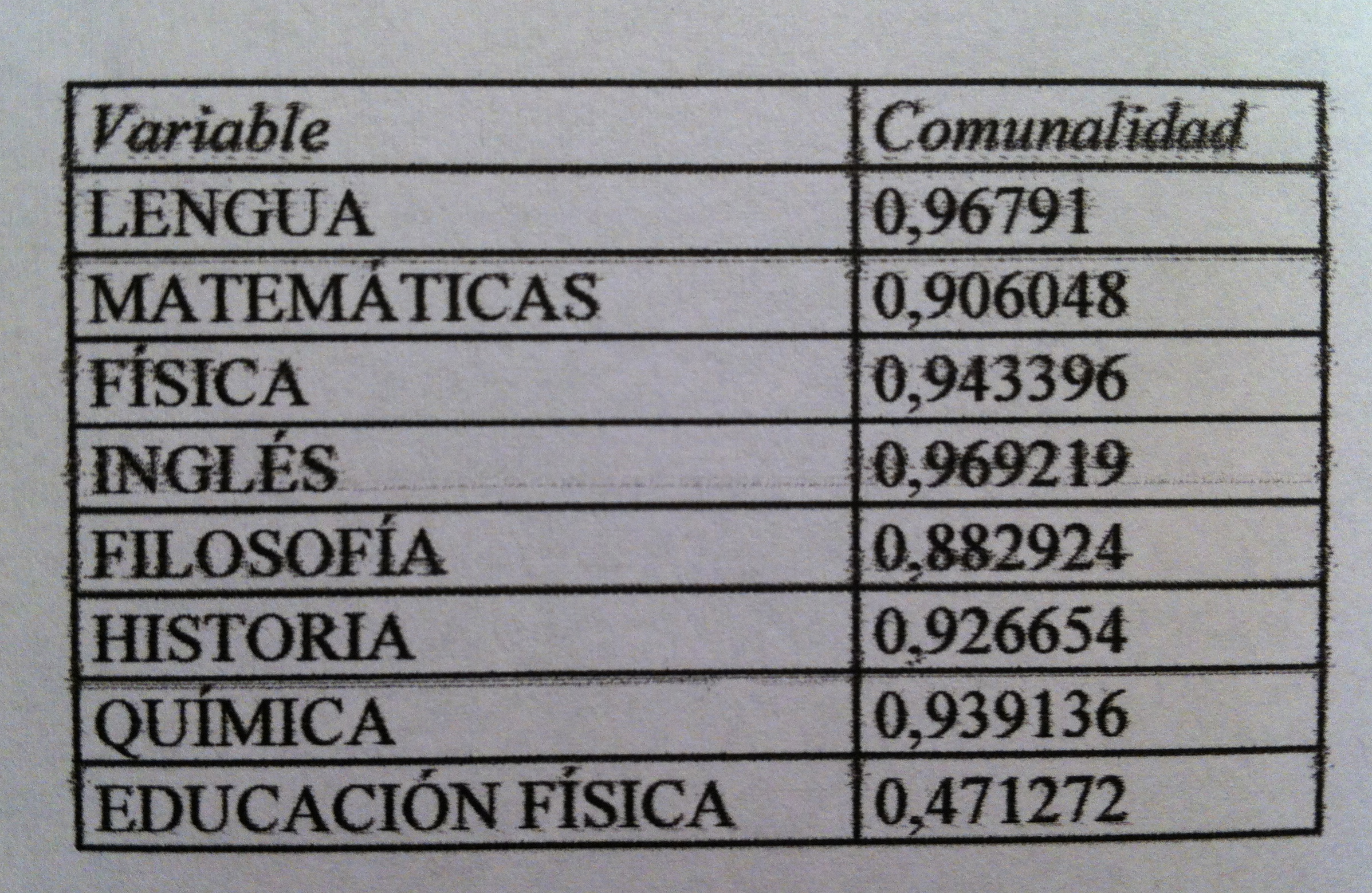

23. Con dos factores explicamos, por lo tanto, el 95.56 de la varianza. La comunalidad es la siguiente:

24. Esto significa que los dos factores seleccionados explican estos tantos por uno de estas variables originales. Son todos muy altos (suele entenderse por alto a partir de 0.75 ó 0.8). El único que no llega a este nivel es la variable Educación física. Se trata de una variable que si le sumamos los factores combinados de alguna forma sólo conseguimos explicar el 47.12% de su medida, por lo tanto, tiene una elevadísima unicidad no contemplada en los factores. Esto ya lo veíamos en el ACP: la Educación física va un poco por libre, mide un tipo de cosas que no tiene relación con lo que miden las otras materias.

25. El número de factores elegidos será el resultado de valorar dos cosas: 1) Que mediante ellos obtengamos un porcentaje de explicación como mínimo del 75-80% y esto lo veremos mediante los valores propios. 2) Que la comunalidad de las variables originales, o al menos del grupo de ellas que especialmente queremos explicar, sea también, al menos del 75-80%, o de 0.75-0.8, en tanto por uno.

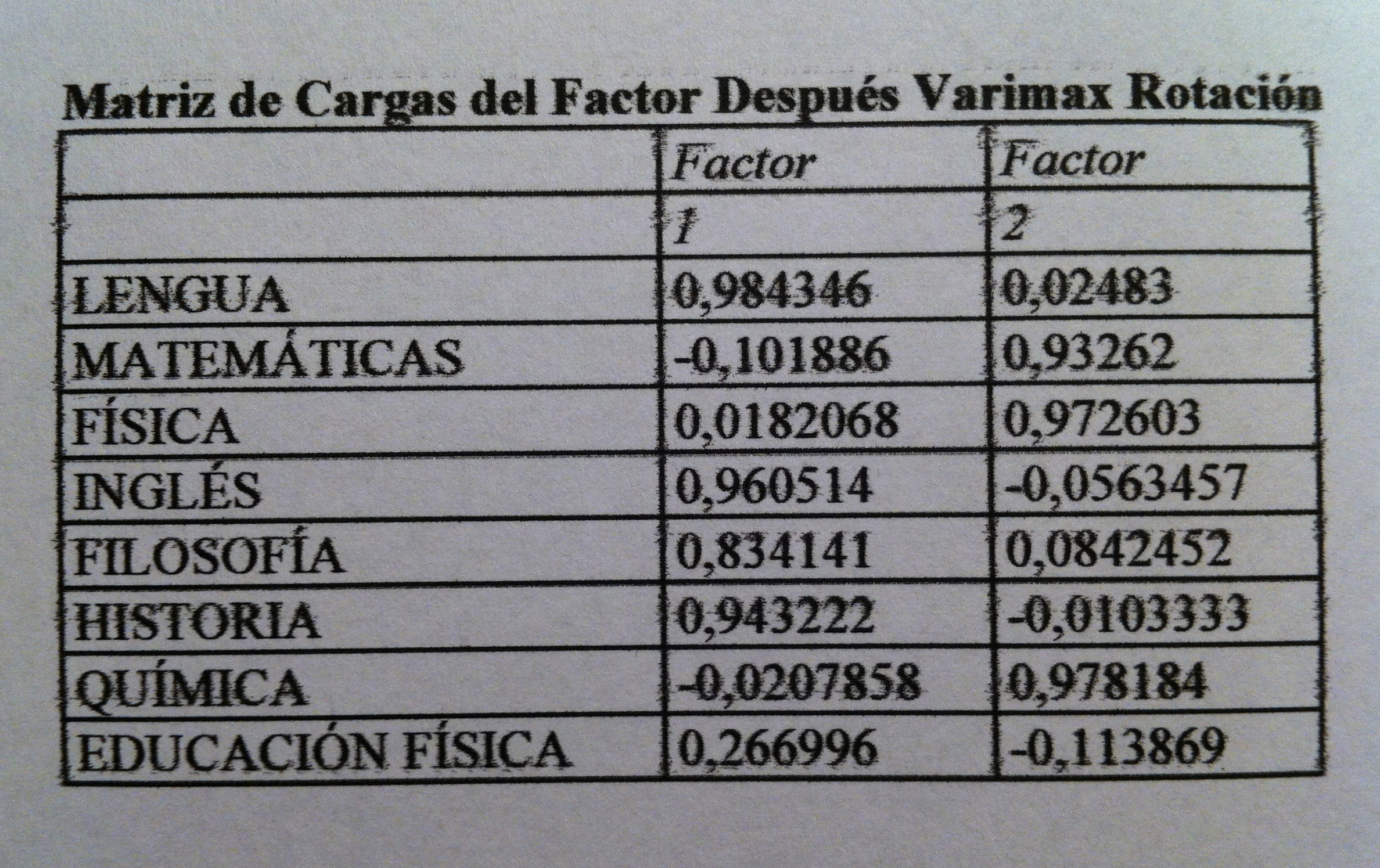

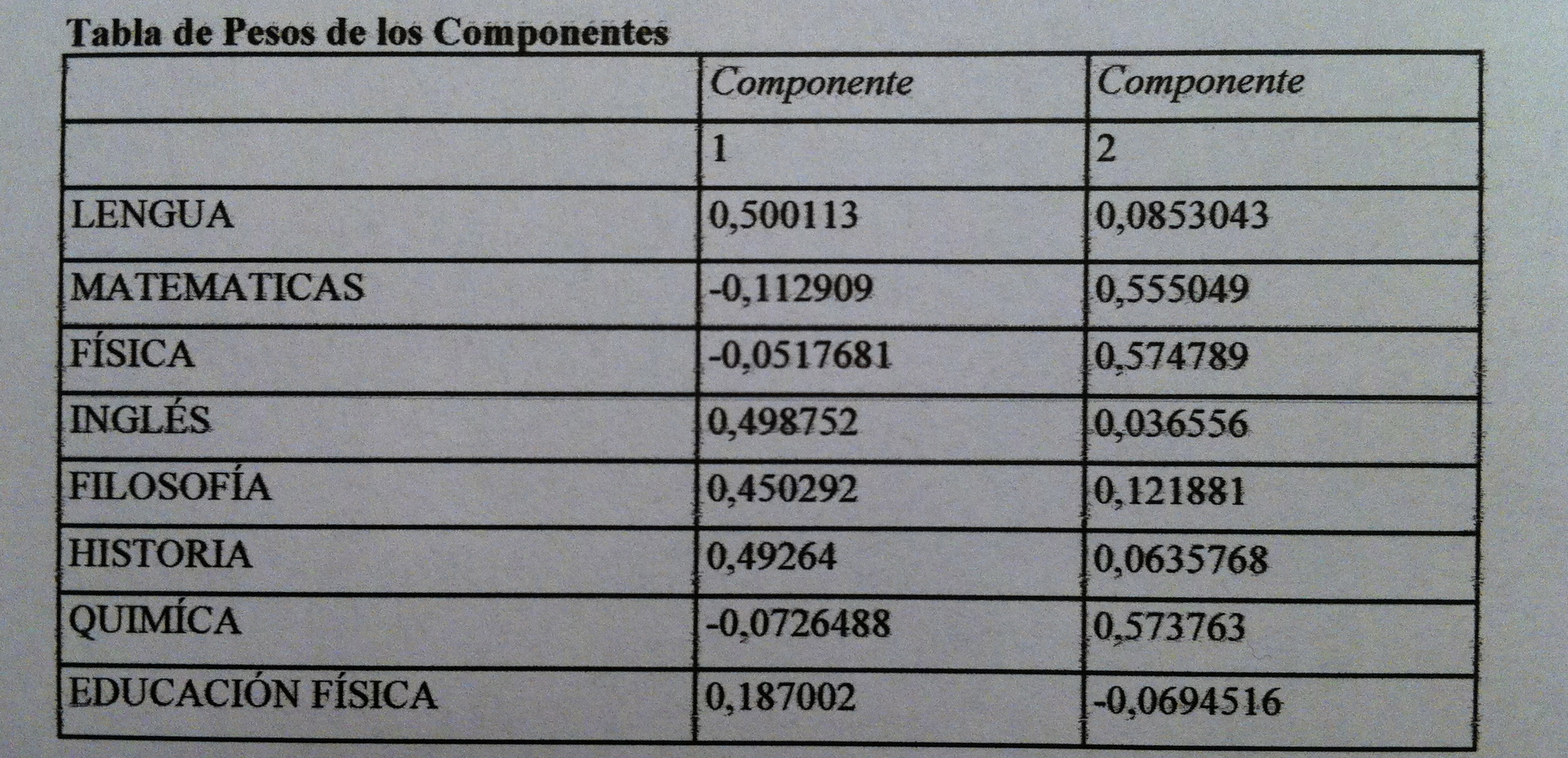

26. Y a continuación vamos a ver cuáles son las fórmulas de los dos factores con la rotación varimax:

27. Como puede verse el primer factor recoge como coeficientes grandes las materias de letras: Lengua, Inglés Filosofía e Historia. El segundo factor recogen como coeficientes grandes las materias de ciencias: Matemáticas, Física y Química. Como sucedía en el ACP.

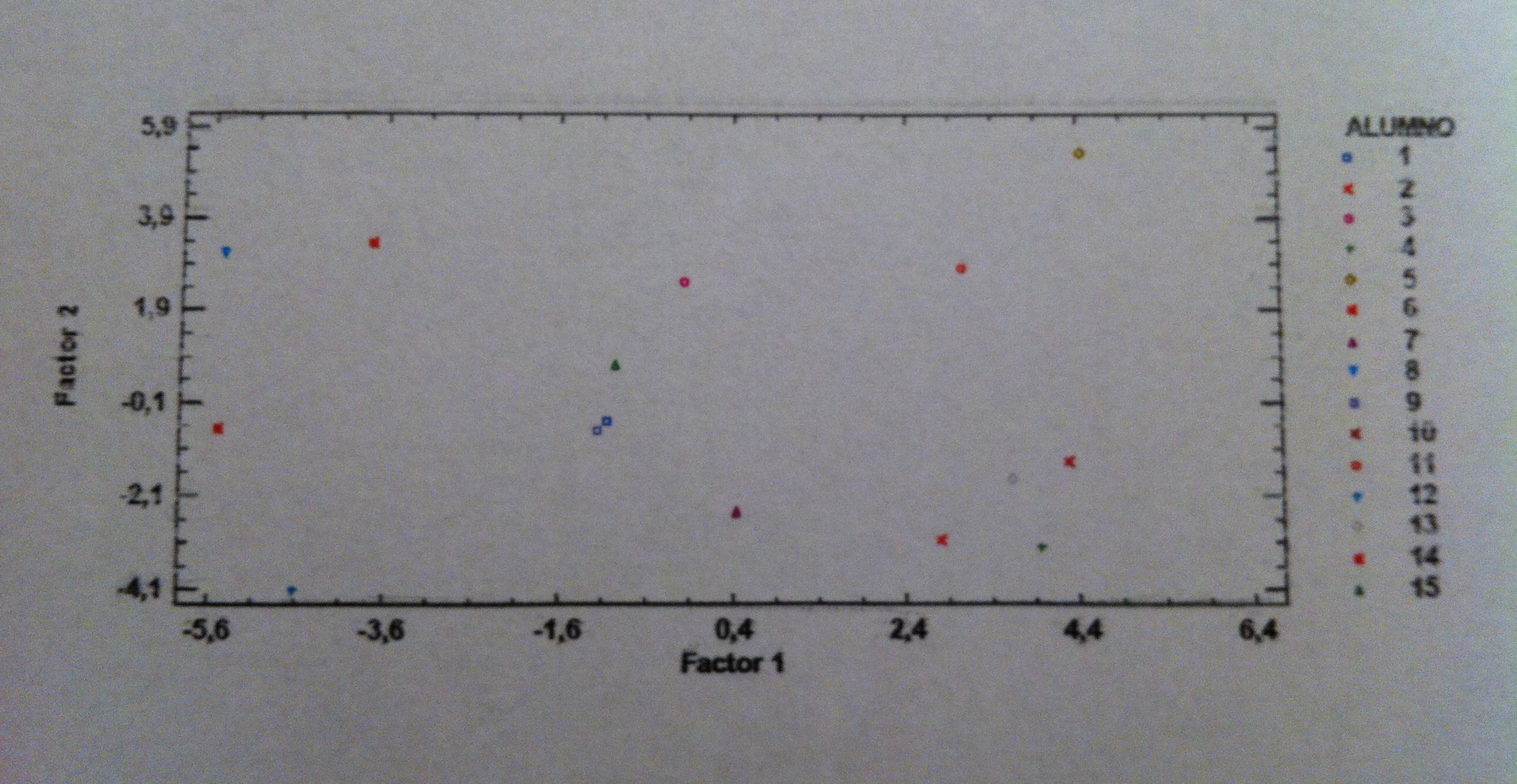

28. El gráfico de los 15 alumnos representados respecto a los dos factores elegidos es:

29. Realmente si lo comparamos con el obtenido mediante el Análisis de componentes principales es muy similar. Recordemos aquél gráfico:

30. Comparando ambas técnicas, el AF y el ACP, aplicadas a los mismos datos podemos comprobar que los resultados obtenidos son similares. Los dos factores y las dos componentes principales se interpretan de la misma forma. Las representaciones son prácticamente idénticas. Son dos formas distintas de llegar al mismo sitio, por lo tanto. En este ejemplo, las cosas son muy claras y de ahí la similaridad. La varianza explicada en ambos caso es muy alta lo que favorece la igualdad en los resultados. Si no fuera tan alta esta varianza total explicada podríamos encontrarnos con mayores diferencias.

31. El ejemplo que hemos utilizado es sencillo. Con datos complejos, donde el repertorio de variables es amplio y diverso suele ser muy difícil interpretar el ACP. Especialmente en estos casos el AF puede aportar una luz que no seamos capaces de ver mediante el ACP.

32. Por otra parte, mucha diferencia en las representaciones obtenidas por un método u otro no deben existir, porque, en realidad, estamos intentando, como ya hemos dicho, con ambas técnicas, representar una nube de puntos original, que no visualizamos, mediante una nube de puntos en menos dimensiones. Si un método de este tipo cumple su misión debe llegar a una solución similar a la obtenida por otro método diferente que persigue lo mismo. Únicamente en los casos en los que estemos haciendo representaciones muy poco fieles a la original podemos encontrar profundas diferencias entre estos distintos métodos.

Tema 17: ANÁLISIS DE COMPONENTES PRINCIPALES

Toda la explicación que a continuación tenéis del Análisis de componentes principales la podéis seguir, también, paralalamente, con la explicación de los siguientes vídeos:

1. El Análisis de componentes principales (ACP) es una técnica estadística descriptiva que tiene como punto de partida una matriz de datos con una serie de individuos a los que se les ha medido varias variables. Por eso suele clasificarse como una técnica multivariante. Para guiarnos en esta técnica vamos a manejar unos datos como los que a continuación muestro:

2. Se trata de unos datos que todos comprendemos perfectamente porque todos hemos sido estudiantes. Se trata de las notas de diferentes materias que obtienen 15 alumnos de bachillerato. Tenemos, pues, 15 individuos en el estudio; o sea, una muestra de tamaño 15 pero con ocho variables, tantas como asignaturas tenemos.

3. Si quisiéramos representar los 15 alumnos de esta muestra en un gráfico lo podríamos hacer tomando dos notas y representando los 15 puntos según sus valores en el eje de abscisas y de ordenadas. Podríamos también, eso sí, hacer una representación de tres de esas ocho variables en un gráfico tridimensional. Pero aquí se acaba. Ya no podríamos visualizar una representación en más dimensiones. Por lo tanto, es imposible ver en un gráfico una representación de los 15 individuos respecto a todas las variables al mismo tiempo.

4. El ACP tiene como objetivo básico inicial suplir este déficit. Pretende, cuando vale la pena hacerlo (ya veremos cuándo vale la pena y cuándo no), realizar una representación de una nube de puntos multidimensional (de más de tres dimensiones), en dos o tres dimensiones. En definitiva, se trata de visualizar lo que no vemos. En nuestro ejemplo de los estudiantes de bachillerato el ACP trataría de hacer una representación de los 15 alumnos en dos o tres dimensiones pero contemplando todas las variables, sin prescindir de ninguna de ellas en el análisis.

5. Hay que hacer notar que, aunque el objetivo inicial es éste: la representación en dos o tres dimensiones de unos puntos que originariamente están en muchas dimensiones; o sea, visualizar lo que no vemos, la propia técnica, como consecuencia de su propio procedimiento, consigue crear unos objetos matemáticos (las componentes) muy interesantes que, en realidad, también podrían considerarse objetivos de la técnica porque, en muchas ocasiones, nos permiten establecer relaciones entre las variables, ver cómo se asocian, cómo se distancian, etc. De esto, no obstante, hablaré más tarde.

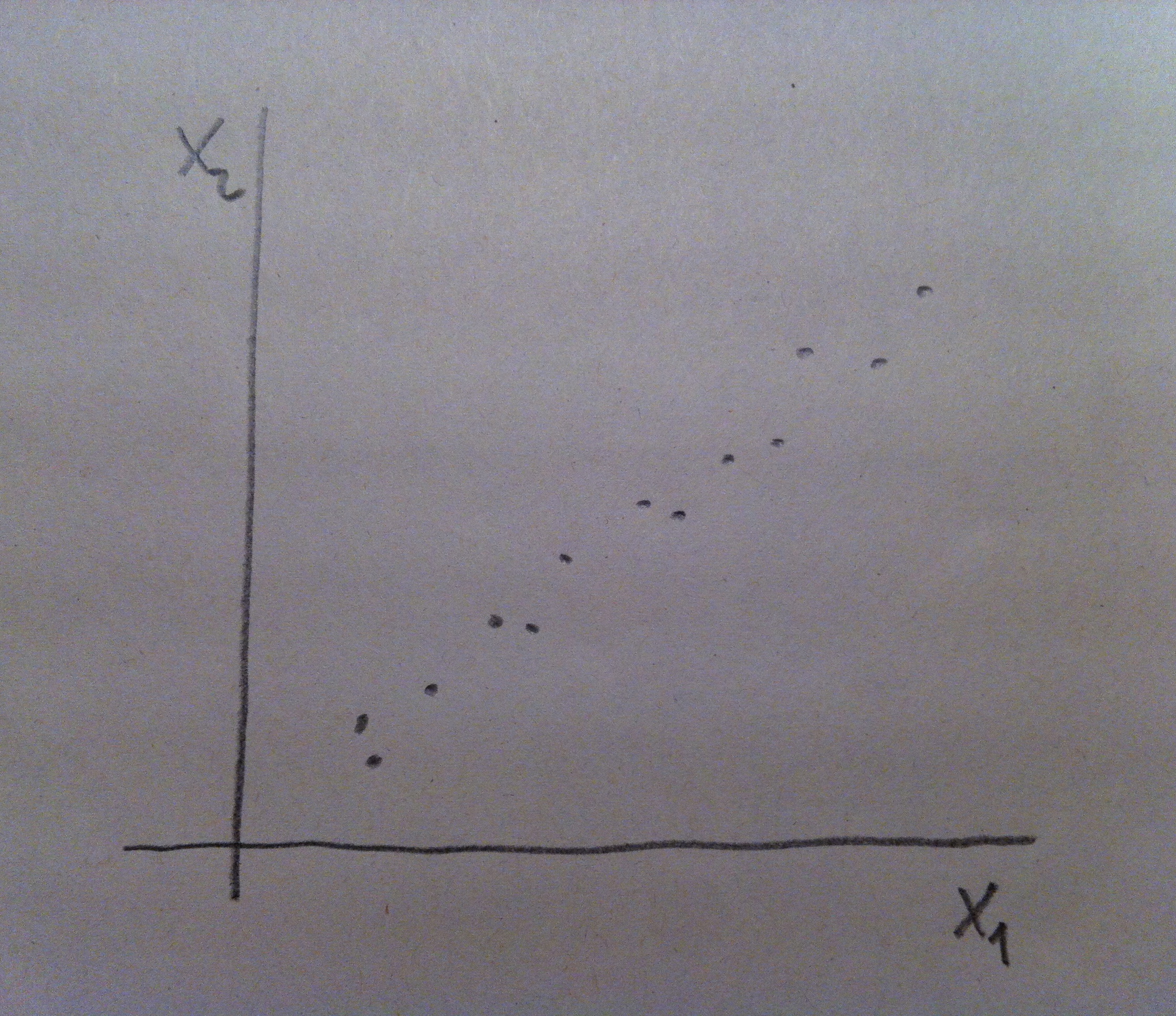

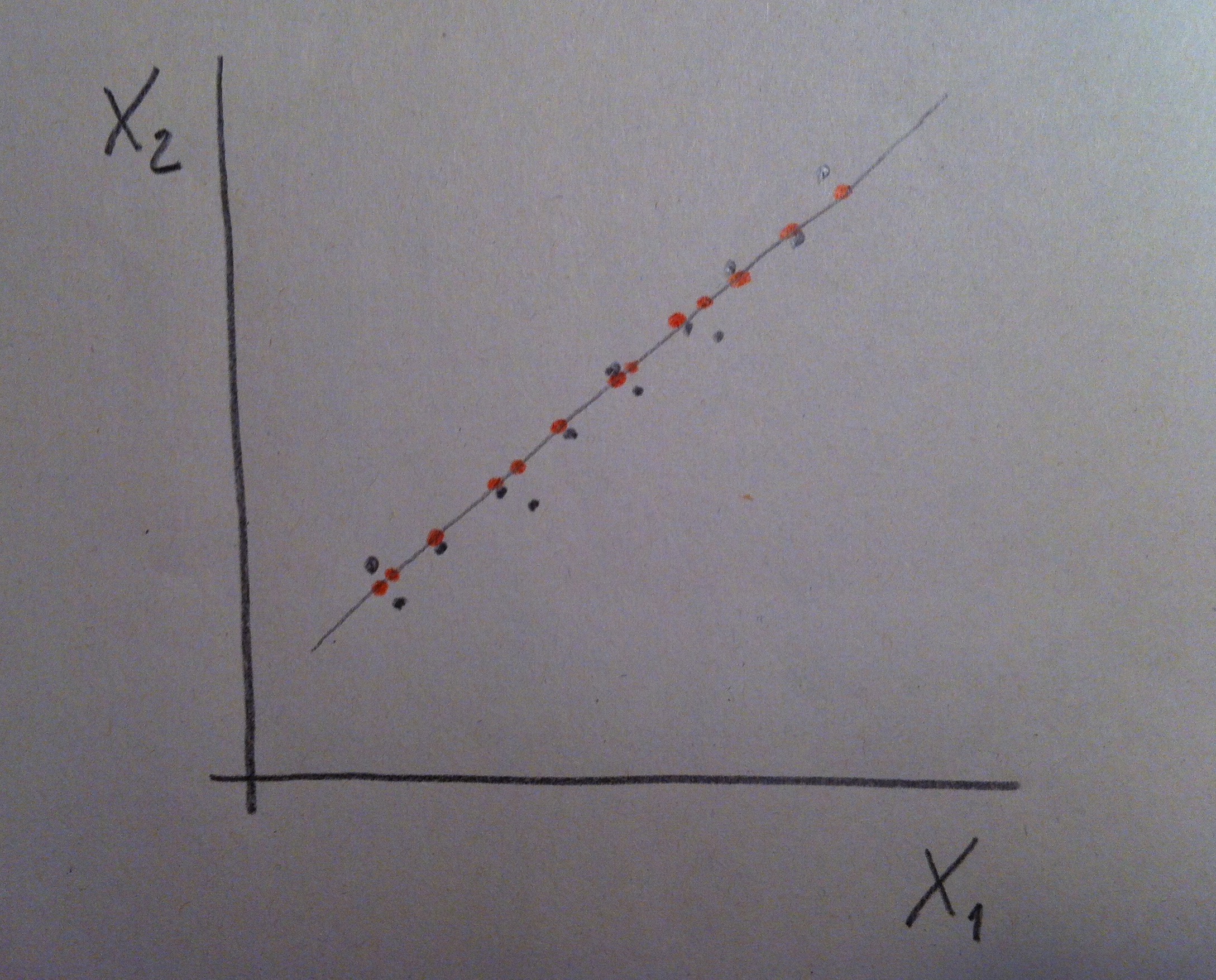

6. Vamos a ver el problema que estoy planteando pero miniaturizado. Así se entenderá mejor la esencia de la técnica. Supongamos que tenemos la siguiente representación bidimensional con dos variables X1 y X2:

7. Y supongamos que unos seres unidimensionales, que únicamente ven las cosas si están en una dimensión, quieren representar, en una única dimensión, esta nube de puntos que ellos, evidentemente, no pueden ver. Observemos que si lo que quieren es no prescindir de ninguna de las dos variables lo que pueden hacer es representar las proyecciones de los puntos sobre un eje como el dibujado en la siguiente figura:

8. Observemos que la nube de puntos roja, que está integrada por las proyecciones de los puntos originales sobre el nuevo eje, se parece bastante a la nube de puntos original. Las posiciones relativas de los puntos se respetan bastante. Y ahora los seres que sólo ven en una dimensión lo ven. Están viendo una representación unidimensional de una realidad bidimensional y lo hacen con bastante fidelidad. La nube de puntos roja se parece bastante a la negra. Ellos sólo ven la roja pero realmente es una buena aproximación de la original, que es la negra.

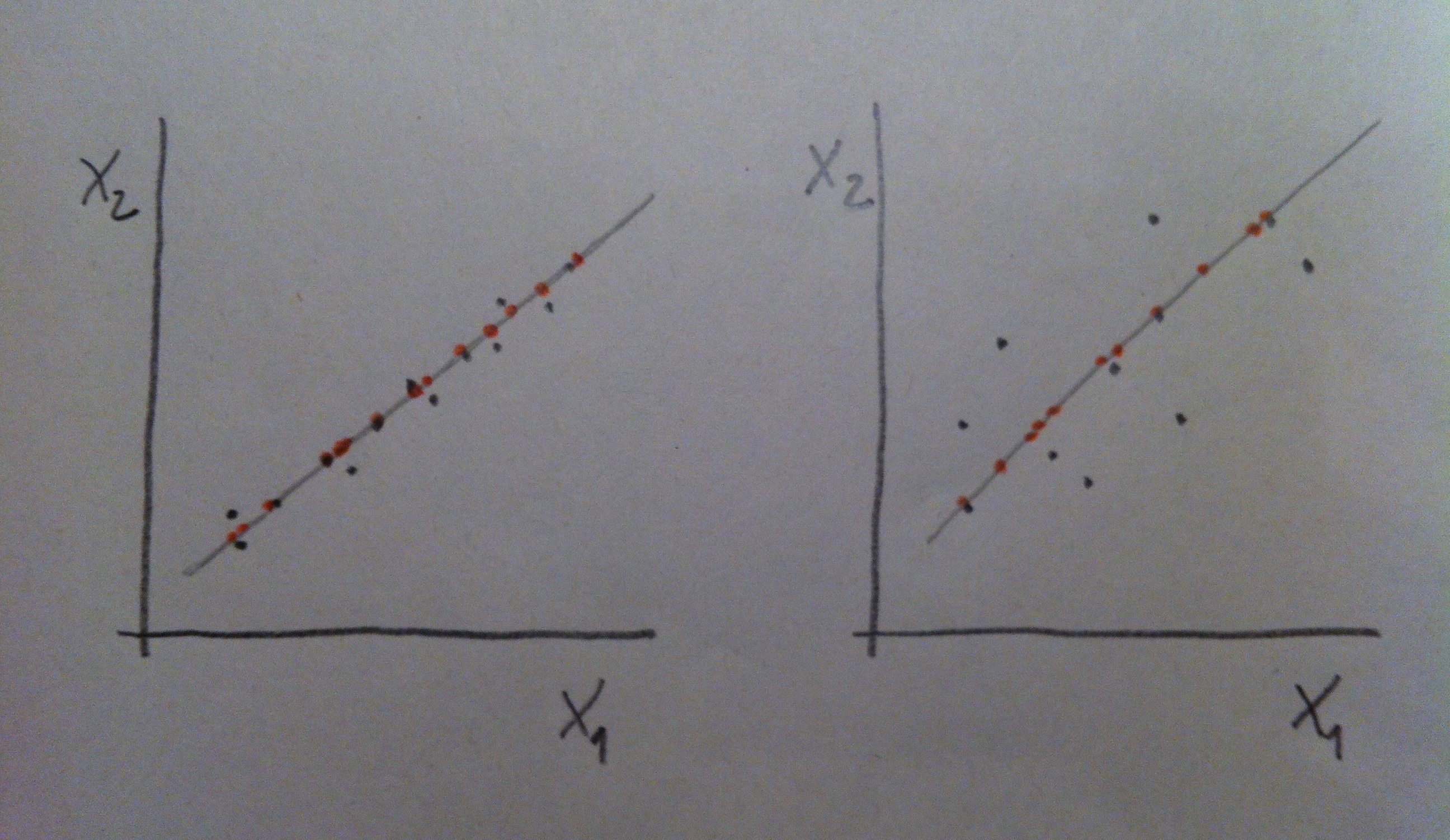

9. La representación en menos dimensiones no siempre tiene la misma calidad. En el gráfico siguiente vemos que a la izquierda la nube de puntos proyectada sobre el nuevo eje (la nube de puntos roja) se parece más a la original de lo que se parecen la roja y la negra en la situación mostrada en el gráfico de la derecha. Por lo tanto, en los datos de la derecha tiene menos valor realizar un ACP:

10. Y observemos que cuando he dibujado el eje para proyectar los valores sobre él lo he hecho situándolo de una forma, pero lo hubiera podido situar de otra. Observemos en el gráfico siguiente que el eje dispuesto en el ejemplo de la derecha no consigue, mediante la proyección de los puntos sobre ella, una nube de puntos representativa de la nube de puntos original:

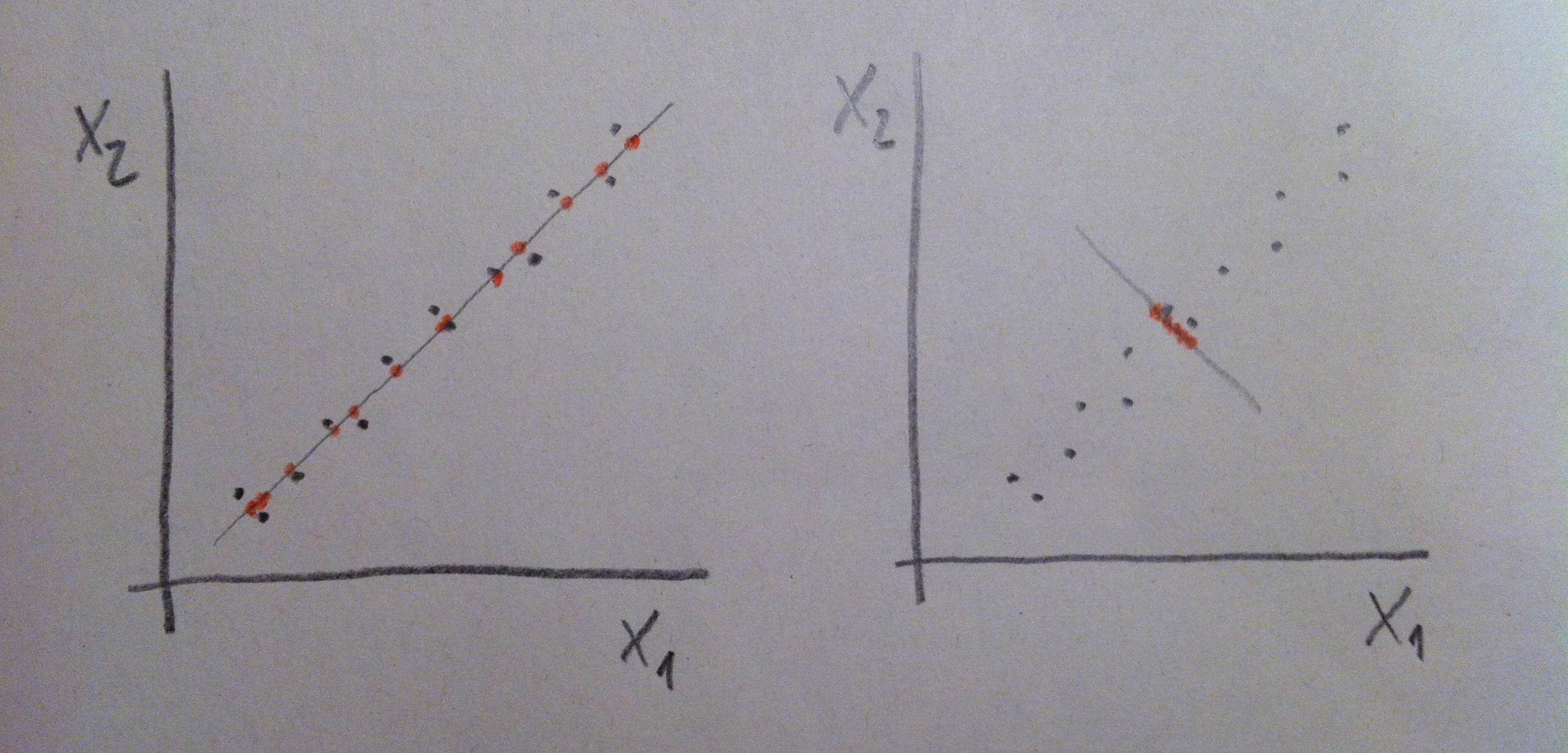

11. Lo que hemos hecho es, en definitiva, un giro de los ejes de coordenadas sin tocar los puntos. Observemos lo que hemos hecho:

12. Lo importante es que ahora vemos la nube de puntos desde unos ejes donde uno es mucho más importante que el otro. Ahora los ejes son Y1 y Y2. Si X1 y X2 eran dos variables que tenían la misma cantidad de información, ahora Y1 y Y2 no tienen la misma cantidad de información. Y1 tiene mucha más información que Y2. En Estadística información es equivalente a dispersión, a varianza. Una variable que no varía no tiene información. Una variable que varía mucho tener el valor de un individuo es muy informativo.

13. El objetivo de la técnica ACP es, pues, éste: conseguir girar los ejes de tal forma que exista la mayor desigualdad posible entre la varianza de la nube de puntos original en las proyecciones en cada uno de los respectivos nuevos ejes y que, además, estos ejes, estas nuevas variables, sean independientes entre sí; o sea, que tengan correlación cero.

14. La búsqueda de estos nuevos ejes se hace mediante el cálculo de los llamados valores propios y vectores propios de la matriz de correlaciones entre todas las variables del estudio. Puede hacerse también a partir de otra matriz, la de varianzas-covarianzas, pero ésta tiene el problema de que cuando las variables tienen unidades de escala muy diferentes introduce un exceso de influencia por parte de las variables con mayor varianza. Por esto suele trabajarse con la matriz de correlaciones. De esta forma se unifica el peso de las variables iniciales del estudio. Suele hablarse de variables estandarizadas cuando se trabaja con la matriz de correlaciones. Una variable es estandarizada cuando la muestra se transforma a media cero y Desviación estándar uno. Esto se hace restando a cada valor muestral la media muestral y dividiendo por la Desviación estándar. De esta forma todas las variables del estudio tienen la misma media y la misma Desviación estándar y ninguna pesa más que otra. De esta forma la vocalización del estudio se pone en cómo es la forma de la nube de puntos, de cuáles son las relaciones entre las variables que permiten reducir dimensiones perdiendo el mínimo de información.

15. Algo muy importante: ¿Cuál es la relación existente entre las variables originales y las nuevas variables, los nuevos ejes; o sea, cuál es la relación, en el caso que hemos dibujado entre las variables X1 y X2 y las variables Y1 y Y2?

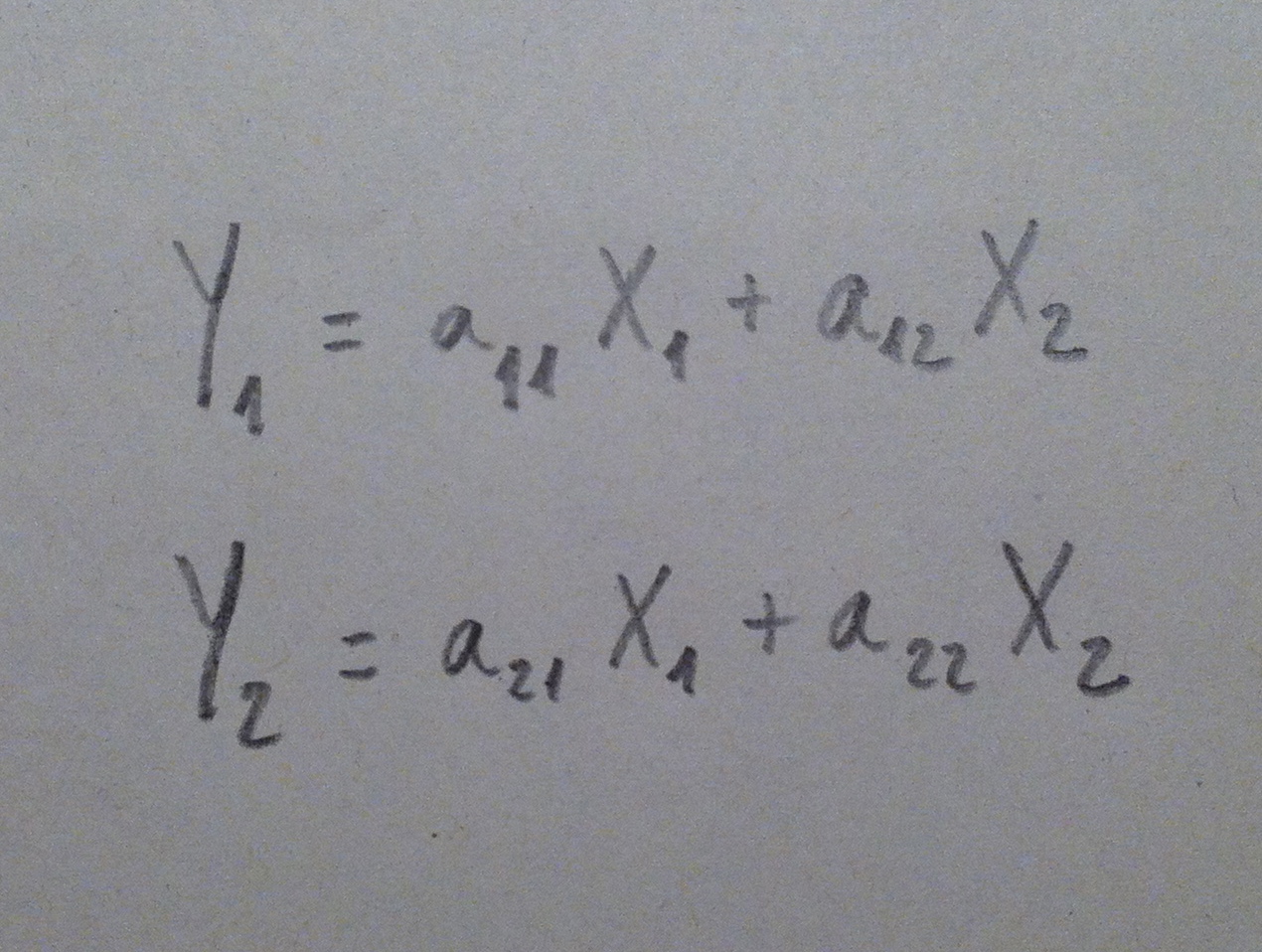

16. En primer lugar decir que a las variables Y1 y Y2, que son, eso, variables, también, como las originales, las llamamos en esta técnica “Componentes”. Y son cada una de ellas una combinación de las variables originales. Observemos la fórmula de esa combinación:

17. En realidad estos coeficientes que multiplican a las variables originales son los vectores propios de la matriz de correlaciones, es la fórmula de la transformación lineal realizada. Hemos cambiado de ejes y para llegar de los ejes originales a los nuevos ejes hace falta esta transformación. En definitiva, si tenemos un punto representado por las coordenadas originales, éstas son las fórmulas necesarias para conseguir las coordenadas de la nueva representación: la representación mediante los ejes constituidos por las componentes.

18. Si en el lugar de estar trabajando con dos variables originales estuviéramos trabajando con d variables originales la fórmula de las d componentes sería:

19. Se llama a la técnica Análisis de componentes principales porque transforma a las variables originales en nuevas variables, las componentes, las cuales tiene desigualdad en cuanto a la información explicada, lo que significa que tenemos unas componentes muy informativas y otras que no. Por eso tenemos unas componentes principales, que son las que usaremos para hacer la representación. Esta desigualdad generada al crear las componentes nos permite elegir, entre ellas, las principales y eliminar las poco importantes, cosa que no sucedía con las originales porque ellas eran todas principales, todas eran importantes, no podíamos prescindir de ninguna de ellas.

20. A los datos de los 15 estudiantes que se les ha evaluado en las ocho materias citadas en la matriz de datos mostrada al principio de este tema si se les hace un ACP tenemos la siguiente representación usando las dos primeras componentes principales: PCOMP_1 y PCOMP_2:

21. Observemos ahora que esta representación se asemeja mucho a la original en ocho dimensiones. Si observamos en el gráfico de dos dimensiones el alumno 1 y el 9 están muy próximos, prácticamente solapados. Miremos qué sucede en la matriz de datos. Observaremos que las notas, excepto Educación física, son prácticamente las mismas. Lo de Educación física tiene una explicación que ahora veremos.

22. Si, por el contrario, elegimos los individuos 5 y 12 vemos que en nuestro gráfico de dos dimensiones están completamente en los extremos, están en dos vértices de la representación. Si ahora miramos la matriz de datos veremos que el alumno 5 lo aprueba todo con buenas notas excepto la Educación física. En cambio el alumno 12 lo suspende todo, incluso la Educación física. Sorprendentemente en este caso son en todo distintos excepto en la Educación física que tienen justo la misma nota.

23. Por lo tanto, con el gráfico de dos dimensiones estamos viendo una muy buena fotografía de las posiciones relativas de los puntos en la representación de ocho dimensiones original que no vemos. Digo fotografía porque la metáfora es apropiada. Pensemos que cuando estamos viendo una fotografía en realidad estamos viendo una representación bidimensional de una realidad tridimensional. En el ACP estamos haciendo algo similar. Miramos de hacer una fotografía bidimensional o tridimensional, para que la podamos visualizar, de una realidad constituida por muchas dimensiones y que no visualizamos. Por lo tanto, en nuestro caso estamos viendo una fotografía bidimensional de una realidad ochodimensional.

24. Pero, algo muy importante: ¿Qué cantidad de información perdemos? Y, ¿qué representan los nuevos ejes?

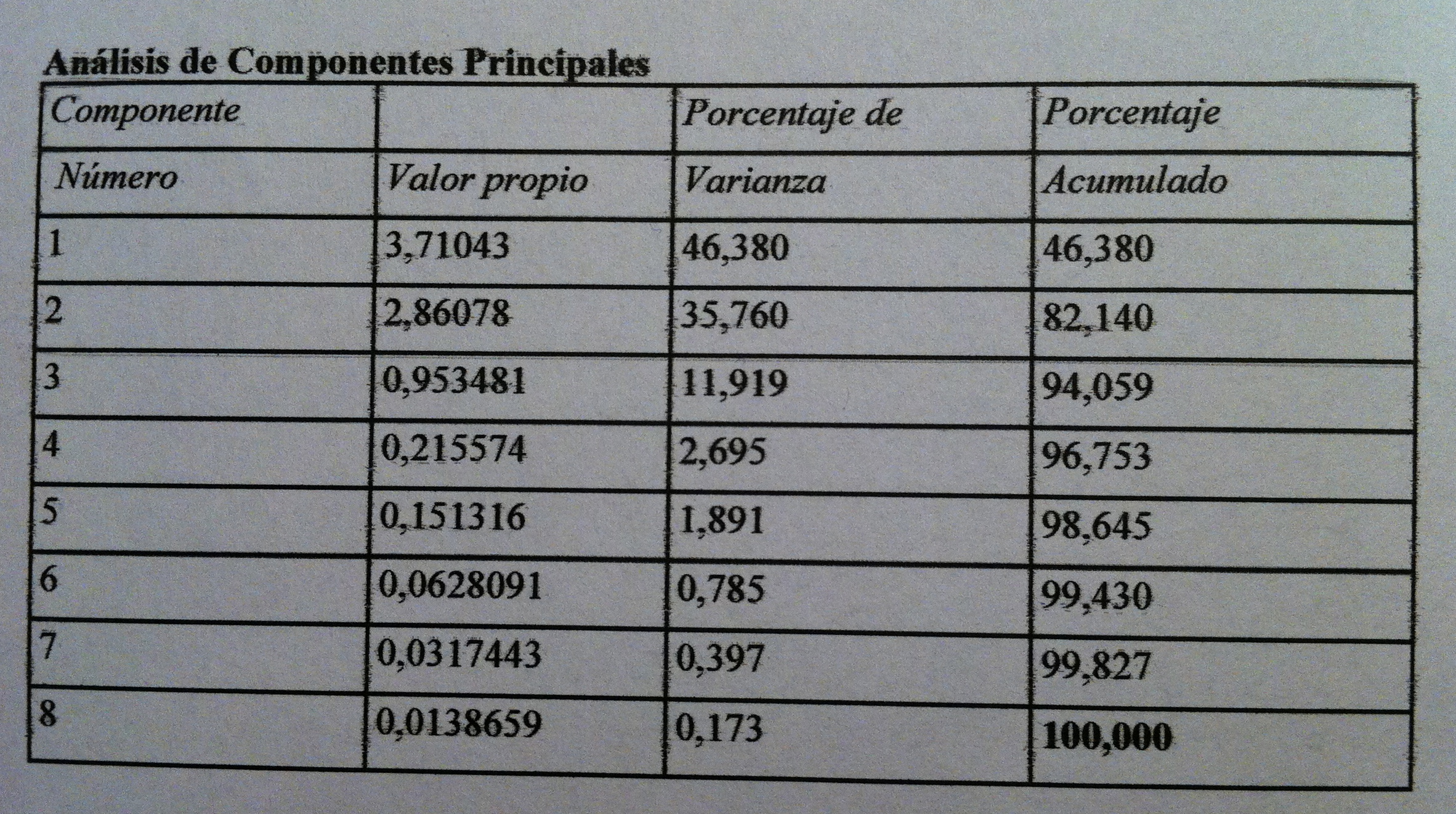

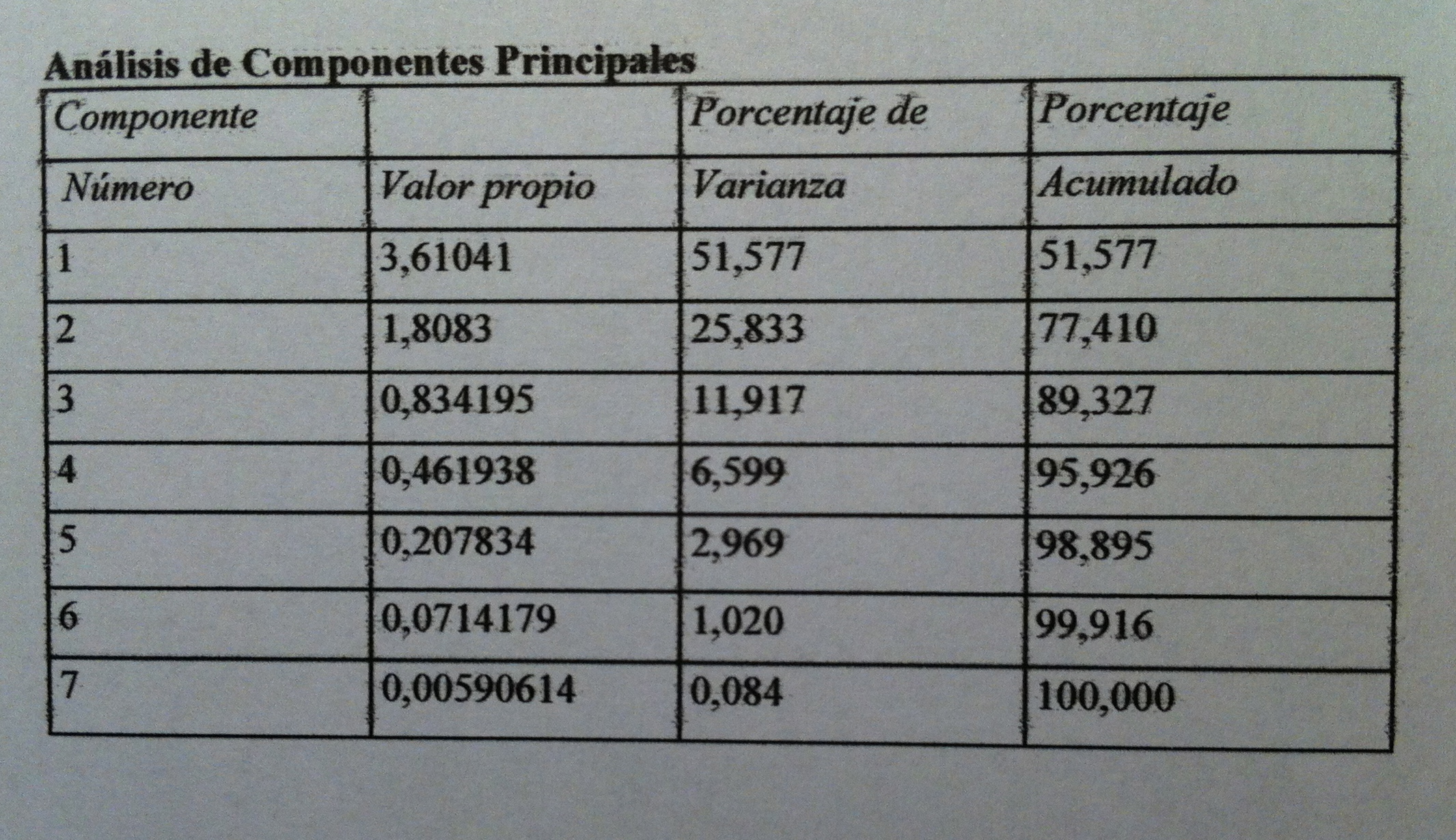

25. Respecto a la cantidad de información observemos la siguiente tabla:

26. Los valores propios de cada componentes nos indican la cantidad de varianza, la cantidad de información que tiene cada componente. Como podemos ver en esta tabla la primera componente tiene un 46.38% de información y la segunda un 35.76%. Las dos juntas tienen un 82.14. Por lo tanto, haciendo una representación en dos dimensiones con esas dos primeras componentes perdemos un 17.86% de información únicamente.

27. Respecto a lo que representan los nuevos ejes observemos la fórmula de las dos primeras componentes principales:

28. Esto indica que la primera componente principal tiene los coeficientes de la primera columna y la segunda componente tiene los coeficientes de la segunda. O sea, que para conocer las coordenadas que tendrá cada alumno de esas dos componentes hay que multiplicar sus ocho notas por sus coeficientes respectivos. Y así es como obtenemos la representación gráfica bidimensional mostrada antes.

29. Para interpretar una componente hay que seguir el siguiente procedimiento: 1) Mirar el valor absoluto de los coeficientes distinguiendo los que tienen un valor grande y un valor pequeño. En nuestro caso en la primera componente observemos que Lengua, Inglés, Filosofía e Historia tienen coeficientes con valor absoluto grande, cercano en todos los casos a 0.5. Los demás ya son bastante más pequeños, pesan mucho menos en esta componente. En la segunda componente el peso principal se lo llevan Matemáticas, Física y Química, con coeficientes cercanos a 0.57. Las demás asignaturas pesan poco. 2) Mirar entre los coeficientes con valor absoluto grande el juego de signos que hay. En nuestro caso el signo es el mismo, por lo tanto, las variables que pesan en una componente y en la otra todas van en la misma dirección. Pero en otro caso nos podríamos encontrar con valores de signo contrario. Entonces hay que interpretar el juego de fuerzas de los signos.

30. En el ejemplo que venimos usando la interpretación es muy clara. En la primera componente tenemos reunidas las materias de letras. En la segunda componente tenemos reunidas, por el contrario, las materias de ciencias. La educación física no pesa ni en una ni en otra. Porque no tiene ninguna relación ni con las materias de letras ni con las de ciencias.

31. Viendo el gráfico bidimensional donde en el eje de las abscisas tenemos la primera componente y en el eje de las ordenadas tenemos la segunda componente podemos ver que los alumnos buenos en ciencias y letras estarán situados a la derecha y arriba, los alumnos buenos en letras y malos en ciencias se situarán a la derecha y abajo, los buenos en ciencias y malos en letras a la izquierda y arriba y, finalmente, los malos en ciencias y letras se situarán a la izquierda y abajo.

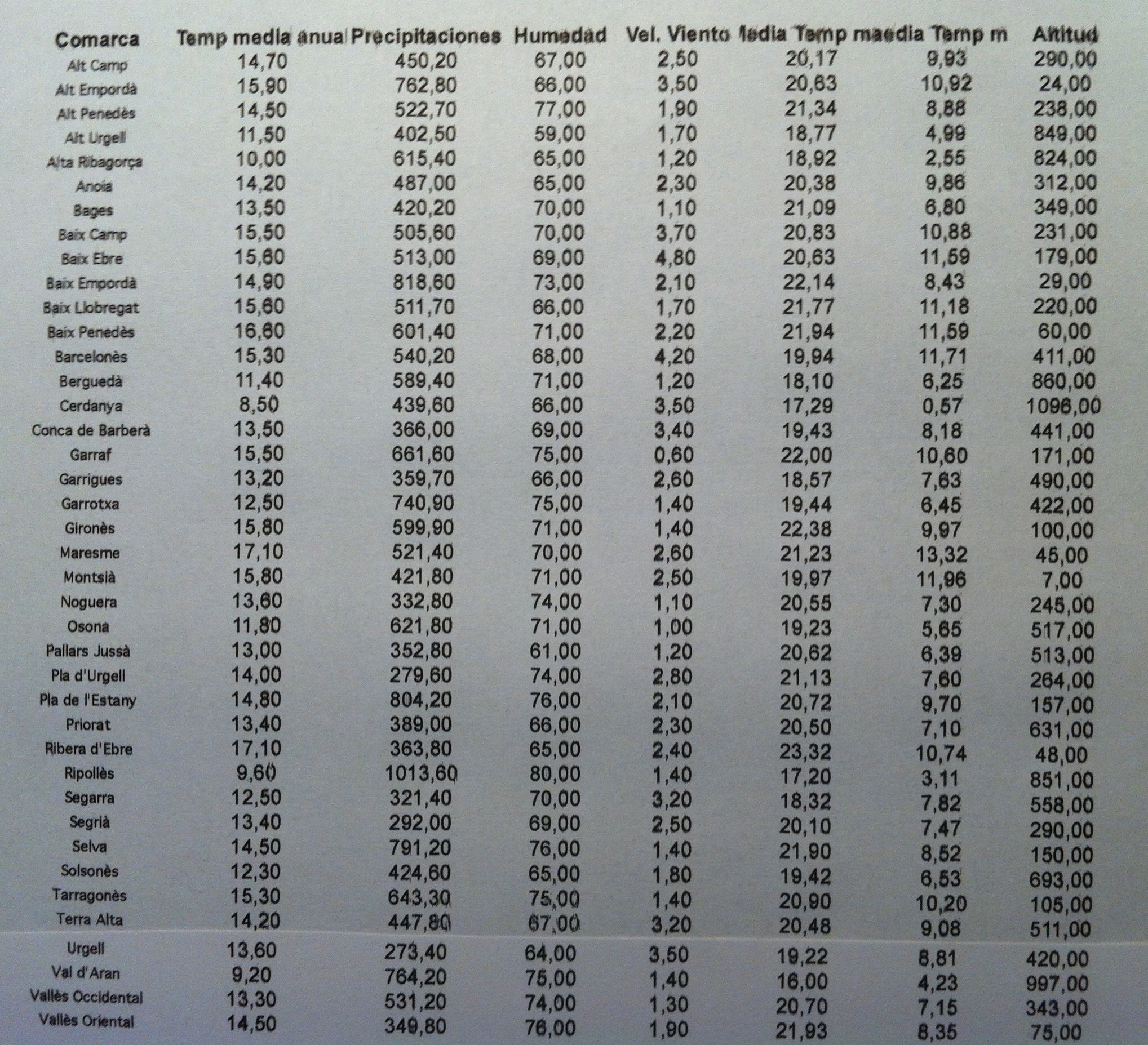

32. Veamos otro ejemplo de ACP. La matriz de datos son variables meteorológicas según comarcas catalanas el año 2005. Los datos son los siguientes:

33. Al hacer un ACP, los valores propios de las componentes principales son los siguientes:

34. Como puede verse con las dos primeras componentes explicamos el 77.41% de la varianza, de la información contenida en la nube de puntos original.

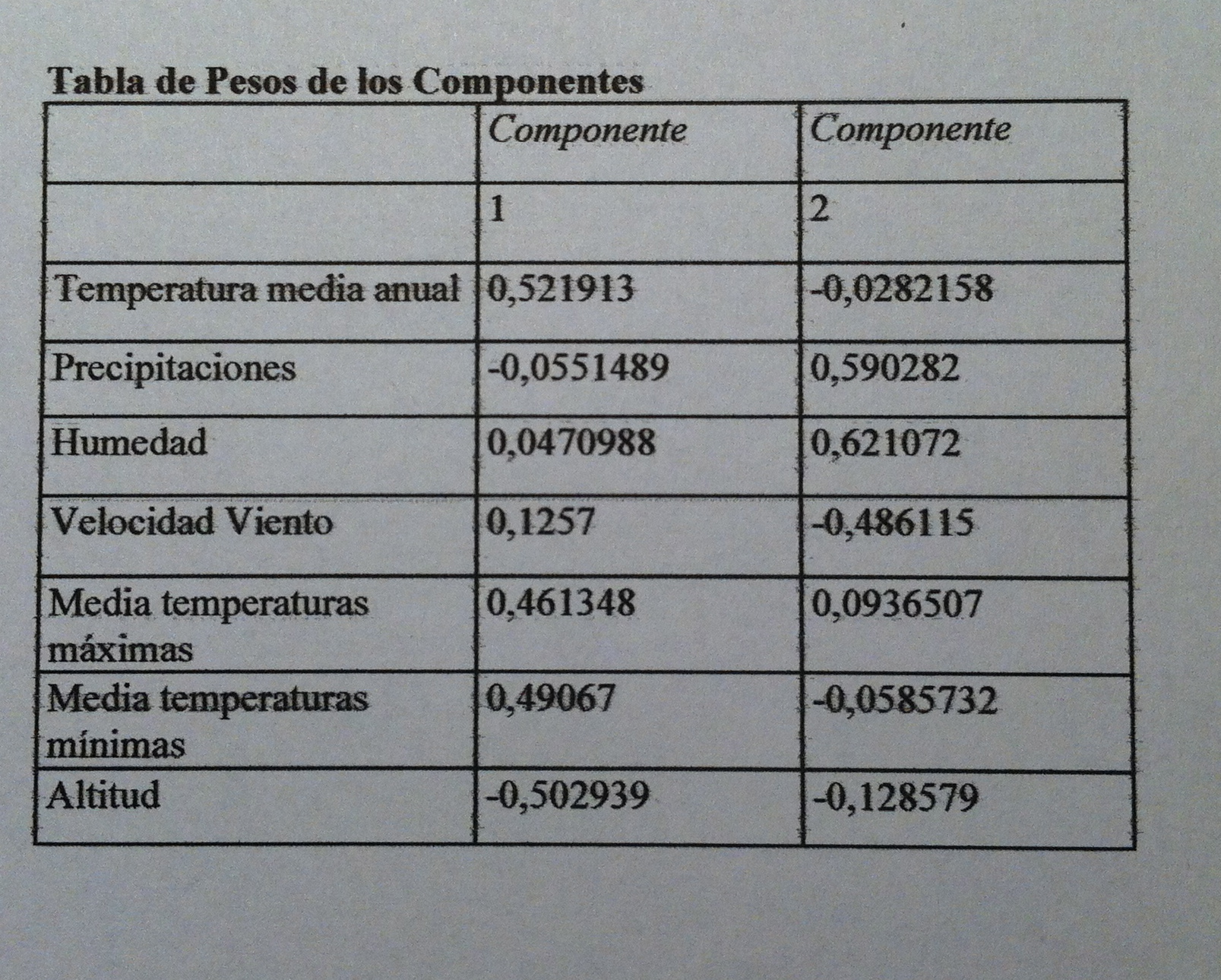

35. Y los vectores propios; o sea, los coeficientes de las dos primeras componentes, son los siguientes valores:

36. En la primera componente pesan; o sea, tiene valor absoluto grande, las tres variables de temperatura y la altitud media de la comarca. Además lo hacen las temperaturas con signo positivo y la altitud con signo negativo. Lo que indica que valores grandes de la primera componente corresponden a comarcas con temperaturas altas y altitud baja. Altitud baja porque como el coeficiente es negativo para que la componente tenga un valor alto hace falta que la altitud reste poco, sea un valor pequeño. Contrariamente, valores pequeños de esta primera componente indica temperaturas bajas y altitud alta.

37. En la segunda componente pesan especialmente las variables Precipitaciones, Humedad y Velocidad del viento. Las dos primeras con signo positivo y la tercera con signo negativo. Valores grandes de esta componente indicarán zonas con mucha lluvia, mucha humedad y poco viento. Por el contrario, valores bajos de esta segunda componente corresponderán a comarcas de bajas precipitaciones, baja humedad y alta velocidad del viento.

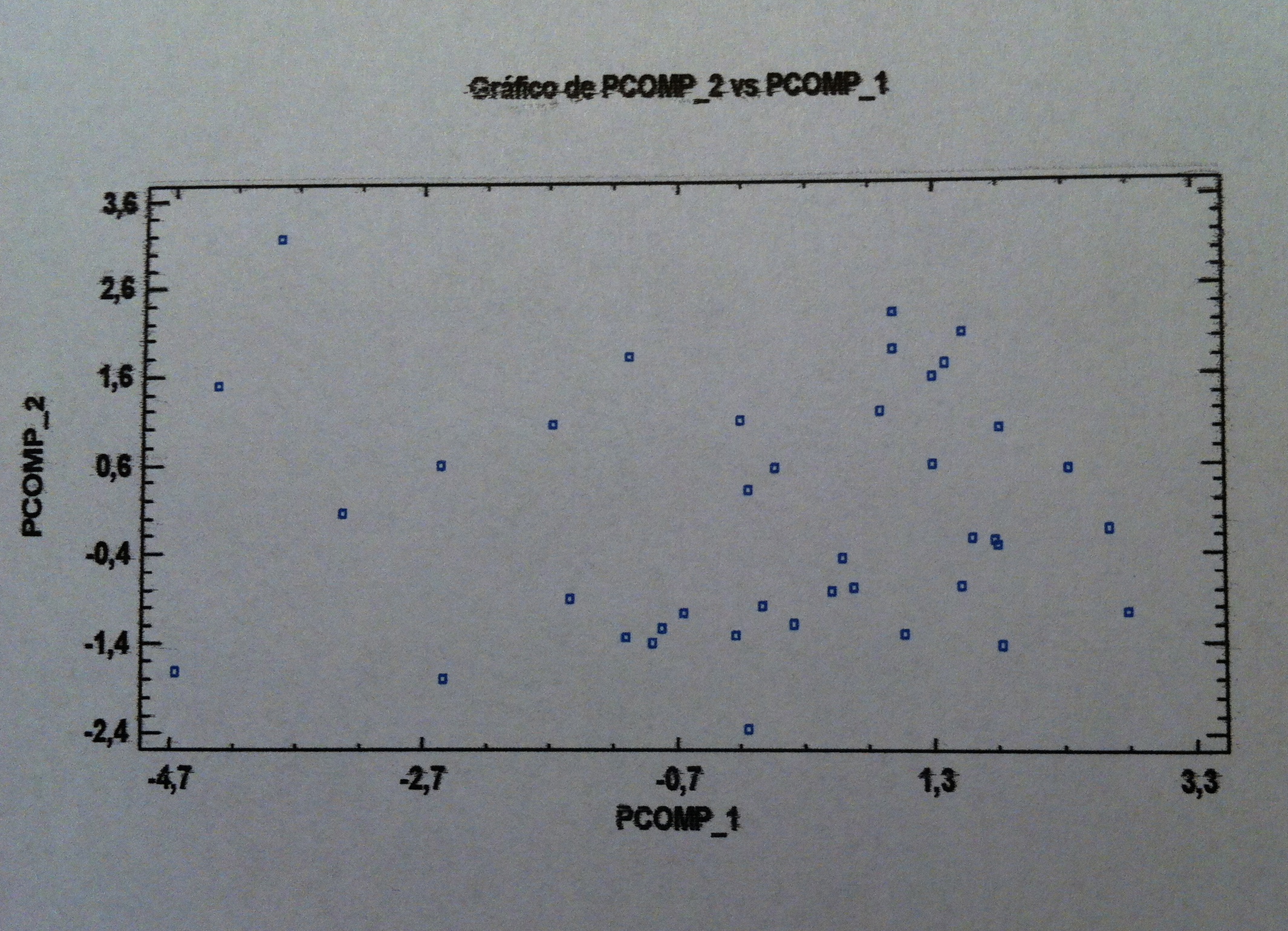

38. La representación de las comarcas según las dos primeras componentes es la siguiente:

39. Viendo el gráfico y la anterior interpretación de las componentes podemos dividir el gráfico en cuatro cuadrantes y afirmar: 1) Arriba a la derecha: Comarcas calurosas y húmedas. 2) Abajo a la derecha: Comarcas calurosas y secas. 3) Arriba a la izquierda: Comarcas frías y húmedas. 4) Abajo a la izquierda: Comarcas frías y secas.

40. Observemos, pues, que conseguimos con esta técnica representar en pocas dimensiones una realidad multidimensional y, también, crear estas componentes, estas variables de variables, variables que son combinación de las variables originales. Y estas combinaciones son interesantes en sí mismas, porque nos ayudan a crear una especie de conglomerados de variables combinadas de una forma que, en realidad, reflejan la vida interna que tienen ellas entre sí en cuanto a la covariación conjunta.

41. En el primer ejemplo, el caso de las notas, las componentes nos han creado la noción de Letras y la noción de Ciencias, reflejando una idea que todos tenemos en mente: que las capacidades hacia un ámbito u otro son como dos dimensiones independientes que se pueden tener ambas, que se puede tener una y no otra o que se puede, también, no tener ninguna.

42. En el segundo ejemplo, las componentes nos separan dos elementos independientes: aspectos de frío o calor, ligados a la altitud de la zona, por un lado, y aspectos referentes a la humedad climática, por otro. Aspectos que pueden ir asociados entre sí de forma independiente creando cuatro tipos de comarcas o de zonas distintas según la combinación de los valores extremos de estas dos componentes.

43. Otro ejemplo de Análisis de componentes aplicado a datos de jugadores de baloncesto se puede consultar en el fichero Análisis de componentes principales aplicado a datos de jugadores de baloncesto.

44. Otro ejemplo interesante es el planteado en la Situación 66, donde aparecen unos datos de diferentes países y las proporciones que tienen que hay en ellos en cuanto a las distintas formaciones universitarias. El análisis de los datos los podéis ver en la Solución Situación 66.

45. Otro ejemplo, ahora con Pokémons, está planteado en la Situación 47. La solución se puede ver en el fichero Solución Situación 47.

46. Un ejemplo de fútbol lo tenemos en la Situación 46. La solución puede verse en el fichero Solución Situación 46.

47. Como puede verse, en este tema hemos hablado de una técnica esencialmente descriptiva. No hemos hablado, aquí, de otra cosa que de muestras. No hay voluntad inferencial en esta técnica. Es cierto que se ha estudiado y creado técnicas inferenciales relacionadas con el ACP pero no es muy utilizada en la práctica. Es por ello que debemos considerarla una técnica descriptiva, una técnica que intenta buscar la representación de una muestra de individuos de los que tenemos muchas variables de interés. Una técnica donde la muestra es la finalidad.

48. Podéis practicar los conceptos de este tema con ejercicios comentados en el siguiente:

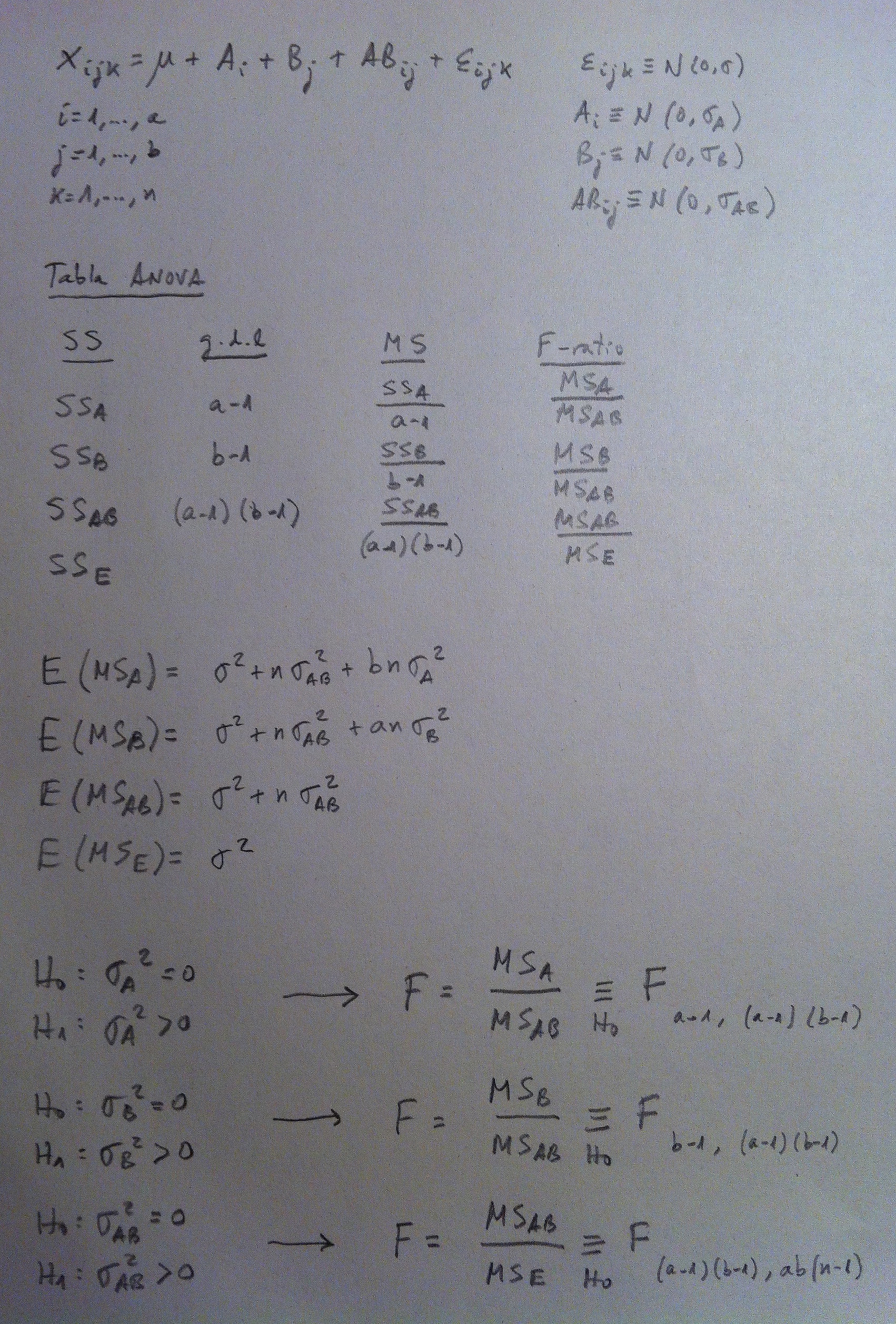

ANOVA de dos factores a efectos aleatorios

En el ANOVA de dos factores a efectos aleatorios tenemos tres contrastes a realizar, uno por cada factor y otro para la interacción. Pensemos que estamos en factores cruzados. En ANOVA si hay más de un factor si no se dice lo contrario los factores están cruzados.

La clave en estos tres contrastes de hipótesis es qué cocientes hay que hacer a la hora de dividir cuadrados medios (MS) en la F-ratio. Por eso pongo las esperanzas de los cuadrados medios. Viendo esas esperanzas y bajo la Hipótesis nula vemos por qué los cocientes son los que son. Se trata de que los cocientes, bajo la Hipótesis nula tengan la misma esperanza. De esta forma valores pequeños de la F-ratio nos permitirán mantener la Hipótesis nula y, por el contrario, valores grandes de la F-ratio nos permitirán rechazarla y pasarnos a la Hipótesis alternativa.