Vídeos que explican el tema:

1. La Estadística descriptiva es un importante campo de la Estadística. Su objetivo es, como dice su nombre, describir. Describir la muestra. No pretende ir más allá de la muestra. Se limita a la muestra, a lo que ve.

2. No es una actividad inferencial, no pretende proyectarse más allá de la muestra, no pretende decir cosas de lo que no ve.

3. En las técnicas de comparación y de relación la inferencia, el ir más allá de la muestra sí que será el objetivo básico. En las técnicas de comparación y de relación sí que se tratará de decir cosas poblacionales a través del análisis muestral.

4. La muestra es el punto de partida fundamental de la Estadística, evidentemente. Pero hay dos formas de manejar muestras. Una es ver a la muestra como medio y la otra ver a la muestra como fin.

5. La Estadística descriptiva maneja la noción de muestra como fin. La muestra es aquí la finalidad. La finalidad es calcular descriptores de la muestra, los llamados “estadísticos” (media, mediana, desviación típica, rango, etc).

6. Cada uno de estos descriptores, de estos estadísticos son, pues, cálculos que nos proporcionan perspectivas, miradas, distintas a una muestra.

7. Sin embargo, en la Estadística que compara y que relaciona, la inferencial, la muestra es un medio. Un medio para ir más allá de ella, para hacer afirmaciones sobre poblaciones, para hacer inferencias acerca de lo que no se ve a partir del análisis de lo que se ve.

8. En la Estadística inferencial se pretende, a partir del análisis de toda la información posible extraída a una muestra, tratar de dibujar elementos poblacionales que se desconocen.

9. Al empezar a plantear los conceptos básicos de Estadística descriptiva es, pues, un paso obligado situar la noción de muestra:

10. Una muestra es un subconjunto de una población. Un subconjunto que, por la forma de tomarla, se pretende que sea representativa.

11. Una muestra es representativa cuando representa a la población a estudiar, cuando es lo más próximo a la población en miniatura.

12. Como la población no la tenemos la representatividad la marca el propio procedimiento seguido para obtener la muestra, su objetividad. La representatividad en Estadística es una noción de representatividad procedimental.

13. La representatividad de una muestra sólo la podemos medir valorando si hemos procedido coherentemente. Evidentemente si pudiéramos decir que una muestra es realmente representativa, que realmente es como la población pero en pequeño, es porque sabemos cómo es la población a la que ella representa. Y si la conociéramos, a la población, no estaríamos haciendo Estadística de ella. Esta es una paradoja que hemos de tener siempre presente al hacer cualquier trabajo estadístico.

14. Es básico utilizar toda la información disponible que nos lleve a una mejor miniaturización de la muestra. Si se sabe, por ejemplo, que en la población hay subpoblaciones, con importantes diferencias entre ellas, la muestra se tomará proporcional.

15. Muestreo proporcional: Dos subpoblaciones de 6000 y 4000 personas. Si se toma una muestra de 100 individuos, se tomarán 60 y 40, respectivamente.

16. Si no se tiene ninguna información de la población a estudiar la opción es coger una muestra al azar. Este es, sin embargo, siempre el último recurso.

17. Una vez se tiene la muestra, se le pueden calcular muchos estadísticos diferentes. Vamos a ir viendo ahora diferentes estadísticos, diferentes descriptores, de una muestra.

18. Cada estadístico, cada cálculo, cada descriptor, capta, numéricamente, un aspecto concreto distinto de la muestra. Empezaremos viendo muestras con valores numéricos (variables cuantitativas) y más tarde veremos lo que podemos hacer con muestras sin valores cuantitativos (variables cualitativas o nominales).

19. La media de una muestra es el descriptor más conocido. Se calcula sumando todos sus valores y dividiendo por el tamaño de muestra.

20. La muestra: (0, 4, 6, 10) tiene una media de 5.

21. La mediana es aquel número que, una vez ordenada la muestra de menor a mayor, la separa en dos partes con el mismo número de valores.

22. En la muestra (0, 4, 6, 10) la mediana es 5. El valor real 5 separa la muestra en dos mitades del mismo tamaño.

23. La media y la mediana pueden ser muy distintas. La muestra (0, 1, 3, 16) tiene una media de 5 y una mediana de 2.

24. En la muestra (0, 1, 2, 6, 50) la mediana es 2. El valor 2 separa a la muestra en dos fragmentos del mismo tamaño.

25. Si la muestra es de tamaño impar para calcular la mediana se toma el valor central de la muestra ordenada.

26. Si la muestra es de tamaño par la mediana se calcula ordenando la muestra y calculando la media de los dos valores centrales.

27. Ejemplo: (5, 3, 42, 1, 8, 3, 8). La media es 10. Para calcular la mediana se ordena la muestra: (1, 3, 3, 5, 8, 8, 42). Como es impar se toma el valor central: 5.

28. La mediana es muy usada en medicina. Especialmente al analizar los años de vida después del diagnóstico de un determinado tipo de cáncer.

29. También la mediana es muy usada en economía, al analizar la distribución de la renta de un país.

30. La muestra: (1, 1, 1, 2, 2, 2, 3, 4, 40, 44) podría ser tanto de años de vida después de padecer un cáncer o de rentas anuales en miles de euros.

31. En la muestra anterior la media es 10 y la mediana es 2. El valor de la mediana refleja aquí mejor un valor de centralidad.

32. La media sufre los efectos de valores extremos, los cuales influyen mucho en su magnitud. La mediana es resistente a esos valores.

33. A la mediana también se le denomina Percentil 50, porque es el valor que divide la muestra en dos fragmentos con el 50% de valores.

34. A partir de esta idea puede construirse un Percentil cualquiera entre 0 y 100.

35. El valor que divide la muestra en dos fragmentos, uno del 25% y otro del 75%, se le denomina Percentil 25.

36. El valor que divide la muestra en un fragmento del 75% y otro del 25% (siempre la muestra ordenada de menor a mayor) es el Percentil 75.

37. Muestra: (1, 3, 5, 9). El Percentil 25 es 2. El 2 separa la muestra en el 25% y el 75%. El Percentil 75 es 7. La mediana, o Percentil 50, es 4.

38. Muestra: (1, 3, 4, 4, 4, 6, 8, 8, 8, 10). El Percentil 10 es 2. El 2 separa la muestra en un 10 y en un 90%. El Percentil 60 es 7. El 90 es 9.

39. Muchas veces más que calcular percentiles a un muestra interesa calcular el percentil de un valor dentro de una muestra.

40. El pediatra cuando mide a un niño les da a los padres el percentil del niño, que es la posición relativa del niño entre los de su edad.

41. Si el niño, en cuanto a la altura, tiene el percentil 67 significa que el 67% de niños de su edad son más bajos que él.

42. Muestra: (3, 5, 7, 11, 15). Alguien que tenga un valor de 8 tiene un percentil de 60. El 60% de la muestra son valores inferiores a 8.

43. La moda de una muestra es el valor que se repite como mínimo dos veces y que ningún otro valor se repite tanto.

44. Si ningún valor se repite o si los que se repiten más veces se repiten el mismo número de veces entonces la muestra no tiene moda.

45. Muestra: (1, 2, 2, 3, 4): La moda es 2. Muestra: (1, 2, 3, 6): No hay moda. Muestra: (1, 2, 2, 3, 3): No hay moda. Debe ser única la moda.

46. Es cierto que a muestras como la última del apartado anterior a veces se le llama bimodal. Pero lo más habitual es decir que no hay moda.

47. El rango de una muestra es el máximo menos el mínimo. Muestra: (1, 4, 6, 7, 8). El rango es 7.

48. Al Percentil 25 se le denomina también Primer cuartil. Al Percentil 75, Tercer cuartil.

49. Rango intercuartílico es la diferencia entre el Tercer cuartil y el Primer cuartil.

50. Muestra: (0, 1, 1, 2, 2, 3 ,3, 5). El rango es 5. El rango intercuartílico es 2, porque el Tercer cuartil vale 3 y el Primer cuartil vale 1.

51. El rango es una medida de dispersión, una medida de lo alejados que están los valores de la muestra respecto a la media.

52. El rango como medida de dispersión es pobre, se fija sólo en los valores extremos, no tiene en cuenta al conjunto de la muestra.

53. Veamos dos muestras: (0, 0, 10, 10) y (0, 5, 5, 10). Tienen el mismo rango: 10. Sin embargo, la dispersión de la primera es superior.

54. Necesitamos una medida de dispersión más fina. Uno de los cálculos más importantes de una muestra es la Desviación estándar o Desviación típica.

55. La Desviación estándar (DE) es la medida más fina y la más usada como cuantificación de la dispersión.

56. La DE es la raíz cuadrada del promedio de los cuadradros de las restas de cada valor de la muestra respecto a la media muestral.

57. Esta es la definición de Desviación estándar (DE). A continuación veremos cómo se procede a su cálculo y observaremos cómo este cálculo va reproduciendo la definición pero en orden inverso:

58. Muestra: (0, 5, 5, 10). La media es 5. Las restas de cada valor de la muestra respecto a la media son 0-5=-5, 5-5=0, 5-5=0, 10-5=5. Estas son las desviaciones, respecto a la media, de esta muestra: (-5, 0, 0, 5). Si hiciese la media de estas desviaciones daría 0.

59. Para evitar que la media dé 0 elevamos al cuadrado. En nuestro caso tendríamos: (25, 0, 0, 25). El promedio de estos cuatro valores es 12.5. Este 12.5 es la varianza muestral. La varianza no suele usarse mucho en la práctica. La raíz cuadrada de 12.5 es 3.53. Esta es la DE.

60. Si en lugar de hacer el promedio (dividir por el tamaño de muestra n) de los cuadrados de esas diferencias, dividimos por el tamaño de muestra menos uno (n-1), la DE obtenida se denomina DE corregida. En realidad es la que suele usarse porque tiene mejores propiedades que la DE sin esta corrección.

61. Si se lee, de nuevo, con atención la definición de DE se comprobará que para este cálculo hemos seguido sus pasos.

62. Pero los hemos seguido en orden inverso: primero hemos hecho las restas, luego el cuadrado, luego su promedio (o esta modificación del promedio en la DE corregida) y al final la raíz cuadrada.

63. En la definición de DE el orden es: raíz, promedio, cuadrados, restas. Pero el cálculo es: restas, cuadrados, promedio (o su variante en la DE corregida), raíz.

64. El que se use más la DE que la varianza es porque en la DE al hacerse la raíz cuadrada final volvemos a la escala de nuestros valores.

65. En cambio la varianza, que se queda en el promedio de los cuadrados, es de difícil manejo por el cambio de escala.

66. Cuando tenemos muchos de estos estadísticos, de estos cálculos, de una muestra conocemos mejor cómo se distribuyen sus valores.

67. Si de una muestra tenemos la media, la mediana, diferentes percentiles y la DE sabemos las cosas esenciales de su distribución.

68. De hecho, si sabemos la media y la DE de una muestra, en buena parte sabemos lo esencial de su distribución. Son sus dos descriptores esenciales.

69. Las opciones gráficas también son muy usuales en Estadística descriptiva. Vamos a ver algunas de ellas.

70. Hay un gráfico muy interesante y muy utilizado en Estadística: el Box-Plot. Este gráfico resume muy bien, en poco espacio, unos cuantos estadísticos, unos cuantos descriptores de una muestra.

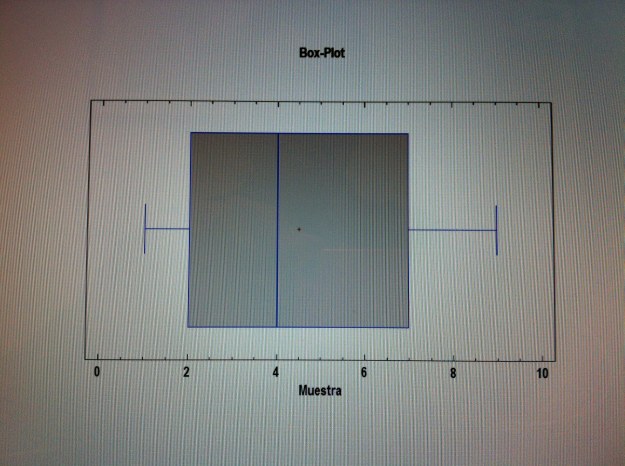

71. Muestra: (1, 3, 5, 9). El Percentil 25 es 2. El 2 separa la muestra en el 25% y el 75%. El Percentil 75 es 7. La mediana, o Percentil 50, es 4.

72. Los dos extremos del gráfico captan el mínimo (en nuestra muestra: 1) y el máximo (en nuestra muestra: 9) de la muestra. Su resta es el rango (8, en esta muestra). La caja dibujada en el interior empieza en el percentil 25 (en este caso: 2) y acaba en el percentil 75 (en la muestra que nos ocupa: 7). La diferencia entre estos dos valores es el rango intercuartílico (5, en nuestro caso). La línea interior en la caja es la mediana (4, en nuestra muestra). Y el puntito dibujado y resaltado marca la media muestral (en esta muestra es 4.5).

73. Puede comprobarse cómo estos estadísticos calculados a esta muestra se representan bien en el Box-Plot dibujado a continuación:

74. Hay otros gráficos que suelen dibujarse a partir de una muestra. Uno de ellos, muy usual, es el Histograma. Consiste en crear una serie de intervalos en una recta y ver cuántos valores de la muestra caen dentro de cada uno de esos intervalos. Entonces se dibujan rectángulos sobre cada uno de esos intervalos con la base en la propia longitud del intervalo y con una altura tan grande como valores hayan caído en ese intervalo.

75. Otro gráfico de una muestra muy curioso y que es bastante usado, especialmente en Economía y Geografía humana, es la Curva de Lorenz.

76. Se trata de una forma distinta de analizar la dispersión de una muestra. La curva se dibuja en un gráfico de dos dimensiones: en el eje de las abscisas se dibuja el ritmo del acumulado de la cantidad de valores que hay en la muestra y en el eje de las ordenadas el ritmo del acumulado de valores de la variable de la muestra, ordenada ésta previamente de menor a mayor.

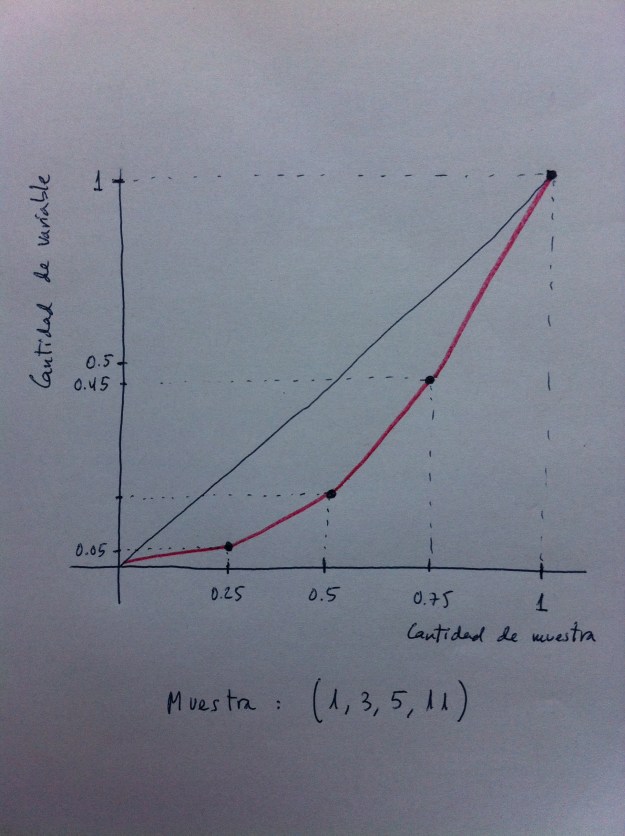

77. Para ver cómo es esta curva mejor hacerlo con un ejemplo: Supongamos la muestra: (1, 11, 5, 3). Lo primero que debemos hacer es ordenar la muestra de menor a mayor, quedando entonces: (1, 3, 5, 11).

78. En el eje de las abscisas hemos de ir registrando las cantidades de valores que vamos acumulando en la muestra, en tanto por uno. Con el primer valor tenemos el 25% de los valores muestrales (0.25, en tanto por uno), con el segundo valor tenemos el 50% (0.5, en tanto por uno), con el tercero el 75% (o el 0.75) y, finalmente, con el último valor tenemos ya el 100% (1, en tanto por uno, claro).

79. En el eje de las ordenadas iremos registrando en lugar del tanto por uno de la cantidad de elementos de la muestra, la cantidad acumulada de valor de la variable estudiada. Vemos que la suma de 1, 3, 5 y 11 es 20. Por lo tanto, cuando tengamos el 25% de los primeros valores muestrales; o sea, cuando hayamos acumulado sólo el primer valor, el 1, tendremos acumulado el 5% (0.05, en tanto por uno) de la suma de valores de la variable, porque habremos sumado sólo ese valor de 1, que representa el 5% del total (1 de 20). Cuando tengamos el 50% de valores muestrales habremos acumulado 1+3=4, en cuanto a valores de la variable, que supone un 20% (el 0.2, en tanto por uno) de la cantidad total de la variable (4 de 20). Cuando tengamos el 75% de valores muestrales habremos acumulado 1+3+5=9, en cuanto a valores de la variable, que supone un 45% (0.45, en tanto por uno) de la cantidad total de la variable (9 de 20). Al llegar al 100% de la muestra evidentemente llegamos al 100% (1, en tanto por uno) del total de la variable, por supuesto.

80. Todo esto se expresa, como ya he dicho, tanto en el eje de las abscisas como en el de las ordenadas, en tantos por uno. En el eje de las abscisas se escribe el tanto por uno de cantidad de muestra acumulada y en el de las ordenadas el de la cantidad acumulada de valor de la variable. La curva de Lorenz de esta muestra sería:

81. En la curva de Lorenz suele dibujarse siempre, también, la recta que va del punto (0, 0) al punto (1, 1). Esta sería, en realidad, la hipotética curva de Lorenz que se dibujaría en el caso de que la muestra tuviera todos sus valores iguales; o sea, en el caso de no haber dispersión. En este caso hipotético sería el mismo el ritmo de acumulación de cantidad de valores muestrales y el de acumulación de cantidad de la variable estudiada.

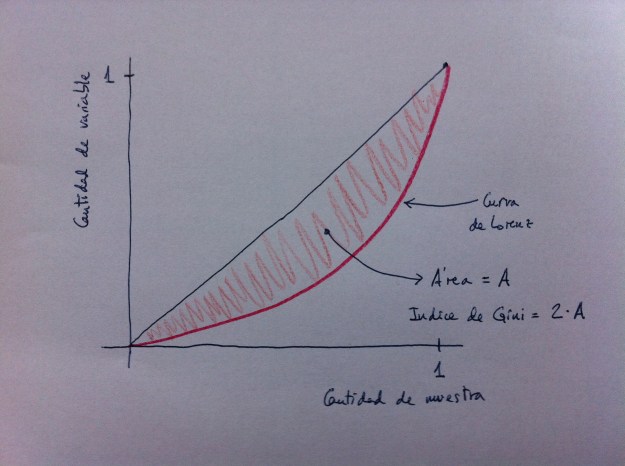

82. Es importante esta curva hipotética porque el área dibujada por esta recta hipotética y la curva de Lorenz de la muestra estudiada, multiplicado por 2, es el famoso Índice de Gini, muy usado en Economía.

83. El Índice de Gini es un valor que va del 0 al 1, que es 0 si todos los valores de la muestra son iguales (si coindice con esa curva hipotética que comentaba antes) y que es 1, el máximo posible, si todos los valores de la muestra son 0 excepto uno. Todo lo acumulado en la variable de la muestra está concentrado en un único valor. En este caso la curva de Lorenz únicamente se levanta al llegar al final de la muestra, se levanta, claro, únicamente al llegar al 100% porque todo está concentrado en el último valor.

84. Como puede verse tanto la curva de Lorenz como el Índice de Gini tienen un uso especialmente dirigido a dibujar y cuantificar aspectos relacionados con la distribución de la renta, de la riqueza, y de aspectos, en definitiva, muy ligados a la Economía. Pero, como casi todo, es perfectamente exportable a otros ámbitos.

85. Hemos visto, pues, que la curva de Lorenz se dibuja con valores en tanto por uno tanto en el eje de las abscisas como en el de las ordenadas y esto es para poder calcular con facilidad el Índice de Gini. Además, en este cálculo hemos visto que se multiplica por 2 el área dibujada por la recta que une el punto (0, 0) y el punto (1, 1) y la curva de Lorenz. Es por este producto por 2 que los valores del índice pueden ir desde el 0 al 1. Pensemos que el área máxima dibujada por la recta y la curva de Lorenz es 0.5 (base 1 multiplicado por altura 1 y dividido por 2).

86. Veamos gráficamente cómo se visualiza el Índice de Gini respecto a la curva de Lorenz:

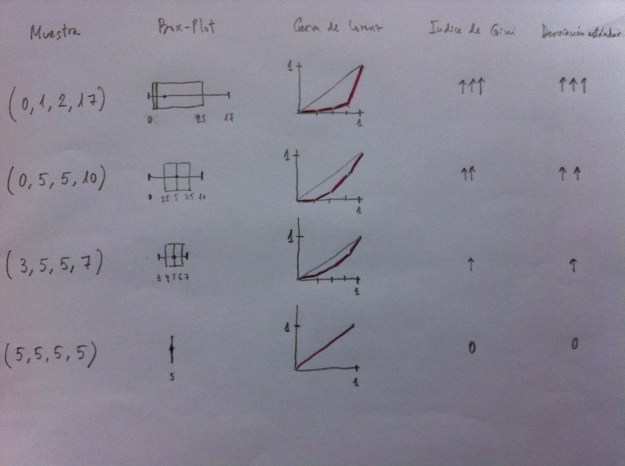

87. Para acabar, un esquema donde se comparan diferentes muestras. Se trata de muestras muy diferentes entre sí, con muy distinta dispersión. Se ve en él cómo estas muestras quedan representadas por gráficos distintos: Box-Plot y Curva de Lorenz y por descriptores también distintos: Índice de Gini y Desviación estándar.

88. Como puede verse, pues, la Estadística descriptiva consiste en un conjunto de técnicas, de herramientas, que tratan de describir, de resumir, de resaltar aspectos determinados de la disposición de los valores en el interior de una muestra. Aquí va este esquema resumen:

89. Las variables cualitativas o nominales (porque los valores que toma la variable son nombres) tienen poco margen para ser descritas por determinados descriptores. Suele hacerse únicamente un recuento de cada uno de los valores posibles. Este recuento suele hacerse de forma absoluta y de forma relativa; o sea, las veces que aparece en la muestra en total y el porcentaje de veces que aparece en esa muestra.

90. Ejemplo: (hombre, hombre, mujer, mujer, mujer). El valor absoluto de hombre es 2 y el de mujer 3. El valor relativo de hombre es 0.4 ó el 40% y el de mujer es 0.6 ó el 60%. Poco más puede hacerse.

91. El gráfico más usual en variables cualitativas o nominales es el llamado Diagrama de frecuencias. En ocasiones se usa también el llamado Diagrama pastel, donde se observa especialmente el valor relativo puesto que cada valor está representado por una porción del pastel igual al de su valor relativo dentro del conjunto de valores de la muestra.

92. Veamos en el siguiente gráfico un ejemplo de datos posibles de un estudio. Tenemos cuatro variables y 18 individuos. Las cuatro variables son: Sexo, Nacionalidad, Altura y Número de hermanos. Las dos primeras son claramente dos variables cualitativas o nominales. Las otras dos son cuantitativas. Las dos primeras suelen representarse, como puede verse, mediante un Diagrama de frecuencias. La variable Número de hermanos es una variable especial. Es numérica y, por lo tanto, se le puede calcular todo lo que hemos visto para variables cuantitativas: media, desviación estándar, mediana, etc., pero debido a la peculiaridad de tener pocos valores posibles es, digamos, una variables pseudocualitativa y, a veces, este tipo de variables se describen como si fueran cualitativas; o sea, mediante frecuencias absolutas y relativas y mediante Diagramas de frecuencias, como puede verse en el gráfico. Finalmente la variable Altura es una variable que se puede graficar mediante un Box-Plot o mediante un Histograma. Realmente, si se comparan ambos gráficos, puede apreciarse la mayor cantidad de información que porporciona el Box-Plot. El Histograma tiene, además, el problema que dependiendo del número de intervalos que hagamos tendremos formas muy diferentes. Veamos todo esto en el siguiente gráfico:

93. Finalmente, hay dos medidas de una muestra (la Asimetría estandarizada y la Curtosis estandarizada) que suelen usarse únicamente como formas aproximadas de comprobar la normalidad de la muestra de una variable cuantitativa, como lo veremos en el tema siguiente. Basta ahora decir que si el valor de ambos estadísticos está comprendido entre -2 y 2 podemos suponer que la muestra se ajusta suficientemente bien a la distribución normal.

94. La comprobación del ajuste a la normalidad de una muestra de una variable cuantitativa es importante porque si este ajuste es suficiente dando la media y la desviación estándar estamos dando ya una información definitiva para saber aspectos básicos de la distribución de esa variable. Sin embargo, si este ajuste no es bueno, más que usar la media y la desviación estándar será aconsejable usar la mediana y el rango intercuartílico, como veremos en temas sucesivos.

you are right in what you have said. i was only thinking this the other day but i think i will now dig a little deeper. lista de email lista de email lista de email lista de email lista de email

Hola Jaume,

Una pregunta sobre la Asimetría estandarizada y la Curtosis estandarizada: ¿si en una muestra estos valores están comprendidos entre -2 y 2 sería suficiente para asumir que la muestra se ajusta a la distribución normal (y poder calcular por ejemplo la ANOVA,…) o tendríamos que realizar un test de bondad de ajuste a la normal?

El caso particular que me atañe es la comparación de notas de los alumnos en un grupo de control y otro experimental. Ambas variables tienen la Asimetría estandarizada y la Curtosis estandarizada entre los valores de -2 y 2, pero las pruebas de normalidad me da un p<0,05 por lo que no se ajustarían a una normal. ¿Podría asumir por los valores de la Asimetría estandarizada y la Curtosis estandarizada qué se pueda comportar como una normal? (me facilitaría mucho las cosas ya que me sucede lo mismo con otras variables).

Gracias de antemano

En ANOVA se usa siempre una técnica de bodad de ajuste a la normalidad. Lo que te debe ocurrir es que debes tener un tamaño de muestra bastante grande. En los contrastes de hipótesis (y las pruebas de ajuste son un contraste de hipótesis) los tamaños grandes juegan a favor de la hipótesis alternativa, que en una prueba de ajuste es la no normalidad. Puedes o bien aplicar un test de Kruskall-Wallis o bien transformar las variables. Dependiendo de cómo sea la anormalidad hacer una potencia de la variable te puede permitir un ajuste. Es muy habitual, no te preocupes, y muy correcto.

Gracias!!!!

Buenas noches, se me complicaba el comprender la representatividad de la muestra, pero ahora me quedó más claro. Si tengo una serie de datos que deseo a analizar, pero una parte de los datos se los estimó con una metodología y la otra parte con una metodología diferente. Entonces ¿es un proceder más coherente analizar los datos por separado, considerando el método que se utilizó para su recopilación?

En la medida que entiendo lo que me preguntas, cada estimación va ligada al procedimiento que se ha seguido, claro.